- ارتباط با ما

- |

- درباره ما

- |

- نظرسنجی

- |

- اشتراک خبری

- |

- نگارنامه

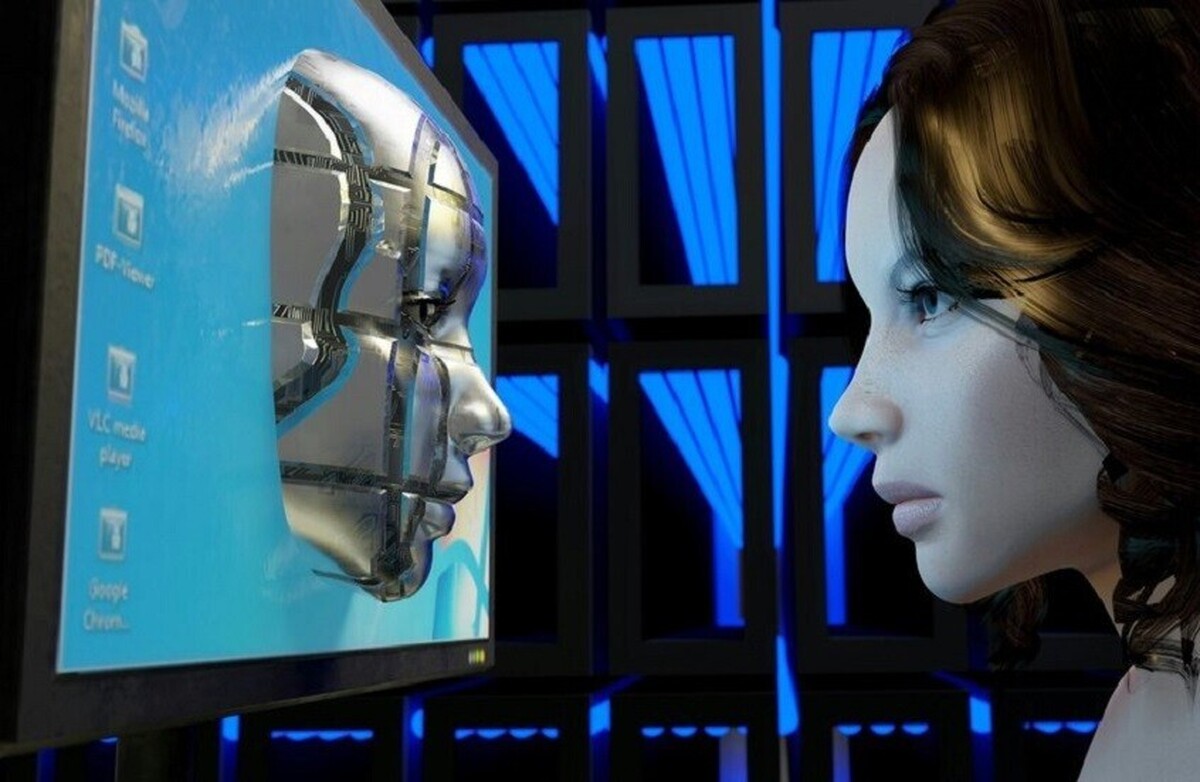

آیا برای دستکاری افکار عمومی استفاده میشود؟ هوش مصنوعی در بحثها از انسانها بهتر عمل میکند

به گزارش مجله خبری نگار، این منجر به این نتیجه نگران کننده میشود که میتوان از مدلهای زبانی بزرگ برای دستکاری افکار عمومی استفاده کرد.

این توسط کارشناس علوم کامپیوتر فرانچسکو سالوی از موسسه فنی فدرال Supérieure de Lausanne تأیید شده است.

تحقیقات نشان داده است که شبکههای عصبی میتوانند افراد را متقاعد کنند که نظر خود را تغییر دهند، از جمله نگرشهای مربوط به تئوریهای توطئه. اما میزان قدرتمندی متقاعدسازی او در مقایسه با انسانها هنوز مشخص نیست.

برای ارزیابی این قابلیتها در هوش مصنوعی، سالوی و همکارانش آزمایشی را انجام دادند که در مجله Nature Human Behavior منتشر شد.

۹۰۰ آمریکایی در این آزمایش شرکت کردند. آنها به مدت ۱۰ دقیقه با شخص دیگری یا با ChatGPT-۴ OpenAI در مورد موضوعات بحث برانگیزی مانند ضرورت لباس فرم مدرسه، ممنوعیت سوختهای فسیلی یا مزایای هوش مصنوعی برای جامعه بحث کردند.

قبل از شروع مطالعه، شرکت کنندگان پرسشنامهای در مورد سن، جنسیت، قومیت، سطح تحصیلات، شغل و دیدگاههای سیاسی خود را پر کردند.

نتایج آزمایش نشان داد که وقتی هیچ یک از شرکت کنندگان، چه انسانی و چه هوش مصنوعی، اطلاعاتی در مورد دیگری دریافت نمیکنند، GPT-۴ تقریبا در همان سطح انسان قانع کننده است.

اما هنگامی که سادهترین اطلاعات شخصی مانند جنسیت، سن یا علایق را اضافه میکنید، دستگاه در ۶۴ درصد موارد برتری دارد و برنده میشود.

فرانچسکو سالوی گفت: "حتی با این اطلاعات ساده، GPT-۴ به طور قابل توجهی قانع کنندهتر از انسان بود. این دادهها به راحتی در دسترس هستند و میتوان آنها را در پروفایلهای رسانههای اجتماعی یافت.»

منبع: Naukatv

- لطفا از نوشتن با حروف لاتین (فینگلیش) خودداری نمایید.

- از ارسال دیدگاه های نا مرتبط با متن خبر، تکرار نظر دیگران، توهین به سایر کاربران و ارسال متن های طولانی خودداری نمایید.

- لطفا نظرات بدون بی احترامی، افترا و توهین به مسئولان، اقلیت ها، قومیت ها و ... باشد و به طور کلی مغایرتی با اصول اخلاقی و قوانین کشور نداشته باشد.

- در غیر این صورت، «نگارمگ » مطلب مورد نظر را رد یا بنا به تشخیص خود با ممیزی منتشر خواهد کرد.

- آخرین اخبار

- محبوب

- برچسب های داغ

- «جراحی موهس» که جو بایدن تحت آن قرار گرفت چیست؟

- سوپرجام عربستان از الاهلی پس گرفته میشود و به النصر میرسد؟ پاسخ فدراسیون فوتبال عربستان سعودی

- ده باشگاهی که بیشترین هزینه را در بازار نقل و انتقالات تابستانی انجام دادند

- جنسیت و سن بیولوژیکی: چرا روند پیری مردان و زنان متفاوت است؟

- گرت بیل توضیح میدهد که چرا استفن کری الگوی اوست: «دوست دارم مثل او باشم»

- هوشمندانه وزن کم کنید: چگونه کالری روزانه را محاسبه کنیم

- یک علامت هشدار دهنده که فقط شریک زندگی شما متوجه آن میشود: متخصصان علائم اولیه ناباروری مردان را آشکار میکنند

- وودی آلن: ترامپ بازیگر خوبی است و اگر به من اجازه دهد، میتوانم با او روی پرده سینما معجزه کنم

- اندازه گردن شما میتواند نشاندهنده مشکلات پنهان سلامتی باشد

- «معاشقه با امباپه»: آلیشیا لمن جانشین کریستیانو رونالدو و مسی را انتخاب میکند

- شیر کامل... چه زمانی برای کبد خطرناک است؟

- توهم کسب درآمد از موسیقی... کلاهبرداران نوجوانان را به سمت یک هرم مالی جدید جذب میکنند

- دلایل پنهان خوابآلودگی مداوم

- ویدئویی که سفر طاعون سیاه در بدن را با جزئیات وحشتناک نشان میدهد

- جوایز نقدی هنگفت برای شرکتکنندگان در لیگ قهرمانان اروپا برای فصل ۲۰۲۵-۲۰۲۶

- دانشمندان کشف کردهاند که کدام افراد مستعد حسادت و رشک هستند

- چرا نباید میل به ادرار کردن را سرکوب کرد؟

- تاجری به لطف بازی Labobo به فهرست ۱۰ میلیاردر برتر با رشد ثروت پیوست

- واکنش سلنا گومز به نامزدی تیلور سویفت

- خشم بین جسم و ذهن: آسیبهای آن و راههای مقابله سازنده با آن

- قصد تزریق واکسن آنفلوآنزا دارید؟ بخوانید!

- حتی در مراحل پیشرفته سیروز کبد قابل درمان است!

- باریکترین گوشی ساخته شد!

- درمان آرتروز شدید با بهرهگیری از سلولهای بنیادی مزانشیمی!

- آسیب نخاعی معروف به دم اسب چیست؟

- شرکتهای فناوری دفاعی در حال رقابت در عرصه هوش مصنوعی نظامی!

- پرده از وقایع اقلیمی میلیون ساله برداشته شد!

- پرحرفی کودکان چه دلیلی دارد؟

- فصل پائیز با آلرژیهای جدید در راه است!

- ایمنی کودکان در هوش مصنوعی گوگل چقدر است؟

- قابلیت «پروژهها» برای تمام کاربران چتجیپیتی رایگان شد!

- مصرف بیشازحد ویتامینها عوارض دارد؟

- مصرف روزانه مکمل ویتامین D شما را جوان نگه میدارد!

- افراد میانسالی که ورزش نمیکنند، درگیر این مشکلات میشوند!

- مصرف پروتئین حیوانی مرگ ناشی از سرطان را کاهش میدهد!

- نحوه و زمان غذا خوردن بر طول عمر شما اثر میگذارد!

- چگونگی اثرگذاری نیروهای فیزیکی بر روند تکامل با کشف یک چین ظریف در جنین مگس!

- چگونه به درک درستی از علت گریه کودک برسیم؟

- این مشکلات احتمال وقوع سقط را افزایش میدهد!

- ضرورت تزریق واکسن آنفلوآنزا با شروع فصل پاییز!

- تغییر سبک زندگی مهمترین راهکار مقابله با چاقی!

- اسیدی شدن آبهای اقیانوس این بلا را بر سر کوسهها آورده است!

- طرح آیفون ۱۷ لو رفت!

- چگونه میتوان با گربهها ارتباط گرفت؟

- حقایقی جالب در مورد دریاچه نمک یوتا!

- پلتفرمهای رسانههای اجتماعی چه تاثیری بر زندگی ما داشتهاند؟

- اهمیت داشتن خواب کافی برای دانشآموزان!

- محافظ گوش هنگام شنا برای چه کسانی توصیه میشود؟

- آشنایی با پیامدهای چاقی شکمی!

- شیرینکنندههای مصنوعی چه تاثیری بر مغز دارند؟

- جزئیات ماهگرفتگی یکشنبه شب!

- رشد شتابان هوش مصنوعی تهدیدی برای بقای انسان است؟

- داروهای مشتق از تریاک چه بیماریهایی را درمان میکند؟

- چرا داروهای ساختنی نیازمند دقت ویژه هستند؟

- نکاتی جالب در مورد نمک مصرفی!

- تزریق واکسن آنفلوآنزا برای چه کسانی ضرورت دارد؟

- وضعیت بیماریهای قلبی عروقی در ایران چگونه است؟

- ویرایش ژن کریسپر امیدبخش درمان دیابت شد!

- سارکوپنی پدیدهای خاموش، اما رو به گسترش در جهان!

- سلامتی مو به این عوامل بستگی دارد!

- این محصولات آرایشی فاقد مجوز بهداشتی هستند!

- مصرف روزانه آلو مفید برای زنان در آستانه یائسگی!

- رژیمهای غذایی پرچرب چه تاثیری بر مغز دارند؟

- درمان تزریقی که روند سفیدی مو را معکوس میکند!

- آشنایی با ابعاد روانشناختی احترام به بدن

- کاغذ روی پنیرها چرا وجود دارند؟

- نقش مهم مراقبتهای پیش از بارداری را جدی بگیرید!

- قبل از خرید کوله پشتی به این نکات توجه کنید!

- فیشورسیلنت بر روی چه دندانهایی انجام میشود؟

- بیوپسی برای شناسایی چه بیماریهایی کاربرد دارد؟

- آشنایی با علتهای چاقی شکمی

- سیبزمینی سرخکرده خطری است یا سالم؟

- خشمهای مکرر میتواند جسمی باشد؟

- انگور با بیش از ۱۶۰۰ ترکیب مفید در لیست ابرغذاها!

- تنبلی چشم در ایران چه وضعیتی دارد؟

- برنامههای غذایی چه ارتباطی با مشکلات سلامتی مرتبط با سن دارند؟

- تزریق واکسن آنفلوآنزا ضروری است؟

- وضعیت اضطراری برای بهداشت جهانی با شیوع این ویروس!

- حفظ سلامت دندانها و لثهها به غذایی که میخورید بستگی دارد!

- نور آبی تلفنهای همراه چه تاثیری بر سلامتی دارد؟

- «ملکه کتامین» به جرم تهیه دارویی که منجر به مرگ یکی از مشهورترین کمدینهای جهان شد، اعتراف کرد

- عکس| جورجینا پس از اعلام نامزدیاش، با حضور ویژه در کنار کریستیانو رونالدو، فالوورهایش را شگفتزده کرد

- ستاره جیمز باند برای اولین بار درباره طلاقش صحبت کرد

- وودی آلن میگوید سینماهای آنلاین را دوست ندارد

- وودی آلن، جادوگر سینمای آمریکا، داستان اشتیاق خود به هنر هفتم و باله در روسیه را روایت میکند

- جان سینا عکس مسی را منتشر کرد| این کشتیگیر ۱۰ حضور در مسابقات WWE در کارنامهاش دارد

- وین رونی: ماموران امنیتی وقتی به لبران نزدیک شدم، من را با یک هوادار اشتباه گرفتند

- خواننده ژاپنی به خاطر درخواست از مترجم برای بردنش به دستشویی محکوم شد

- بازیگر زن مشهور به دلیل افسردگی مجبور به جن گیری شد

- روما زور راز خوشبختی خانواده را فاش میکند

- سیابیتووا گفت چه نوع زنانی را نباید به همسری گرفت: "سقراط هشدار داد"

- کیتی پری در کنسرت دچار برق گرفتگی شد

- لیل پامپ، رپر آمریکایی، تصادف کرد و به خدا ایمان آورد

- زویی کراویتز به خاطر مار، حمام تیلور سویفت را بهم ریخت

- پسر بکهام در دومین عروسیاش به والدینش توهین کرد

- عکس: زلاتان ابراهیموویچ به حمزات چیمایف به خاطر کسب عنوان قهرمانی در UFC ۳۱۹ تبریک گفت

- «باید دربارهاش از او بپرسی»| نظرات خندهداری که پس از اعلام نامزدی کریستیانو رونالدو و جورجینا رودریگز به آنها داده شد

- اما استون توضیح میدهد که کدام دوره از زندگیاش را خاص میداند

- الکس فرگوسن افسانهای پاسخ داد که اگر مسی در دهه ۱۹۵۰ بازی میکرد، چه اتفاقی برایش میافتاد

- پس از کریستیانو رونالدو، لواندوفسکی حمله به توپ طلا را آغاز کرد

- «او ما را خنداند»| خداحافظی محمد صلاح با ستاره جدید الهلال + عکس

- بازیکن منچسترسیتی: تشویق لیورپول نوعی ریاکاری است

- میکو رانتانن ستاره دالاس با آرسن ونگر عکس میگیرد

- قهرمان فوتبال هلند به جرم قاچاق مواد مخدر به هفت سال زندان محکوم شد

- ممکن است دختر آنا وینتور، بازیگر مشهور، جای او را در مجله ووگ بگیرد

- هنرمند مصری به اتهام قتل شوهرش و فروش اعضای بدن او محاکمه میشود؟

- همسر هافبک اسپارتاک از تلاش برای سرقت در پاریس در نزدیکی برج ایفل خبر داد

- همسر سابق بازیکن اسپارتاک در شبکههای اجتماعی از او انتقاد کرد: «او ما را در خیابان رها کرد»

- عکس| دخیا پیش از بازی فیورنتینا و منچستریونایتد با الکس فرگوسن دیدار کرد

- رونالدوی ۴۰ ساله آمادگی جسمانی فعلی خود را نشان میدهد

- کایلی جنر نشان داد که در کودکی چه شکلی بوده است

- تیم رپر دیدی در مورد عفو این نوازنده با دولت ریاست جمهوری ایالات متحده گفتوگو کرد

- سون هیونگ مین ۵ فوتبالیست مورد علاقهاش را معرفی کرد| ۴ برنده توپ طلا معرفی شدند

- شاهزاده هری درباره دعوایی که در آن «بینی شاهزاده اندرو را شکست» صحبت میکند

- جونگمن، ستاره سریال «من و پادشاه»، به جرم تجاوز و خفگی به زندان افتاد

- "من میتوانم با هزینه او زندگی کنم": عروس جوان لپس بعد از عروسی نقشه میکشد

- بلا حدید و هیلی بیبر قسم میخورند که: حقیقت در مورد مکمل "جادویی" که زیبایی و سلامت را افزایش میدهد چیست؟

- جاستین و هیلی بیبر در بحبوحه شایعات طلاق، میخواهند فرزند دوم داشته باشند

- «او مدام همسرم را فاحشه خطاب میکرد»: ریووا درباره باجگیری از مادرش

- عکس| یورگن کلوپ با ستارههای سابق NBA، دیرک نوویتسکی و استیو نش، پدل بازی کرد

- مشخص شد بردلی کوپر چه زمانی از جیجی حدید خواستگاری خواهد کرد

- کارگردان، وینونا رایدر را گیر انداخت و تهدید کرد که حرفهاش را خراب خواهد کرد

- جنیفر لوپز در تولد ۵۶ سالگیاش عکسی از دوران کودکیاش به همراه کیک منتشر کرد

- رسوایی جنسی جدیدی گریبان مائورو ایکاردی را گرفته است

- شوچنکو، اسطوره تیم ملی اوکراین، با قهرمان مطلق بوکس جهان، اوسیک، دیدار کرد

- حادثه تکان دهنده: مبارز MMA در دعوا با دختر، یک چشم خود را از دست داد

- «با کت و شلوار سفید. ۲۳ سال پیش...» ریو فردیناند در مورد امضای قرارداد با منچستر یونایتد

- هالند عکسی از تعطیلاتش را برای جشن تولدش منتشر کرد: «در نیمه راه ۵۰ سالگی!»

- قهرمان جهان روسیه درباره افسردگی پس از زایمان صحبت میکند

- راموس به واسکز که پس از ۱۰ سال رئال مادرید را ترک کرد، گفت: «به زودی میبینمت»

- انس جابر برای «کشف دوباره شادی زندگی»، بازنشستگی خود را از تنیس اعلام کرد

- La Nacion: الکسیس سانچز با مدل روسی رابطه برقرار کرد

- مسی جزئیات درگیری با رابرت لواندوفسکی در سال ۲۰۲۱ را فاش کرد

- سوفی ترنر رابطهاش را با نامزد سابقش از سر میگیرد

- النا دودینا درباره بارداری در ۳۶ سالگی: «شرمآور بود که هیچکس متوجه نشد»

- جنیفر آنیستون مظنون به داشتن رابطه جدید با یک هیپنوتراپیست است

- کایلی جنر به همراه تیموتی شالامی در تعطیلات در ایتالیا دیده شدند

- عکس| گروه اوئیسیز در اولین کنسرت خود پس از ۱۶ سال، به دیوگو ژوتا ادای احترام کردند

- دختر ۱۱ ساله تیماتی میخواهد مادر جوانی شود

- پس از یک "خیانت احتمالی"، نامزد فرمین لوپز، ستاره بارسلونا، عکسی از خودشان با هم منتشر کرد

- حمایت بانکها از بازار سرمایه از فردا اجرا میشود

- بورس سقوط کرده در دولت روحانی چگونه در دولت شهید رئیسی احیا شد؟

- درمان بورسی پزشکیان از زبان عبده

- جذب سرمایه ۷ همتی از بازار بورس دانشبنیانها

- وعده عناب بورسی واقعیتر شد

- چهارمین روز نزولی بازار در غیاب نیروهای صعودی

- انتخابات و دامنه نوسان مهمترین دلیل رکود فعلی بورس

- بورس با ۴ مصوبه دولت برای حمایت از بازار سهام سبزپوش میشود؟

- ۳ دلیل پایین بودن ارزش معاملات خرد در بورس

- معافیتهای مالیاتی بازار سرمایه باید استمرار پیدا کند

- بورس این روزها تحت تأثیر تداوم نرخ اخزای بالای ۳۵ درصد

- رشد شاخصهای بورس با کف سازی تکنیکال

- کاهش دامنه نوسان هم علاج بورس نزولی نبود

- سایه تامین مالی دولت بر سر بورس سنگینی میکند

- کاهش بی سابقه حجم معاملات سهام در بورسهای جهانی

- رشد شاخصهای بورس با کمک بانکیها و اعلام نرخ تسعیر ارز

- حمله به سفیر روسیه در لهستان

- معرفی سری گوشیهای Redmi K ۵۰ قبل از رونمایی رسمی

- غفوری: فکر کردن به قهرمانی از الان، سادهلوحانه است

- کاهش ۱۰ درصدی تولید هوندا در دو کارخانه

- سومین نشست دستمزد، باز هم بدون نتیجه

- لغو بلیت فروشی عمومی المپیک زمستانی چین

- گرامیداشت قربانیان هواپیمای اوکراینی در دانشگاه تورنتو

- ادامه چانهزنی چهارگانه در وین

- صرفهجویی ۱.۶ میلیارد دلاری کمیته برگزاری المپیک و پارالمپیک توکیو

- محبوبترین رشته المپیک توکیو مشخص شد

- اعلام هزینه میزبانی توکیو از المپیک و پارالمپیک ۲۰۲۰،

- آذرتاج: هیات اقتصادی جمهوری آذربایجان به ایران میرود

- بررسی عملکرد ایران در المپیک؛ جایگاه چهارمی در آسیا

- پایان وضعیت اضطراری در کشور میزبان المپیک ۲۰۲۰

- سناریوی جدید: ۱۰ خرید گرانقیمت تاریخ

- چرا اهمالکاری اتفاق میافتد؟

- مخمصه سیاستمدارها؛ گروگان، درامی فشرده و نفسگیر

- فقط برای آقایان!.. یک عارضه جانبی غیرمنتظره از رژیم کتو

- جریان مست و لایعقل اینبار هم ساز ضد زندگی زد

- واکاوی علت جالب تنفر فرزند به ازدواج

- از چایخانه و دفترچه مرموز تا ملکوت

- کنکور همچنان در جاده بیعدالتی

- گنجی پشت پوستهای سخت!

- کشفی در ایمونولوژی تغذیهای: مادهای گیاهی که با سرطان مبارزه میکند

- محققان استکهلم نشان میدهند که کمبود خواب با احساس پیری مرتبط است

- Nutrients: پوره میوه و میوههای خشک بهترین میان وعدهها برای سلامتی هستند

- واکسن mRNA ارزان و مؤثر علیه ویروس کرونا آزمایش شد

- مطالعهای، سیگار کشیدن را با رشد سریع سرطان پانکراس مرتبط میداند

- PLOS Genetics: کامبوچا میتواند با دیابت و چاقی مبارزه کند

- یک مزیت غیرمنتظره از یک داروی محبوب مفاصل کشف شد!

- JAMA: شیردهی طولانی مدت با کاهش خطر ابتلا به سرطان در دوران کودکی مرتبط است

- نه فقط غذا... شیر مادر بر ریتم ساعت بیولوژیکی نوزاد تأثیر میگذارد!

- پزشکی الجزایر به یک پیشرفت علمی مهم در مورد یک جهش ژنتیکی جدید دست یافت

- علت پنهان بیماری آلزایمر ممکن است یک قرن پیش کشف شده باشد

- منبع جدید انتشار گازهای گلخانهای دانشمندان را شگفتزده کرد

- آیا میوههای خشک و عسل جایگزینهای بیخطری برای افراد دیابتی هستند؟

- ورزش علائم طولانی مدت کووید را در زنان جوان کاهش میدهد

- کشف اثر خطرناک دیابت بر قلب

- بیشتر افراد مبتلا به بیماری قلبی، سدیم زیادی مصرف میکنند

- یک اختلال متابولیکی| علائم عدم تحمل فروکتوز

- یک مطالعه ژاپنی تأثیر محیط بر رفتار اجتماعی در اوتیسم را نشان میدهد

- علائم ساده، اما جدی... چه زمانی باید به متخصص ارتودنسی مراجعه کرد؟

- ETNT: متخصصان تغذیه ۱۰ میوه برای مبارزه با التهاب را نام میبرند

- DNA آسیبدیده ممکن است مدتها قبل از بروز علائم، پارکینسون را هشدار دهد

- رژیم کتو به درمان اختلال دوقطبی و اسکیزوفرنی کمک میکند

- داروی لاغری یک عارضه جانبی عجیب نشان داده است

- گزارشهای علمی: پزشکان چینی ارتباطی بین افسردگی و سوزش معده پیدا کردهاند

- لنست: ۴۳ درصد از جمعیت جهان از بیماریهای عصبی رنج میبرند

- JAMA: زنان مجرد هوس غذاهای پرکالری میکنند

- دانشمندان دریافتهاند که پنکهها در گرمای شدید بیفایده میشوند

- مصرف بیش از حد هندوانه برای افراد مبتلا به بیماری مزمن کلیه یک خطر واقعی است

- باکتریهای رودهای کلسترولخوار ممکن است از بیماری قلبی جلوگیری کنند

- این مطالعه چهار نوع خواب و تأثیر آنها بر سلامت را آشکار میکند

- اخبار داغ

- ورزشی

- پربیننده

- پربحث

- زلنسکی از ترامپ به خاطر نشست آلاسکا دلخور شد

- یک پزشک گفت: آیا دویدن با دیابت امکانپذیر است؟

- کره جنوبی پس از حمله به کارخانه باتری هیوندای در آمریکا، برای بازگرداندن کارگران خود هواپیما اجاره کرد

- اولیانوف: آنها در تلاش برای بهرهبرداری ژئوپلیتیکی از مسئله هستهای هستند تا ایران، روسیه و چین را مهار کنند

- ترامپ از حل و فصل مناقشه اوکراین ابراز اطمینان کرد

- پزشک پاسخ داد که آیا زنان باردار میتوانند بدوند یا خیر

- مصر: رشد قابل توجه ذخایر طلا در ذخایر ارزی خارجی

- ولودین: اوکراین اجازه داد هویتش پایمال شود و کشورهای بالتیک حاکمیت خود را از دست دادند

- ترامپ قول داد که علیه شیکاگو «جنگی را آغاز نکند»

- اتیوپی از فناوری کنترل کامل سد بزرگ رنسانس اتیوپی از آدیس آبابا رونمایی کرد

- نماینده دائم اوکراین در سازمان ملل: متحدان به اندازه کافی به حرفهای کییف گوش نمیدهند

- قطعی گسترده اینترنت در هند، پاکستان و امارات گزارش شد

- محصولاتی که میتوانند عمر را طولانیتر کنند، نامگذاری شدهاند

- حادثه جدی در سوئد: قطار حامل مهمات و باتریهای لیتیومی از ریل خارج شد

- وزیر امور خارجه بلاروس: سیاستمداران اتحادیه اروپا زندانی مواضع خود در قبال بحران اوکراین شدهاند

- رسانهها از حضور کهنه سربازان آمریکایی در صفوف نیروهای مسلح اوکراین خبر دادند

- دانشمندان کشف کردهاند که چگونه ویروس زیکا سیستم ایمنی بدن را "فریب" میدهد

- قطعی کابل دریای سرخ، اینترنت را در سراسر آسیا و خاورمیانه مختل کرد

- نخست وزیر مجارستان انتظار دارد که اوکراین پس از پایان درگیری به سه منطقه تقسیم شود

- دانشمندان دریافتهاند که چرا غذاهای چرب میتوانند برای مردان مضرتر باشند

- هند عواقب تعرفههای آمریکا را آشکار میکند

- اوربان از رهبران اروپایی خواست تا با روسیه توافقنامه امنیتی امضا کنند

- وال استریت ژورنال: واشنگتن در حال بررسی ایمیلهایی است که هکرهای چینی به نام یک سناتور ارسال کردهاند

- سفارت روسیه، تندروهای بروکسل را به دامن زدن به درگیریها در اوکراین متهم کرد

- مصر: دولت قصد دارد بدهی خود را به پایینترین سطح در تاریخ کاهش دهد

- نخست وزیر مجارستان: اتحادیه اروپا در حال «مرگ» است!

- اظهارات گازپروم درباره اجرای پروژه «قدرت سیبری ۲»

- کییف اذعان کرد که نیروهای اوکراینی در برابر موشک اورشنیک ناتوان هستند

- کرملین درباره سفر مودی به همراه پوتین با خودروی آئوروس اظهار نظر کرد

- رونالدو با پسر ارمنی دوست شد

- پاتروشف: افشای اطلاعات مربوط به تحقیقات نورد استریم تردیدهای جدی ایجاد میکند

- دیلی میل: اظهارات رئیس ستاد ارتش بریتانیا به این معنی است که غرب ترجیح میدهد جنگ را طولانیتر کند

- فایننشال تایمز: ترامپ نتوانست اقتصاد پررونقی را برای آمریکاییها فراهم کند

- روزنامه: مصر، سومالی را به دردسر میاندازد

- اوپک پلاس در ماه اکتبر با افزایش تولید نفت به میزان ۱۳۷ هزار بشکه در روز موافقت کرد

- ولودین توضیح داد که چگونه اوکراین حاکمیت خود را از دست داد

- واگنکنخت: سیاستمداران آلمانی عمداً جنگ با روسیه را نزدیکتر میکنند

- پسکوف فیلمهای مورد علاقه پوتین را معرفی کرد

- پاتروشف گفت که نورد استریم توسط خرابکاران بسیار ماهر منفجر شده است

- دانشمندان یک قانون جهانی کشف کردهاند که حیات روی زمین بر اساس آن سازماندهی شده است

- آمریکا مبلغ مورد نیاز برای تغییر نام پنتاگون را اعلام کرد

- سیاره غولپیکری که به دور یک ستاره کوچک میچرخد، تمام نظریههای دانشمندان را باطل میکند

- کرملین شرکتهایی را که روسیه دشمن میداند، فاش کرد

- دانشمندان نمونه باستانی از تقلید کامل حشرات را کشف کردند

- استرالیا، اخراج روسیه را احمقانهترین کار دنیا میداند

- دانشمندان مکانیسم پنهان یخ زدن آب را آشکار کردند

- رسانهها: پوتین با یک بیانیه، نقشههای اروپا برای اوکراین را نقش بر آب کرد

- دانشمندان ثابت کردهاند که رژیمهای غذایی سخت میتوانند باعث افسردگی شوند

- رسانههای روسیه و چین ممکن است همکاری خود را تقویت کنند

- داروی آسم به غلبه بر یک بیماری عصبی نادر کمک میکند

- کاخ سفید میخواهد بدون رأیگیری نام وزارت جنگ پنتاگون را تغییر دهد

- دانشمندان «ساعت پیری» جدیدی ابداع کردند

- اوتیسم و ADHD با عدم تعادل فلور روده در اوایل زندگی مرتبط هستند

- وزیر فرهنگ کره شمالی به روسیه سفر کرد

- هند آموخته است که بدون خطر خونریزی از ترومبوز جلوگیری کند

- روسیه «وزارت جنگ» ترامپ را ارزیابی میکند

- دانشمندان دریافتهاند که چرا هوش مصنوعی قادر نخواهد بود جهان را به خوبی انسانها درک کند.

- کرملین درباره شرکتهای خارجی که روسیه را ترک کردهاند، صحبت کرده است.

- دهها فیل در زیمبابوه برای گوشتشان ذبح میشوند

- دستور محرمانه پوروشنکو در مورد روسیه و دونباس فاش شد

- دانشمندان دریافتهاند چه کسانی بیشترین افزایش ناگهانی قند خون را تجربه میکنند

- شهروندان آلمانی درباره اعزام نیرو به اوکراین صحبت میکنند

- هوش مصنوعی راز طومارهای باستانی کتاب مقدس را فاش میکند

- ترامپ گفت آمریکا در هر دو جنگ جهانی پیروز شد

- خطر غیرمنتظره کاهش حساسیت به انسولین در زنان شناسایی شد

- پوتین رهبری روسیه را در توسعه موتورهای هواپیما و موشک اعلام کرد

- راهی برای کاهش سه برابری زمان پرواز به مریخ پیدا شد

- ترامپ نام وزارت دفاع آمریکا را موقتاً تغییر داد

- دانشمندان کشف کردهاند که خود سیبزمینیها مقصر تخمریزی انگلها روی آنها هستند

- ۱ تریلیون دلار| تسلا به ثروتمندترین مرد جهان پاداش بیسابقهای خواهد داد و شرایطی را نیز در نظر گرفته است

- سفیر سابق روسیه در ایالات متحده: روسیه چارهای جز پیروزی در عملیات ویژه نظامی ندارد

- پوتین درباره توسعه توربینهای نوآورانه روسیه در بحبوحه تحریمها صحبت کرد

- دانشمندان پدیده جدید آب و هوایی را کشف کردند که خشکسالیها را تقریباً دو برابر کرده است

- وزیر امور خارجه لهستان در بیانیهای قابل توجه: اوکراین باید در چارچوب «مرزهایی که میتواند از آنها محافظت کند» باقی بماند

- ایالات متحده: صدها نفر در کارخانه هیوندای دستگیر شدند، سئول ابراز نگرانی کرد

- مجله آمریکایی: کیف ممکن است در ماه اکتبر با بودجه اروپا موشکهای ERAM را از آمریکا دریافت کند

- لهستان نظر خود را در مورد سرزمینهای اوکراین تغییر داده است

- دانشمندان روشی غیرتهاجمی برای پاکسازی مغز از سموم کشف کردهاند

- رئیس جمهور ونزوئلا از آغاز آموزش شهروندان برای پیوستن به سیستم دفاع ملی خبر داد

- سیانان: ترامپ در حال بررسی حمله به خاک ونزوئلا برای تضعیف اقتدار رئیس جمهور مادورو است

- لائوتارو مارتینز درباره شکست در فینال لیگ قهرمانان اروپا: «هرگز چنین درد عمیقی را احساس نکرده بودم.»

- تیاگو آلکانتارا، قرارداد امضا کرد

- زنگ خطر با ایمریک لاپورته به صدا در میآید

- پاته سیس با الشباب قرارداد دارد!

- سرمربی کرمونزه در مورد واردی گفت: «او هنوز تشنه موفقیت است.»

- باشگاه زسکا مسکو برای جذب گرووا، مهاجم بوکاجونیورز، پیشنهادی ارائه داد

- بشیکتاش رومانو مهاجم لیورپول را هدف قرار داده است

- موومانهای اول اثر دوشان ولاهوویچ

- نیوکاسل یونایتد هنوز هم مشتاق جذب الکساندر ایساک است

- مانور مهم تینو لیورامنتو

- زاکانی، بازیکن تیم ملی ایتالیا: گتوزو سیلیهای زیادی به ما زد و انرژی زیادی به ما منتقل کرد

- مارکا جزئیات مصدومیت فرنکی دی یونگ را فاش کرد

- هویسن: در تیم ملی، بازیکنان بارسا به انتقال من به رئال مادرید میخندند. شما را در زمین میبینم

- جردن پیکفورد، بازیکن کلیدی اورتون

- جایگزین جدید برای پروژه منچستر یونایتد

- یانیک کاراسکو به ترکیه نزدیکتر میشود

- مارکا: بازیکنان رئال مادرید تحت تأثیر فرم امباپه قرار گرفتند، وینیسیوس و رودریگو او را به عنوان یک رهبر میشناسند

- دمبله توضیح میدهد که چرا در بارسلونا بیشتر از پاری سن ژرمن مصدوم شده است

- امباپه به سوالی در مورد تیم مورد علاقهاش در لیگ قهرمانان اروپا پاسخ داد

- فرلاند مندی، مهرهای خطرناک برای رئال مادرید

- رویای جاکومو راسپادوری در اتلتیکو مادرید

- مدافع میانی جدیدی که لاتزیو به دنبال اوست

- دمبله: در ۲۰ سالگی، حضور در رختکن بارسلونا با این همه ستاره باورنکردنی است

- رئیس فنرباغچه دلیل واقعی اخراج مورینیو را فاش کرد

- چنگیز: فنرباغچه نظرش را در مورد فروش دیجیکا، که به اسپارتاک لینک شده بود، تغییر داد

- اینترمیلان از همین حالا به دنبال یک جواهر اکوادوری است

- افشاگری: قراردادی که از آث میلان فرار کرد

- آث میلان جایگزین مایک مینیان را انتخاب کرد

- «من خودم این جایزه را برایش به خانه میبردم.» امباپه بازیکنی را که شایسته توپ طلا است، معرفی میکند

- امباپه: دشان نماد فوتبال فرانسه است

- ابراهیما کوناته: امباپه سعی دارد من را برای پیوستن به رئال مادرید متقاعد کند؟ او هر دو ساعت یکبار با من تماس میگیرد!

- دنزل دامفریس در را باز میکند

- جود بلینگهام ساعتها را میشمارد

- دین هایسن جزئیاتی درباره انتخابش ارائه میدهد

- سرمربی سابق تیم ملی ارمنستان: پرتغال در هر پست ستاره دارد، ۰:۵ شاخص نیست

- «از تیم خود حمایت کنید» سرمربی سابق تیم ملی ارمنستان درباره تبلیغات رونالدو

- میناسیان، سرمربی سابق تیم ملی ارمنستان: اسپرتسیان از RPL پیشی گرفته است، وقت آن رسیده که به اروپا برود

- پپ گواردیولا به بزرگترین اشتباه خود اعتراف کرد

- یوونتوس به جذب کفرن تورام نزدیکتر شد

- امیلیانو مارتینز میگوید نه

- امباپه نظرات خود را در مورد ماههای اول همکاری با آلونسو در رئال مادرید به اشتراک میگذارد

- باشگاه بایرن مونیخ اعلام کرد که این باشگاه نیکلاس جکسون را از چلسی خریداری نخواهد کرد

- دامفریس، بازیکن اینتر: قطعاً به بازی در لیگ برتر علاقه دارم

- اویهان سانست توضیحاتی ارائه میدهد

- نیکو جکسون باخت پول را میپذیرد

- گزینه جدید فدریکو کیهزا

- لوکاش پودولسکی، مهاجم سابق تیم ملی آلمان، قهرمان یوروبسکت ۲۰۲۵ را پیشبینی میکند

- talkSPORT: برونو فرناندز پیشنهاد رونالدو برای پیوستن به النصر را رد کرد

- نیکلاس جکسون، بازیکن تازه وارد بایرن: ترک چلسی کمی ناراحت کننده بود

- عاملی که انتقال مارک گوئهی را نافرجام گذاشت

- کیلیان امباپه قرارداد ابراهیما کوناته را فعال کرد

- محاکمه خواکین پانیچلی با آتش

- کول در مورد افت فودن: فقط مسی میتواند ۱۵ سال به عملکرد خوبش ادامه دهد

- Defensa Central: امباپه میخواهد مهاجم فرانسوی به رئال مادرید بپیوندد

- مشخص شد که منچسترسیتی میتواند در زمستان کدام پست را تقویت کند

- معمای ادواردو کاماوینگا

- آنسو فاتی همچنان باعث بزرگ شدن گلوله برفی میشود

- رستگاری اودیسه

- مشخص شد که چرا برونو فرناندز در تابستان نظر خود را در مورد انتقال به الهلال تغییر داد

- دشان به انتقادات پیاسجی از فرانسه به خاطر مصدومیت دمبله و دوای پاسخ داد

- هافبک منچسترسیتی مورد توجه چندین باشگاه لیگ برتر و بایر لورکوزن قرار گرفته است

- ضربه سخت برای فدریکو کیهزا

- گزینهای که توسط لوکاس پرز رد شد

- هاروی الیوت باید پاسخ دهد

- نیکلاس جکسون: من به مارسکا احترام میگذارم، اما به چیز متفاوتی نیاز داشتم

- امباپه درباره مدعیان اصلی قهرمانی انگلیس صحبت کرد

- بایرن مونیخ از نیوکاسل به خاطر خرید ولتمد انتقاد کرد: «هیچ ربطی به فوتبال ندارد»

- کوین دی بروین، ناپولی را با منچسترسیتی مقایسه کرد

- منچسترسیتی همچنان روی سیستم جوانان خود سرمایهگذاری میکند

- منچستریونایتد میخواهد سه نفر را قربانی کند

- دروازهبان سابق منچسترسیتی درباره انتقال دوناروما به سیتیزنها صحبت میکند

- دروازهبان سابق منچسترسیتی، دوناروما و ترافورد را با هم مقایسه میکند

- اکیپ: پاری سن ژرمن از مصدومیت دمبله در بازیهای ملی خشمگین است

- مدیر برنامه تیاگو موتا بیانیهای منتشر کرد

- اسطوره آلمان در مورد شکست مقابل اسلواکی: «موسیالا به اندازه مسی غیرقابل جایگزین است.»

- باشگاه آژانساسپور: اسپارتاک برای جذب دیجیکا، مدافع فنرباغچه، ۵ میلیون یورو پرداخت خواهد کرد

- Skira: باشگاههای روسی به لووریچ، بازیکن اودینزه، علاقهمند هستند

- افشاگری بزرگ در مورد وینیسیوس جونیور و عربستان سعودی

- نگرانی در باشگاه آث میلان رو به افزایش است

- ورود ناامیدکننده رئال سوسیداد