- ارتباط با ما

- |

- درباره ما

- |

- نظرسنجی

- |

- اشتراک خبری

- |

- نگارنامه

به گزارش مجله خبری نگار،یان لیکان فکر نمیکند جنایتکاران و تروریستها بتوانند از سیستمهای هوش مصنوعی منبع باز برای اهداف پلید سوءاستفاده کنند. از سوی دیگر، چنین رویکردهایی به پول و منابع زیادی نیاز دارد و تا حدی بهراحتی دستیافتنی نیست.

سواستفاده از هوش مصنوعی منبع باز به راحتی مقدور نیست

یان لیکان در گزارشی که در ۲۲ دسامبر منتشر شد گفت: «برای چنین کاری، تبهکاران باید به ۲۰۰۰ پردازنده گرافیکی در جایی دسترسی داشته باشند که هیچکس نتواند آن را شناسایی کند. همچنین خلافکاران برای محقق ساختن چنین موضوعی، به پول کافی برای تأمین مسایل مالی و نیروهای متخصص به تعداد کافی برای انجام کار نیاز دارند.»

دانشمند ارشد متا میگوید کشورهای ثروتمند نیز احتمالاً نمیتوانند راهی برای کنترل هوش مصنوعی منبع باز پیدا کنند. متا یکی از حامیان اصلی رویکرد منبع باز در توسعه هوش مصنوعی بوده است. در ماه جولای، متا Llama ۲ را معرفی کرد که یک مدل عمدتاً منبع باز هوش مصنوعی است. سپس، در پنجم دسامبر، این شرکت با IBM با هدف حمایت از نوآوریهای مربوط به هوش مصنوعی وارد همکاری شد.

یان لیکان به ادعاهایی مبنی بر اینکه هوش مصنوعی یک تهدید برای بشریت است، توجه نشان نمیدهد و حتی در رویداد مطبوعاتی پاریس به خبرنگاران گفت که چنین اظهاراتی به طرز عجیبی مضحک هستند. او در پاسخ به این سوال که آیا هوش مصنوعی جهان را تسخیر خواهد کرد؟ پاسخ منفی داده و میگوید با چنین دیدگاهی نیز موافق نیست.

- لطفا از نوشتن با حروف لاتین (فینگلیش) خودداری نمایید.

- از ارسال دیدگاه های نا مرتبط با متن خبر، تکرار نظر دیگران، توهین به سایر کاربران و ارسال متن های طولانی خودداری نمایید.

- لطفا نظرات بدون بی احترامی، افترا و توهین به مسئولان، اقلیت ها، قومیت ها و ... باشد و به طور کلی مغایرتی با اصول اخلاقی و قوانین کشور نداشته باشد.

- در غیر این صورت، «نگارمگ » مطلب مورد نظر را رد یا بنا به تشخیص خود با ممیزی منتشر خواهد کرد.

ادعای متهمی که ۸ سال پس از قتل دستگیر شد

شمشیر دست من بود، محمود با سنگ به قتل رسید!

- آخرین اخبار

- محبوب

- برچسب های داغ

- بازیگر مشهور هالیوود: فلسطینیها! مردن در بیابان یا مردن در خانه

- CR7 با Siuuu در ساحل شنی شد + عکس

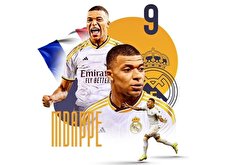

- رودیگر تأکید کرد: صندلی معروفی که فقط حق کهکشانیهاست + عکس

- دکور بزرگ «محفل» عیب نیست اما میتواند به یک افت تبدیل شود

- نپرداختن نفقه عامل بازداشت ستاره سابق سیتیزنها در برزیل

- پیدا و پنهان نمایشگاه| مهمانویژهای با چای کیسهای و خنجری در کمر!

- ماجرای تیراندازی در شهرک غرب چه بود؟ + فیلم

- ناصر الخلیفی به ضربالمثل "پول، خوشبختی نمیآورد" رسید؟!

- طرح MI۵ برای نفوذ در دانشگاههای انگلیس

- بازیکن تیم ملی فوتسال: دیدار با رهبر انقلاب برای من افتخار و قوت قلب بود

- پیدا و پنهان نمایشگاه| ناشری که بالاخره ماند و ناشری که هَوو پیدا کرد

- پولهای غرفه ترکیه در نمایشگاه کتاب سرقت شد

- سوت داور فوتبالیست نوجوان را به زندگی برگرداند

- زن سارق طلای کودکان در بیمارستانهای مشهد در دام پلیس؛ احضار ۷ طلا فروش به اتهام خرید طلاهای بدون فاکتور

- مرثیه مرگ ۶ میلیون نفر نخل

- جان بیماران بازیچه بلاگرها!

- از آیین سنتی «پنجاهبدر» مردم کهن شهر قزوین چه میدانید؟

- سوپرایز کردن اراکیها با توجیه «مردم عادت میکنند»!

- یکرزمنده و یک دنیا خاطره از کوههای استوار «بازیدراز»

- اگر دنبال آرامش میگردی، کتاب بخوان

- دلایل جهش بیت کوین به قله تاریخی

- بازار طلا، سکه نیست

- بازار طلا در پاییز سکه شد

- افت شدید انتظارات تورمی در بازار ارز

- طراحی نقشه راه جدید بازار ارز و طلای کشور

- حمله سهجانبه به بازار ارز

- فرمان مدیریت ارزی چگونه به میرداماد بازگشت

- نشانههای تداوم ثبات در بازار ارز

- سهامداران فنر موهوم ارز! چه جریانهایی به دنبال گران کردن ارز هستند؟

- آیا کرونا بازگشته است؟ سوغات سفرهای تابستانی سرماخوردگی، کرونا یا آنفلوانزا؟

- پاندمی هنوز تمام نشده، در دوره آتشبس با کرونا هستیم

- نگرانیها درباره شیوع سویه اریس کرونا

- دوز یادآور واکنش کرونا بهروزرسانی شود

- کرونا دلیجان را قرمز کرد

- اوجگیری مجدد کرونا در زمستان؟

- ژن ضد ویروسی در بدن انسان وجود دارد؟

- آمار جدید مبتلایان و فوتیهای کرونا در شبانهروز گذشته

- چند درصد دانشآموزان واکسن کرونا تزریق کردهاند؟

- برای کاهش شدت بیماری کرونا بینی خود را با آب نمک شستشو دهید

- توصیههای جدید CDC برای مقابله با ویروس کرونا

- امکان مواجهه با پاندمیهای جدید وجود دارد

- از ۱۱ سویه کدام مسریتر است؟

- افزایش آمار روزانه مبتلایان کرونا در هند

- شناسایی ۱۷۹ بیمار جدید کووید۱۹ در کشور

- تزریق بیش از ۲۰ هزار دز واکسن در شبانه روز گذشته

- احتمال شکلگیری پیک کرونا در سه ماه آینده/فقط ۱۶ درصد از دانشآموزان ۵ تا ۱۱ سال واکسینه شدن

- آخرین رنگبندی کرونایی شهرهای کشور/ افزایش تعداد شهرهای آبی

- هشدار به افرادی که ۳ دوز واکسن نزده اند: محرومیت از خدمات!

- کرونا مانند بیماری آنفلوانزا خواهد شد/ واکسیناسیون کرونا در سالهای آینده داوطلبانه میشود

- کاهش بی سابقه حجم معاملات سهام در بورسهای جهانی

- رشد شاخصهای بورس با کمک بانکیها و اعلام نرخ تسعیر ارز

- حمله به سفیر روسیه در لهستان

- معرفی سری گوشیهای Redmi K ۵۰ قبل از رونمایی رسمی

- غفوری: فکر کردن به قهرمانی از الان، سادهلوحانه است

- کاهش ۱۰ درصدی تولید هوندا در دو کارخانه

- سومین نشست دستمزد، باز هم بدون نتیجه

- لغو بلیت فروشی عمومی المپیک زمستانی چین

- گرامیداشت قربانیان هواپیمای اوکراینی در دانشگاه تورنتو

- ادامه چانهزنی چهارگانه در وین

- صرفهجویی ۱.۶ میلیارد دلاری کمیته برگزاری المپیک و پارالمپیک توکیو

- محبوبترین رشته المپیک توکیو مشخص شد

- اعلام هزینه میزبانی توکیو از المپیک و پارالمپیک ۲۰۲۰،

- آذرتاج: هیات اقتصادی جمهوری آذربایجان به ایران میرود

- بررسی عملکرد ایران در المپیک؛ جایگاه چهارمی در آسیا

- پایان وضعیت اضطراری در کشور میزبان المپیک ۲۰۲۰

- ماجرای دوچرخهی المپیک به وزیر کشیده شد/ بهتاج: امیدوارم ختم به خیر شود

- تمجید رییس کمیته پارالمپیک آسیا از نتایج ورزشکاران ایران در توکیو

- تابع: پیشبینیهای ما در خصوص مدالهای طلای پارالمپیک محقق شد

- لیموچی: عملکرد زنان ورزشکار ایران در پارالمپیک درخشان بود

- رضایی: کاروان ایران نمره قبولی خود را در پارالمپیک توکیو کسب کرد

- رژه پوشش اسلامی پیش چشم جهانیان

- صالحی امیری: آوردگاه توکیو میدان درخشش انسانهای مظلوم، ولی مقتدر بود

- برترین فرنگیکاران جهان معرفی شدند/ «محمدرضا گرایی» در صدر ایستاد

- چین قهرمان بازیهای پارالمپیک شد/ ایران در رده سیزدهم قرار گرفت

- پارالمپیک ۲۰۲۰| جوانمردی پرچمدار کاروان ایران در مراسم اختتامیه

- ساره جوانمردی پرچمدار ایران در اختتامیه پارالمپیک شد

- پیروزی رایحه شهاب در جدول شانس مجدد رقابتهای پاراتکواندو

- «عزیزی اقدم» به نیمه نهایی رقابتهای پاراتکواندو رسید

- پارالمپیک توکیو؛ پرتابگر وزنه ایران به عنوان ششم بسنده کرد

- فیلم| روایت شیرین دخترانه از دیدار قهرمانان و ورزشکاران با رئیسجمهور

- روایت خانواده ۷ نفره سمنانی از یک خانه شلوغ و بانشاط

- راهنمایی برای مهمترین فیلمهای تابستان داغ سینماها؛ از بازگشت پادشاهی میمونها تا درون بیرون ٢

- وقتی مردم عادی هدف حملات منافقین قرار میگیرند!

- سفر به اعماق بزرگترین راز کیهان

- معیشت؛ دغدغه مرجعیت

- هشدار نسبت به دفن زباله در منطقه انجیلسی/ رئیسجمهور به داد مردم مومن منطقه أنجیلسی برسد

- مهلت ۳ ساله برای انتقال آلاینده کربن بلک از اهواز

- ریل گذاری برای تامین مالی غیرتورمی

- وقتی همه فکر میکنند رئال مرده است به یکباره زنده میشود!

- فیلم| آخرین تلاشها برای یافتن پیکر «سبحان هنرمند»

- احساس پشیمانی آقای خاص از رد کرد پیشنهاد تیم ملی پرتغال

- زنبورها هم به ارتش اسرائیل حمله کردند

- نظرسنجی روزنامه اسرائیلی؛ یک سوم صهیونیستها، دیگر «اسرائیل» را محل مناسبی برای زندگی نمیدانند

- کریستین استوارت و اسکار آیزاک در فیلم جدید کارگردان «مندی»

- تفاوت و شباهت اشتباه دو سنگربان مانشافت در UCL و جام جهانی

- این تصمیم سرمربی پیاسجی به مذاق اسطوره مانشافت خوش نیامد

- مارگارت کوالی، اد هریس و گلن پاول به پروژه جدید کارگردان «امیلی جنایتکار» پیوستند

- آقای وزیر آرژانتینی، تهدید ستاره آلبی سلسته را قاچاق-تروریسم نامید

- مسی متواضع بود و از خجالت سرش را پایین گرفت

- سفر اندرو گارفیلد و کلر فوی به سرزمین جادویی نویسنده محبوب کودکان

- تعداد زیادی از افراد اظهار داشتند که پیامهای خصوصی سیگنال آنها در دادگاهها یا رسانههای آمریکاعلیه آنها استفاده شده است

- گیلاس روی کیک خانه جدید بارسلونا مجوز گرفت

- به نام ما و به کام ترکیه: دومین چرم گرانقیمت جهان

- ملیپوش والیبال دانشآموزی: دیدار با رهبر انقلاب دل بازیکنان و کادر فنی را شاد کرد

- حداد عادل: من خودم تا امروز خانه نیما نیامده بودم!

- شرط رسیدن وینیسیوس و امباپه به توپ طلای ۲۰۲۴؛ فتح UCL یا یورو

- جنون و هیجان را باید در کامبک ما مقابل سیتیزنها دید

- دولت آب را برای سمنان تأمین میکند؛ اما جمعیت را چه کنیم؟

- تیفوسیهای بانوی پیر هم رو به تحریم آوردند

- سرهنگ قلابی برای گرفتن نان بدون نوبت دعوا به راه انداخت

- اوراق دولتی روی دست دولت ماند! بررسی روند تامین مالی دولت قبل و بعد ازشوک انتشار گواهی سپرده ۳۰ درصد

- آشتی مهران مدیری و تلویزیون؟

- شلیک به دموکراسی پوشالی غرب؛ یک نظرسنجی با معنا در اتحادیه اروپا

- مواظب دندانتان باشید تا سرطان نگیرید!

- ۶ ماه به انتخابات آمریکا، بایدن از ترامپ پیشی گرفت

- محکومیت بیش از ۴ میلیاردی پزشک متخلف اردبیلی

- چرا خراسانشمالی باید «شرکت هواپیمایی» تاسیس کند؟

- جزییات ممنوعیت دی جی در کیش

- اخبار داغ

- ورزشی

- پربیننده

- پربحث

- ۶ کشته و زخمی در حادثه سقوط خودرو به دره در ارتفاعات ته ته پاوه

- رئیس سازمان پروپاگاندای اسرائیل استعفا میدهد

- حکمرانی در ۵۸۰۰ کیلومتر مرز آبی لازمه توسعه اقتصاد دریا محور است

- یک نویسنده: باید چهره واقعی شهید را نشان دهیم، نه فقط خوبیهایش را

- بیمه به خسارت دیدگان شفت چک میدهد

- چرا سپاهان در لیگ برتر ناکام ماند؟

- چشم انتظاری مردم بشاگرد برای اتصال دکل صدا و سیما

- موزه ملی انقلاب و دفاع مقدس جذابتر میشوند

- تولید صنایع در ماه اول بهار آب رفت + جزئیات

- حجتالاسلام سرلک: برخی نویسندگان امروز به گمان کاذب بینیازی دچارند

- ۱۳۰ هزارمیلیارد تومان بدهی دولت به تامین اجتماعی پرداخت میشود

- دانشگاهیها تشنه این هستند که بگویند چه کاری میخواهند انجام دهند تا آن کار را حل کنند

- حرکت لاک پشتی، وعده تازه نهضت ملی مسکن باغمیشه که ۵ ساله شد

- رونمایی کتاب مرد عراقی که نیروی اطلاعاتی ایرانیها در جنگ تحمیلی شد

- حماس: مذاکرات آتشبس، پوشش اسرائیل برای حمله به رفح است

- یادداشت: تولید حکمت و تربیت حکیم در دانشگاهها

- بیمارستان هفت تیر ظرفیت پذیرش مصدومان هنگام زلزله را دارد؟

- تازههای گلعلی بابایی در نمایشگاه کتاب

- حمله زمینی غافلگیرانه روسیه به شمال شرق اوکراین

- وکیل متخلف با شکایت رئیس کانون وکلا تعلیق شد + اسناد

- توافق برای خرید نخستین «چک ولو» تولیدی با فناوری ایرانی

- استقبال از نمایشگاه کتاب، اینترنت همراه را مختل کرد

- آمریکا نقض قانون توسط اسرائیل را تأیید کرد؛ تنبیه در کار نیست

- عضو شورای شهر اهواز، انتشار فایل صوتی حمایت از شهردار را تکذیب کرد

- دنیا به بازنده بودن رژیم صهیونیستی اعتراف دارد

- تلفیق علوم و فناوری با سنت در حکمرانی امروز ضرورت است

- تحلیلگر آمریکایی: حماس به ۹۰ درصد نقاط غزه بازگشته است

- شکست باجخواهی صهیونیستها از مقاومت

- فاصله معنادار تورم اجاره بها از تورم عمومی و خرید مسکن

- دیگر نمیگویند گزینه نظامی روی میز است؛ مرگ بر اسرائیل به زبان فارسی در آمریکا

- شوک دوباره نظرسنجیها به نتانیاهو

- بلبشو در انتظار بازار مرغ؟! بازهم تصمیمات خلق الساعه مدیران وزارت جهاد

- ارمغان اتکا بر دانش متخصصان ایرانی: ضرورت افزایش ظرفیت پالایشگاههای نفتی و صادرات/ مسیر توسعه صنایع نفتی و تکیه بر توان متخصصان داخلی هموار است

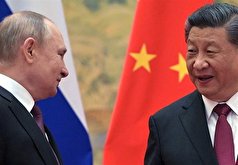

- تبریک چین به پوتین و تداوم روابط راهبردی ۲ ابرقدرت

- طلب خسارت ۵۷ میلیون دلاری «شورون» بابت توقیف نفت توسط ایران

- امیر ایرانی: تجهیزات جدیدی به ناوگان نیروی دریایی اضافه میشود

- یک نهاد سازمان ملل: ۳۶۵ بار به ما در غزه حمله شده است

- سناتور آمریکایی: میلیاردها دلار کمک تسلیحاتی به اسرائیل انجام دادهایم

- کار حل تعارض مدیریتی در مناطق آزاد به دوش قوه قضاییه افتاد

- اسرائیل: عملیات در رفح تا زمان بازگشت گروگانها ادامه دارد

- مسکو: عملیات نظامی اسرائیل در رفح باعث تشدید اوضاع میشود

- نماینده آمریکایی: حمله پلیس به دانشجویان با گلولههای پلاستیکی مایه ننگ است

- شهردار یا آبفا؛ مقصر اصلی آبگرفتگی اهواز کیست؟

- سرطان خون در کمین کودکان گلستانی

- درخواست گروههای حقوق بشری از رئیسجمهور آمریکا با محوریت جنگ غزه

- استرالیا: تاثیرات حمله نظامی گسترده به رفح ویرانگر خواهد بود

- روسیه: انگلیس در توجیه اخراج وابسته دفاعی ما آشکارا دروغ میگوید

- مدیرکل ارشاد: مستند شهدای شاخص استان تهران در حال تولید است

- آیتالله جوادی آملی: رفع مشکلات اقتصادی نیازمند تربیت افراد متخصص است

- مخالفت گروههای فلسطینی با واگذاری گذرگاه رفح به طرف خارجی

- تیم انریکه سرعت لازم برای بازی در لیگ قهرمانان را نداشت

- استعداد بنفیکا قرار است جانشین هافبک برزیلی در اولدترافورد شود

- مولر: دبل مشکوک به آفساید رونالدو مقابل بایرن دوباره زنده شد

- امانوئل پتی: دییونگ به درد بارسلونا نمیخود

- پدیده ۱۷ ساله کاتالان با دستمزدی تصاعدی در نیوکمپ ماندنی شد

- توپچیها هافبک ایتالیایی را در امارات نگه داشتند

- دیویس: در حال مذاکره با باواریاییها هستیم و از آنها تشکر میکنم

- ژاوی رومئو را برای جانشینی بوسکتس میخواهد

- مهاجم سوئدی کلاغها در رادار توپچیها

- استریمر معروف امباپه و خسلو را اینگونه مقایسه کرد

- آنری: وینی را در خاطر داشته باشید او بالاتر از امباپه و بلینگام است

- مارکینیوش: ما پروژه جدیدی را شروع کردیم و نباید دور ریخته شود

- مذاکرات باواریاییها با اینجنت مربی هلندی شیاطین سرخ متوقف شد

- چشمک نیمکتهای آلیانتس آرنا به فلیک در روزهای پساتوخل

- وینیسیوس: در برنابئو هر کاری میتوانیم بکنیم

- لیگ جزیره نامزدهای بهترین بازیکن و مربی فصل ۲۴-۲۰۲۳ را لیست کرد

- ۳ ستارهای که قطعا در لیست فروش شیرهای لندن در تابستان ۲۰۲۴ هستند

- بانوی پیر بازیکن متهم شدن به شرط بندی را در بازیها انتهایی فصل در اختیار خواهد داشت

- در چه صورتی ستاره قرضی زنبورها به خانه شیاطین سرخ برمیگردد؟

- رویس با یک خداحافظی خاطرهانگیز جمع زنبورها را ترک میکند

- تصویری که شایعات درباره مهاجم لکلکها را پررنگتر کرد

- بهترین فوتبالیست جوان لیگ جزیره از بین کدام بازیکنان انتخاب خواهد شد

- شوامنی بازی در ومبلی را تجربه نخواهد کرد

- دو ستاره اصلی شیاطین سرخ برای زنده کردن سهمیه اروپایی به تمرینات اضافه شدند

- ستاره دفاعی شیرهای لندنی با یک خداحافظی باشکوه باشگاه را ترک میکند

- دژ مستحکم زنبورهای عامل رد پیشبینی مفتضح آرسن ونگر

- هافبک فرانسوی لوسبلانکوس چند بازی را از دست داد

- شیاطین سرخ در حال اغوای پدیده ۱۷ سال بلوگرانا

- پرز پاداش خوسلو را با انتقال دائمی به برنابئو خواهد داد

- ستاره منفور شیاطین سرخ در رادار مدیران نیوکمپ

- پالمر: اولین فصل حضورم در چلسی بهتر از آن چیزی بود که فکر میکردم

- شیرهای لندن هاچینسون را از چمپیونشیپ فراخواندند

- دیدار جذاب لیگ برتر؛ اولین تقابل نویدکیا و سپاهان

- باشگاه دوران کودکی در انتظار جوان هلندی بوندسلیگا

- بازیکن شیلیایی پایان فصل با بنیتو ویامارین خداحافظی میکند

- ام باپه در باره آخرین بازی خود در پاریس: کسی از آینده اطلاعی ندارد

- تیرزنترن تیم UCL مشخص شد!

- ستاره زنبورها به مسی و سایر ستارگان MLS میپیوندد؟

- امباپه فقط بلد است به جبل الطارق گل بزند! مسی و نیمار هم سن او بودند در بازیهای مهم تأثیرگذار بودند

- آمار ۸۳٪ باخت در نیمه نهایی UCL برای پاریسیها

- افعیها وکلاغها به مشتریان مدافع فرانسوی بلوگرانا پیوستند

- هافبک هلندی بارسا قربانی ستاره سیتی میشود؟

- باسلر: برای یک فصل نیمکت آلیانتس آرنا را به آقای خاص بسپارید

- کاراگر: کاسمیرو همین تابستان منچستر ار ترک کن!

- راه چکشها و مویس در پایان فصل جدا میشود

- لورکوزن رقیب تیم ژاوی برای جذب هافبک خیرونا شد

- آنالیز ترکیب بلوگرانا صحبتهای ژاوی را رد میکند!

- روخیبلانکوس ژوائو را به خانه برمیگرداند

- کرهایها به یک مربی ترک در پساکلینزمن رو آوردند؟!

- هواداران بایرن از بین ۲۳ مربی فاتح ۶ گانه را میخواهند