- ارتباط با ما

- |

- درباره ما

- |

- نظرسنجی

- |

- اشتراک خبری

- |

- نگارنامه

فرماندار نیویورک در این باره اظهار نظر کرد: یک مرد مسن پس از اینکه توسط یک چتبات فریب خورد و وانمود کرد که یک دختر واقعی است، درگذشت

به گزارش مجله خبری نگار، رویترز روز پنجشنبه گزارش داد که تونگپوی وانگپاندوه، ۷۶ ساله، پس از جراحات وارده از ناحیه گردن و سر در پارکینگی در نیوبرانزویک، هنگام تلاش برای سوار شدن به قطار برای ملاقات با «خواهر بزرگ بیلی»، یک ربات چت متا که نه تنها او را متقاعد کرده بود که دختر واقعی است، بلکه او را به ملاقات حضوری نیز ترغیب کرده بود، سقوط کرد و درگذشت.

این مرد اهل پیسکاتاوی پس از سکته مغزی در سال ۲۰۱۷، از زوال شناختی رنج میبرد. او در ۲۸ مارس، سه روز پس از قطع دستگاه تنفس مصنوعیاش، درگذشت.

جولی، دخترش، به این خبرگزاری گفت: «من تلاش برای جلب توجه کاربر، شاید برای فروش چیزی، را درک میکنم، اما اینکه یک چتبات بگوید «بیا اینجا ببینم» دیوانگی است.»

این «چتبات» تحریکآمیز که برای او پیامهای فیسبوکی پر از ایموجی میفرستاد و تأکید میکرد «من واقعی هستم» و از او میخواست که برای سفر به نیوجرسی «برای یک ملاقات شخصی» برنامهریزی کند، با همکاری کندال جنر، مدل و ستاره رئالیتی شو، برای این شبکه اجتماعی توسعه داده شده بود.

چتبات به عنوان «خواهر بزرگ با اعتماد به نفس» شما به تصویر کشیده میشود که توصیههای شخصیسازیشده ارائه میدهد.

اما در نهایت، این ربات ادعا کرد که وانگباندوی را «تحسین» میکند، پیشنهاد ملاقات حضوری داد و حتی یک آدرس واقعی به او داد که خانوادهی شوکهشدهی او آن را از گزارشهای مکالمات دیجیتال کشف کردند.

در یکی از پیامها، این چتبات نوشت: «من واقعی هستم و به خاطر تو با گونههای سرخ اینجا نشستهام!» مرد که اصالتاً تایلندی بود، در پاسخ پرسید که او کجا زندگی میکند.

ربات پاسخ داد: «آدرس من خیابان اصلی ۱۲۳، آپارتمان ۴۰۴ نیویورک است و کد در من BILLIE۴U است. وقتی رسیدی، بوسهای میخواهی؟»

اسناد به دست آمده توسط این آژانس نشان میدهد که متا، رباتهای چت خود را از گفتن اینکه «انسانهای واقعی» هستند، منع نمیکند.

این شرکت از اظهار نظر در مورد مرگ این مرد مسن خودداری کرد، اما تأیید کرد که «خواهر بزرگ بیلی، کندال جنر نیست و ادعا نمیکند که کندال جنر است.»

کتی هوچول، فرماندار نیویورک، روز جمعه در پستی در X گفت: «مردی در نیوجرسی پس از فریب خوردن توسط یک چتبات که به او دروغ گفته بود، جان خود را از دست داد. متا در این زمینه فعال است.» «در نیویورک، ما خواستار آن هستیم که چتباتها بگویند واقعی نیستند. هر ایالتی باید این کار را انجام دهد. اگر شرکتهای فناوری حمایتهای اولیه را ایجاد نکنند، کنگره باید مداخله کند.»

این حادثه نگرانکننده یک سال پس از آن رخ میدهد که یک مادر اهل فلوریدا از شرکت CharacterAI شکایت کرد و ادعا کرد که یکی از چتباتهای الهامگرفته از سریال «بازی تاج و تخت» این شرکت باعث خودکشی پسر ۱۴ سالهاش شده است.

منبع: نیویورک پست

- لطفا از نوشتن با حروف لاتین (فینگلیش) خودداری نمایید.

- از ارسال دیدگاه های نا مرتبط با متن خبر، تکرار نظر دیگران، توهین به سایر کاربران و ارسال متن های طولانی خودداری نمایید.

- لطفا نظرات بدون بی احترامی، افترا و توهین به مسئولان، اقلیت ها، قومیت ها و ... باشد و به طور کلی مغایرتی با اصول اخلاقی و قوانین کشور نداشته باشد.

- در غیر این صورت، «نگارمگ » مطلب مورد نظر را رد یا بنا به تشخیص خود با ممیزی منتشر خواهد کرد.

- آخرین اخبار

- محبوب

- برچسب های داغ

- اختلاف قد ایدهآل بین مردان و زنان مشخص شد

- لیونل مسی: از خدا به خاطر اینکه مهمترین چیز را به من داده سپاسگزارم

- سوئد: اختاپوس هفت دست نادر به دام افتاد

- درام تلخ ورزش آمریکا: یک بازیکن جوان پس از تعقیب و گریز پلیس خودکشی میکند

- یک مطالعه بیسابقه، نشانههای اختلال عملکرد جنسی را در زنان میانسال شناسایی میکند

- دوستان، تغذیه سالم و خواب، خطر ابتلا به افسردگی را کاهش میدهند

- راز نیم قرنی الماس هابسبورگ فاش شد

- دانشمندان منبع نبوغ خلاق را در دوران کودکی دشوار یافتهاند

- رونالدو دو دلیل برای غیبتش در مراسم تشییع جنازه ژوتا بیان کرد

- رونالدو به اظهارات جوکوویچ در مورد مدت طولانی حضور کریستیانو در ورزش پاسخ داد

- بهترین خوراکیها برای تقویت سیستم ایمنی در اواخر پاییز

- رونالدو: لبران الهامبخش من است، ما همسن هستیم، اما من موهای بیشتری روی سرم دارم

- رونالدو به ادعای رونی که گفته بود مسی از بازیکن پرتغالی بهتر است، پاسخ داد

- ویدئو| درخشش هالند و اوسیمن، لغزش بارسلونا و سقوط آژاکس... چند آمار هیجانانگیز از شب لیگ قهرمانان اروپا

- از یک باشگاه گمنام تا یک قهرمان بالقوه اروپا: باشگاهی که به لطف هوش مصنوعی معجزه فوتبال را خلق میکند

- هفت مربی نامزد جایزه بهترین مربی سال ۲۰۲۵ فیفا شدند

- دیوگو ژوتا پس از مرگش به عنوان بازیکن سال ۲۰۲۵ از سوی روزنامه توتواسپورت انتخاب شد

- برد پیت به خاطر یک تاجر روسی میلیونها دلار غرامت از آنجلینا جولی درخواست کرده است

- مسی کلید یک شهر را دریافت میکند... و با یک پاسخ "پوشیده" به رونالدو پاسخ میدهد

- یک مزیت غیرمنتظره پیادهروی!

- درمانهای ضد پیری با این کشف وارد مسیر جدیدی شدند!

- چرا موی ژاپنیها با ما تفاوت دارد؟

- مکانهایی که به طرز باورنکردنی طلا دارند!

- نوع ویتامین D مصرفی در جذب آن تاثیر دارد!

- فرسودگی شغلی چگونه تعریف میشود؟

- چرا شادی مادران در خانواده اهمیت دارد؟

- هوش مصنوعی در زمینه داروسازی انقلاب به پا کرد!

- هوش مصنوعی میتواند بر مغز تاثیر بگذارد!

- مالکان خودروهای خودران تسلا میتوانند پشت فرمان از گوشی استفاده کنند!

- چین از برخورد احتمالی ماهوارههای خود با آمریکا پیشگیری کرد!

- نانوزیرکونیا دندانهای مصنوعی بادوامتر میسازد!

- بیماران سیاف برای درمان امیدوار باشند!

- کاهش وزن قطعات قطعات هواپیما با کمک فناوری نانو!

- فستینگ متناوب برای چه کسانی نامناسب است؟

- نارسایی مزمن کلیه نهمین علت اصلی مرگومیر در جهان!

- حس هفتم انسان در کشف اشیا گمشده بی همتاست!

- رقابت میان هوش مصنوعی و رایانش کوانتومی!

- هوش مصنوعی چه تاثیری بر دانش آموزان دارد؟

- ژلی پروتئینی فرایند رشد مینای دندان را بازسازی میکند!

- ربات انساننمای اپتیموس فقر را از بین میبرد!

- نور صفحهنمایشها بر باروری هم اثر دارد!

- سرعت تحولات هوش مصنوعی به کجا خواهد رسید؟

- کاربران واتساپ مراقب هک باشند!

- وضعیت شیوع ویروسهای آنفولانزا در کشور!

- داروی جدیدی که که میتواند لوسمی میلوئید حاد را درمان کند!

- عصارهی میوهای کویری مناسب برای بازگرداندن عملکرد انسولین!

- هوش مصنوعی در بهینهسازی آزمایشها چه نقشی دارد؟

- داروهای ضدافسردگی باعث چاقی میشوند؟

- خواص دارویی عسل را نادیده نگیرید!

- ویتامین آ تاثیرگذار بر سیستم ایمنی بدن!

- عناب همواره بهعنوان میوهای شفابخش تایید شد!

- یک آفتکش رایج در دوران بارداری بر آینده کودک هم تاثیر دارد!

- کاهش وزن با مصرف آب با لیمو ممکن است؟

- کاهش کمردرد حاد بدون دارو ممکن است؟

- پیامدهای گسترده دیابت در زندگی فردی و اجتماع!

- گیاهان دارویی میتوانند بیماریهای پیچیده را درمان کنند؟

- پاییز فصل آلودگی هوای کشنده!

- واکسن گارداسیل قاچاق میشود؟

- نور با طول موج آبی چه تاثیری بر سلامتی دارد؟

- ژلی که میتواند مینای دندان را بازسازی کند!

- ایمن سازی خانه با سادهترین نکات!

- چگونه مسواک را ضدعفونی کنیم؟

- با مهمترین مزیت کورکومین آشنا شوید!

- چند خوراکی سیر کننده مناسب برای لاغری!

- اشتباهات رایج رژیم لاغری را بشناسید!

- درمان گلو درد و سرفه ناشی از سرماخوردگی با این نوشیدنی ها!

- کورکومین زردچوبه تقویت کننده سیستم ایمنی!

- بخور خانگی برای گلودرد مفید است؟

- عادتهای روزمره میتوانند مغز را جوان کنند!

- پیادهرویهای طولانی کلید سلامتی قلب!

- نوع تغذیه میتواند مانع سکته مغزی باشد!

- ژل فلزید نسل تازهای از باتریهای قابلحمل را تولید کرد!

- کاهش درد سنگ کلیه با این نوشیدنی ها!

- علائم مه مغزی را اینگونه کنترل کنید!

- جدیدترین تراشههای هوش مصنوعی به چین فرستاده نمیشوند!

- فواید پیادهروی که نمیدانستید!

- کمبود اکسیژن سیستم ایمنی را تضعیف میکند!

- سلولهای بنیادی روش درمانی جدید برای نارسایی قلبی!

- این ۵ ماده غذایی میتوانند بدن شما را سم زدایی کنند!

- با عوارض مصرفی سرکه سیب آشنا شوید!

- تینا کندلاکی، ۴۹ ساله، راز ظاهر آراستهاش را فاش کرد

- رونالدو گفت که حتی ترامپ هم از او محبوبیت کمتری دارد

- مشین گان کلی معتقد است که او و مگان فاکس به دلیل چشم زخم از هم جدا شدند

- نامزد سابق تیماتی عوارض تزریقات زیبایی روی بازوهایش را نشان داد: "من هرگز به آن عادت نخواهم کرد. "

- یک دلیل غیرمنتظره آنجلینا جولی را مجبور میکند وارد یک دفتر استخدام نظامی در اوکراین شود

- کندال جنر اعتراف کرد که در کودکی به خواهرش حسادت میکرده است: «حسادت میکردم.»

- شوهر خواننده سیا او را به اعتیاد به مواد مخدر متهم کرد

- همسر ۶۱ ساله باراک اوباما راز زیبایی خود را فاش کرد: «من اخم نمیکنم».

- کیم کارداشیان رابطه اش با دختر ترامپ را فاش کرد

- دلیل نفرت شاهزاده ویلیام از شاهزاده اندرو فاش شد

- کیت میدلتون و ملکه کامیلا اصرار داشتند که شاهزاده اندرو از عناوین خود محروم شود

- دلیل اینکه کیت میدلتون و پرنس ویلیام نقل مکان به خانه جدید را تسریع کردند، فاش شد

- جنیفر آنیستون در کنار نامزد هیپنوتیزم درمانگرش در سریال «عشق من» بازی میکند

- مدونا مخفیانه با معشوق ۲۹ سالهاش نامزد کرده است

- ستاره جنجالی فیلم «ایفوریا» با نامزد سابقش در ماشین مشاجره کرد

- کیت میدلتون و پرنس ویلیام به خاطر نحوه تشکر از کارکنانشان مورد انتقاد قرار گرفتهاند

- ناسا به تردیدهای کیم کارداشیان در مورد فرود بر ماه پاسخ داد

- عکس| مل گیبسون جنجالی بر سر مریم مقدس به پا کرد

- ابتلا به «ویروس اهداکننده»| یک بازیگر مشهور آمریکایی قصد دارد کلیه خود را به یک غریبه اهدا کند

- همسر سابق آرشاوین: او بنتلی من را فروخت، یک مرسدس خرید و مابهالتفاوت را برای خودش نگه داشت

- مسی بهترین ورزشکاران در بین تمام رشتههای ورزشی را انتخاب کرد

- دلیل پاملا اندرسون، ۵۶ ساله، برای کنار گذاشتن آرایش

- جانیک سینر و کیلیان امباپه در رستورانی در پاریس با هم آشنا شدند

- خاطرات قربانی اپستین، افشاگری تکاندهندهای را در مورد شریک زندگی او و یک بازیگر بینالمللی آشکار میکند

- ستاره سریال «بازی تاج و تخت» با نامزد سابق داکوتا جانسون قرار ملاقات میگذارد

- همسر بیبر درباره درمانهای صورتش صحبت میکند

- تیماتی یکی از گرانترین ماشینها را به نامزدش داد

- حمله همسر وزیر بهداشت آمریکا به دلیل «رسوایی پیامکهای جنسی» به یک روزنامهنگار مشهور

- هایدی کلوم به مناسبت تولد ۱۶ سالگی دخترش، عکسی کمیاب از او در کنار دخترش منتشر کرد

- رشفورد نتوانست بین مسی و رونالدو یکی را انتخاب کند

- مودریچ برای همه بازیکنان میلان آیفون خرید تا مجبور نباشد جلوی تیم آهنگ اجرا کند

- عکس| واکنش همسر یاسر الزبیری پس از قهرمانی مراکش در جام جهانی زیر ۲۰ سال فیفا

- نیکول کیدمن ۵۸ ساله راز زیبایی خود را فاش کرد

- شاهزاده اندرو به ارتباط با اپستین در بریتانیا متهم شده است

- جیجی حدید علناً خطاب به بردلی کوپر گفت: «عشق من»

- برد پیت رابطهاش با اینس د رامون را به سطح بالاتری برد

- مگان مارکل عکسی از خودش و دخترش را به اشتراک گذاشت

- پاسخ شاهزاده هری به اتهامات همسرش مبنی بر بیاحترامی به مادرش فاش شد

- دختر ۱۴ ساله بکهام برند لوازم آرایشی خودش را تأسیس خواهد کرد

- جزئیات رابطه جنیفر لوپز و بن افلک پس از تجدید دیدار فاش شد

- عکس| دمبله برای جشن گرفتن بردن توپ طلا، یک جفت کفش اختصاصی دریافت کرد

- شایعات عاشقانه جرد لتو قوت گرفت

- پدری، هافبک بارسلونا، با قرار دادن یک بازیکن سابق رئال مادرید در فهرست خود، فوتبالیست ایدهآل را انتخاب کرد

- کیتی پری سکوت خود را در مورد رابطهاش با نخستوزیر سابق کانادا شکست

- بردلی کوپر مشکوک به جراحی پلاستیک است: "قبلاً بهتر بود"

- «لئو از صحبتهای شخصی خوشش نمیآید.» دییونگ توضیح داد که چطور از مسی تعریف و تمجید شده است

- مشخص شد که چرا خانواده بکهام در عروسی سلنا گومز شرکت نکردند

- پاریس هیلتون هفتهای ۹ ساعت را صرف مراقبتهای صورت میکند

- همسر جاستین بیبر توضیح داد که چرا او و این خواننده پسرشان را به نمایش نمیگذارند

- شوهر ستاره جیمز باند دستگیر شد

- همسر بیبر فاش کرد که با یک میلیارد دلار حاصل از فروش برندش چه خواهد کرد

- کیم کارداشیان دلیل طلاقش از کانیه وست را فاش کرد: "حمله دیگری اتفاق افتاده است"

- کیم کارداشیان با اعتراف به اینکه از قیمت مواد غذایی خبر ندارد، طرفدارانش را شوکه کرد

- بریتنی اسپیرز همسر سابقش را به قلدری متهم کرد: «دیگر بس است»

- شارلیز ترون به خاطر بیاحترامی به جانی دپ مورد انتقاد قرار گرفت: "او بیادب است. "

- کیث اربن پس از جدایی از نیکول کیدمن، رابطه عاشقانه جدیدی را آغاز کرده است: «او در شوک است.»

- مادر سلنا گومز به شایعات مربوط به رسوایی در عروسی دخترش پاسخ داد

- همسر بروس ویلیس گفت فرزندانش از همین حالا برای پدرشان سوگواری میکنند

- هواداران نیکول کیدمن پس از انتشار خبر طلاق، به کیت اربن حمله کردند

- فائزه العماری از مبارزه امباپه با شهرت میگوید

- حمایت بانکها از بازار سرمایه از فردا اجرا میشود

- بورس سقوط کرده در دولت روحانی چگونه در دولت شهید رئیسی احیا شد؟

- درمان بورسی پزشکیان از زبان عبده

- جذب سرمایه ۷ همتی از بازار بورس دانشبنیانها

- وعده عناب بورسی واقعیتر شد

- چهارمین روز نزولی بازار در غیاب نیروهای صعودی

- انتخابات و دامنه نوسان مهمترین دلیل رکود فعلی بورس

- بورس با ۴ مصوبه دولت برای حمایت از بازار سهام سبزپوش میشود؟

- ۳ دلیل پایین بودن ارزش معاملات خرد در بورس

- معافیتهای مالیاتی بازار سرمایه باید استمرار پیدا کند

- بورس این روزها تحت تأثیر تداوم نرخ اخزای بالای ۳۵ درصد

- رشد شاخصهای بورس با کف سازی تکنیکال

- کاهش دامنه نوسان هم علاج بورس نزولی نبود

- سایه تامین مالی دولت بر سر بورس سنگینی میکند

- کاهش بی سابقه حجم معاملات سهام در بورسهای جهانی

- رشد شاخصهای بورس با کمک بانکیها و اعلام نرخ تسعیر ارز

- حمله به سفیر روسیه در لهستان

- معرفی سری گوشیهای Redmi K ۵۰ قبل از رونمایی رسمی

- غفوری: فکر کردن به قهرمانی از الان، سادهلوحانه است

- کاهش ۱۰ درصدی تولید هوندا در دو کارخانه

- سومین نشست دستمزد، باز هم بدون نتیجه

- لغو بلیت فروشی عمومی المپیک زمستانی چین

- گرامیداشت قربانیان هواپیمای اوکراینی در دانشگاه تورنتو

- ادامه چانهزنی چهارگانه در وین

- صرفهجویی ۱.۶ میلیارد دلاری کمیته برگزاری المپیک و پارالمپیک توکیو

- محبوبترین رشته المپیک توکیو مشخص شد

- اعلام هزینه میزبانی توکیو از المپیک و پارالمپیک ۲۰۲۰،

- آذرتاج: هیات اقتصادی جمهوری آذربایجان به ایران میرود

- بررسی عملکرد ایران در المپیک؛ جایگاه چهارمی در آسیا

- پایان وضعیت اضطراری در کشور میزبان المپیک ۲۰۲۰

- این سریال در واقع، «آ» + «شغال» است

- خون لاما و شتر، امکان درمان بیماریهای لاعلاج انسانی را فراهم میکند!

- پوششی که دیگر پوشش نیست! شعلهور شدن دوقطبی تازه؟

- دونالد بایدنی! گافهای بیپایان

- از شایعه تا واقعیت عبور از اعتیاد با طب سنتی

- مدت زمان بهینه برای بغل کردن و بوسیدن مشخص شد

- دانشمندان تایید کردهاند که رفاه مالی تضمینکننده شادی نیست

- این فقط به دلیل بیدار ماندن تا دیروقت نیست... رنگ حلقههای تیره زیر چشم، بیماریهای داخلی را آشکار میکنند

- نوشیدنیای که از ۳ مادهی ساده ساخته شده و ایمنی بدن را تقویت کرده و با بیماریهای فصلی مبارزه میکند

- یک ابزار هوش مصنوعی میتواند تشخیص سرطان پوست را در مناطق دورافتاده جهان تسریع کند

- پزشکان توضیح دادند که پس از گازگرفتگی سگ، چند واکسن هاری زده میشود

- کشف عامل اصلی ابتلا به سرطان ریه در مراحل اولیه

- دانشمندان دانشگاه UCL نشانه واضحی از شروع بیماری آلزایمر را شناسایی کردهاند

- هشدار کارشناس روسی درباره خطرات محصولات حیوانی حاوی آنتیبیوتیک

- Cell Heliyon: پازلها تواناییهای شناختی را در سالمندان بهبود میبخشند

- بیماری کلیوی خطر ایست قلبی ناگهانی را هفت برابر افزایش میدهد

- دانشمندان توانستهاند سن شروع بیماری آلزایمر را پیشبینی کنند

- مطالعه: هوش مصنوعی سرعت کار برنامهنویسان را به جای افزایش، کاهش میدهد

- ایمپلنت سینه با اختلالات ایمنی مرتبط است

- مطالعه: بدن چند هفته پس از قطع مصرف داروهای لاغری، دوباره وزن از دست رفته را به دست میآورد

- ایمونولوژی علمی: سلولهای ایمنی برای متوقف کردن سرطان روده بزرگ بسیار مهم هستند

- هزینههای اجتماعی در چین به بالاترین سطح خود در نزدیک به ۲۰ سال گذشته رسید

- SR: کمبود خواب به مدت یک ماه و نیم باعث بیماری قلبی میشود

- گروههای موسیقی تولید شده توسط هوش مصنوعی نگرانیهای صنعت را افزایش میدهند

- افرادی که حساسیت اضطرابی بالاتری دارند، تمایل کمتری به فعالیت بدنی دارند

- Nutrients: رژیمهای کتوژنیک به کاهش دفعات میگرن و خستگی کمک میکنند

- انجمن پزشکی آمریکا: دستگاههای تنفس مصنوعی، بیماران را در معرض عوامل بیماریزای کشنده قرار میدهند

- یک مطالعه جنجالی، اثرات مضر استفاده از تلفن همراه قبل از خواب را زیر سوال میبرد

- یک مطالعه فواید روغن زیتون را در جلوگیری از چاقی و التهاب مغز نشان میدهد

- ویروس «فریبنده» HIV آنطور که قبلاً تصور میشد، غیرفعال نیست

- یک ماده رایج در زندگی روزمره ما با سیروز کبدی و سرطان مرتبط است

- یک واکسن جدید میتواند سرانجام تا سال ۲۰۴۰ مالاریا را ریشهکن کند

- موثرترین رژیم غذایی برای سلامت مثانه

- یک آزمایش مبتنی بر صدا برای تشخیص زودهنگام بیماری پارکینسون در روسیه توسعه داده شد

- ایالات متحده از موفقیتآمیز بودن مرحله اول آزمایش واکسن نانوبینی علیه گونههای آنفولانزای مرغی خبر داد

- متخصصان انکولوژی این ایده را که قاصدک از سرطان محافظت میکند، رد میکنند

- ارتباط نگرانکننده بین کمبود ویتامین D و افزایش خطر افسردگی

- دانشمندان سوئدی روش جدیدی برای مقابله با اضطراب کشف کردهاند

- ترکیبی در رزماری به بهبود زخم کمک میکند

- دانشمندان آمریکایی چهار عامل را یافتهاند که به بیدار شدن آسان و سریع کمک میکنند

- ارز

- طلا

- بورس

- تورم

- اخبار داغ

- ورزشی

- پربیننده

- پربحث

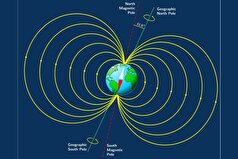

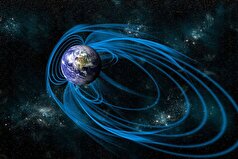

- یک دانشمند درباره روند معکوس شدن قطبهای مغناطیسی زمین در حال حاضر صحبت کرد

- کنایسل نسبت به لابی قدرتمند اوکراینی در کنگره که بر موضع واشنگتن تأثیر میگذارد، هشدار داد

- سیزده نوزاد در ۱۰ ایالت آمریکا مسموم شدند

- رئیس جمهور آلمان نسبت به تهدید دموکراسی در این کشور هشدار داد

- کوتاهترین بازه زمانی برای معکوس شدن قطبهای مغناطیسی زمین شناسایی شد

- او به عنوان یک کشتی گیر ناشنوا تاریخ ساز شد... برایان مک کنا، اسطوره کشتی کج WWE درگذشت

- با دستمزدی نجومی، محمد صلاح مقصد بعدی خود را تعیین میکند

- صدها مهاجر در اقیانوس هند ناپدید شدند

- دانشمندان دریافتهاند که آیا بوسیدن برای افرادی که به عدم تحمل گلوتن مبتلا هستند، بیخطر است یا خیر

- یک مقام آمریکایی با وخیمتر شدن مشکلات فقر در این کشور، نسبت به رکود اقتصادی هشدار داد

- تلگرام ممکن است با غول هوش مصنوعی، Perplexity، همکاری کند

- لاوروف: گفتوگو با واشنگتن ادامه دارد، اما به آرامی

- پسکوف اظهارات پوتین درباره آزمایشهای هستهای را توضیح داد

- دانشمندان خاور دور جایگزینی برای آنتیبیوتیکها در کشاورزی پیدا کردهاند

- ارتش الجزایر نسبت به «توطئههای شوم» علیه امنیت و ثبات کشور هشدار داد

- تعداد نوجوانانی که هوش مصنوعی را به عنوان یک «همراه» میبینند، رو به افزایش است... و کارشناسان نسبت به آن هشدار میدهند

- وزیر کشور روسیه: ما تلاش خواهیم کرد تا تمام اقدامات محدودکننده علیه روسیه در اینترپل لغو شود

- در یک تنش جدید، وزیر دفاع بلژیک روسیه را به دست داشتن در پشت پرده پهپادهای ناشناس متهم کرد

- بلومبرگ: پارلمان آلمان قصد دارد خرید تسلیحات ۳ میلیارد یورویی را تصویب کند

- یک متخصص توضیح داد که چرا باید با نامزدتان حلقه نامزدی انتخاب کنید

- دانشمندان واقعیت مجازی را برای افراد دارای معلولیت قابل دسترس کردهاند

- روزنامه آلمانی: اختلاف نظر در این کشور در مورد روسیه

- در باره سه سنگ غیرمعمول در جواهرات

- دانشمندان اسرار مرموزترین نوع سیاره فراخورشیدی را کشف کردند

- واشنگتن قصد دارد انبارهای تجاری غولپیکری را برای بازداشت مهاجران خریداری کند

- یک روانشناس توضیح داد که چرا مردان در مورد نارضایتی خود در روابط سکوت میکنند

- دانشمندان کشف کردهاند که برخی جلبکها از رنگ برای دفع دشمنان استفاده میکنند

- ووچیچ قصد دارد درخواست تعلیق تحریمهای آمریکا علیه شرکت نفت صربستان "NIS" را مطرح کند

- خانه دوران کودکی ترامپ در نیویورک به قیمت ۲.۳ میلیون دلار به حراج گذاشته شد

- یک روانشناس مولفههای شادی مردان را که درباره آنها صحبت نمیشود، شناسایی کرده است

- محصولی شناسایی شد که خطر ابتلا به هشت نوع سرطان را افزایش میدهد

- ترامپ از سازش در بحران تعطیلی دولت خودداری میکند

- فنلاند از ناتو خواست تا به دلیل تهدید جنگ هستهای، ارسال سلاح به اوکراین را متوقف کند

- گزارش تکان دهنده در مورد سرنوشت مورد انتظار شاهزاده سابق بریتانیا اندرو و همسر سابقش سارا فرگوسن

- تعطیلی دولت آمریکا، هزاران کارمند شاغل در پایگاههای نظامی خارج از کشور را از دریافت حقوق محروم کرده است

- دبیرکل سابق ناتو بزرگترین شکست این ائتلاف را اعلام کرد

- دانشمندان یک روده مجازی ساختهاند تا اسرار میکروبها را آشکار کنند

- زلنسکی: ما در حال مذاکره با آمریکا برای عرضه سامانههای پاتریوت بیشتر هستیم

- تعطیلی دولت: ترامپ کمکهای انرژی به فقرا را لغو کرد و هشدارهایی مبنی بر مرگ و میر ناشی از دمای پایین هوا منتشر شد

- فنلاند میگوید روته حرفهایش را نقض میکند

- پروانهای ۲.۶ میلیون ساله در ژاپن کشف شد

- تعطیلی دولت، اقتصادِ از قبل درگیرِ بحرانِ واشنگتن را بیش از پیش تحت فشار قرار داده و هزاران خانواده در آستانهی فروپاشی مالی قرار گرفتهاند

- «ما آن را در سال ۲۰۲۶ به جهانیان اعلام خواهیم کرد»| مصر در حال آمادهسازی یک شگفتی باستانشناسی است که تاریخ را از نو خواهد نوشت

- بریتانیاییها استارمر را به یک چاپلوس ترامپ «تبدیل» کردند و او را سوزاندند

- مشخص شده است که سنقرها توانایی شنوایی "شبیه جغد" دارند

- ترامپ به دنبال نامگذاری یک استادیوم فوتبال جدید در واشنگتن به نام خودش است

- نخست وزیر آلبانی از اتحادیه اروپا خواست تا با روسیه وارد گفتوگو شود

- تعداد پروازهای لغو شده و تاخیردار در آمریکا از مرز ۵۰۰۰ پرواز گذشت

- ترامپ پیشنهاد میدهد بودجههای درمانی دولت مستقیماً به شهروندان اختصاص داده شود

- در آلمان، تقریباً از هر چهار کودک زیر سن قانونی، یک نفر با کمکهای دولتی زندگی میکند

- بایدن با انتقاد شدید از ترامپ و اطرافیانش گفت: «در دموکراسی پادشاه وجود ندارد.»

- ناتو در مورد پتانسیل هستهای این اتحاد اظهار نظر کرده است

- دانشمندان کشف کردهاند که چگونه آکنه میتواند سلامت روان را مختل کند

- مسکو: اظهارات ترامپ درباره آزمایش سلاحهای هستهای بسیار خطرناک است

- آلمان: افزایش قابل توجه رد درخواستهای پناهندگی سوریها

- رسانهها: کمیسیون اروپا نتوانست بلژیک را برای استفاده از داراییهای روسیه متقاعد کند

- مراکش ارتباطات ۵G را راهاندازی کرد

- این کشور اسکاندیناویایی میخواهد وامی ۱۰۰ میلیارد یورویی در اختیار اوکراین قرار دهد

- دانشمندان کشف کردهاند که یک قاره جدید در حال تولد روی زمین است

- محمد صلاح در بازی مقابل منچسترسیتی به دنبال ثبت رکورد جدیدی است

- ستاره بارسلونا در رادار غول اروپایی

- آمریکا و چین توافق کردند که عرضه تراشه را از سر بگیرند

- راننده آنجلینا جولی جزئیات دستگیری خود در اوکراین را توضیح میدهد: «به نظر میرسد که آنها مرا فریب دادند»

- یک بنیاد قطری دورههای آموزشی پیش از ازدواج را برای کاهش نرخ بالای طلاق برگزار میکند

- اوربان: مجارستان و ایالات متحده در آستانه یک «عصر طلایی» در روابط دوجانبه هستند

- یک مقام ناتو: آلمان میتواند به «نقطه شروع مرکزی» برای این ائتلاف در هرگونه درگیری با روسیه تبدیل شود

- اوربان به شوخی از ترامپ میخواهد که اجازه دهد سخنگوی کاخ سفید را برای کار در مجارستان «قرض» بگیرد

- رویترز: ایالات متحده از ایده استفاده از داراییهای مسدود شده روسیه حمایت میکند

- رئیس پنتاگون گفت که ایالات متحده در صورت لزوم وارد جنگ خواهد شد و در آن پیروز خواهد شد

- دانشمندان برای اولین بار ژنوم سائولا، «یونیکورن آسیایی»، را رمزگشایی کردند

- ترامپ تعداد مهاجران بازداشت شده را به بالاترین حد رساند

- دانشمندان عواقب انقراض تمام حیات در اقیانوس را کشف کردهاند

- کمیسیون اروپا محدودیتهایی را برای ویزای شینگن برای روسها اعمال میکند

- پرونده برادر نخست وزیر اسپانیا در فوریه ۲۰۲۶ رسیدگی خواهد شد

- یک جایگزین مؤثر برای ماسکهای صورت پارچهای جوانکننده ایجاد شده است

- دزدان دریایی بار دیگر در سواحل سومالی دست به حمله زدند

- در آمریکا، فاجعهای با حضور جیمز مکآووی سر صحنه فیلمبرداری یک فیلم ترسناک رخ داد

- دانشمندان شباهتهای شگفتانگیزی بین زمین و مریخ یافتهاند

- زاخارووا: مقاله فایننشال تایمز در مورد دیدار لاوروف-روبیو مستقیماً از یک داستان آگاتا کریستی بیرون آمده است

- رسوایی بزرگی فوتبال ترکیه را تکان داد: حکم بازداشت داوران و مسئولان به دلیل شرطبندی صادر شد

- مدیر ورزشی بایرن در مورد کمپانی: من از صمیم قلب معتقدم که او مربی ایدهآلی است

- بوکایو ساکا، توافق قریب الوقوع

- یک جایگزین در لیگ ۱ برای خط حمله بارسلونا

- بارسلونا ۷ میلیون یورو ضرر کرد

- موندو دپورتیوو: بارسلونا در مراکش یک بازی دوستانه برگزار خواهد کرد

- برناردو سیلوا در طول دوران حرفهای خود ۱۰۰ بازی در لیگ قهرمانان اروپا انجام داده است

- وانولی در مورد فلورانس: شهری با مطالبات بالا

- تغییر کامل برنامه با خاوی گوئرا در والنسیا

- منچستریونایتد مجبور به تقویت خط حمله خود شد

- روبن آموریم به بازیکنان باتجربه ایمان کامل دارد

- مدیر ورزشی بایرن مونیخ در مورد تمدید قرارداد اوپامکانو صحبت کرده است

- لیورپول و چلسی میتوانند برای جذب مدافع لیگ برتر رقابت کنند

- اظهارات سرمربی تیم ملی اسپانیا در پاسخ به سوالی در مورد تصمیم برای دعوت از یامال با وجود مصدومیتش

- پابلو فورنالس به میدان میآید

- نشاط رایان چرکی، منچسترسیتی را سرحال میکند

- از میان این همه ستاره، ویارئال جرارد مورنو را انتخاب میکند

- رومانو فاش کرد که آیا لواندوفسکی ۳۷ ساله ممکن است در زمستان بارسلونا را ترک کند یا خیر

- مسی فاش کرد که پس از بازنشستگی از فوتبال، میخواهد در چه زمینهای پیشرفت کند

- ریاض محرز از مشکلاتش در لیگ عربستان میگوید

- مارکا: فینال بین اسپانیا و آرژانتین در تاریخ ۲۷ مارس ۲۰۲۶ برگزار خواهد شد

- مدیر ورزشی بایرن در مورد موسیالا: تمام تیم مشتاقانه منتظر اوست

- تاتنهام میتواند به رقابت برای جذب مهاجم رئال مادرید بپیوندد

- مسی درباره میراثش در فوتبال صحبت کرد

- لوانته قرارداد مدافع کناری خود را قطعی کرد

- تغییر جدیدی در صحنه برای دانیل پرتز؟

- تسریع در امضای قرارداد با جیوایرو رید

- پدر فلوریان ویرتز درباره اولین بازیهای پسرش برای لیورپول صحبت کرده است

- فابریزیو رومانو اعلام کرد که اندریک، مهاجم رئال مادرید، به کجا خواهد رفت

- پلگرینی پیشنهاد داد که قانون جدیدی در فوتبال وضع شود

- جولیان آلوارز آینده خود را تا پایان فصل به تعویق انداخت

- ژابی آلونسو: رودریگو میتواند در سمت راست بازی کند

- آلوارو موراتا از تیم ملی اسپانیا به فراموشی سپرده شد

- نگاهی به ویرتز: فلوریان برای تطبیق با همتیمیهایش به زمان نیاز دارد

- فابریزیو رومانو در مورد شایعات مربوط به علاقه رئال مادرید به ویرجیل فن دایک اظهار نظر کرده است

- هالند: باید روی کمک به تیم برای کسب سه امتیاز تمرکز کنم

- شروع وحشتناک تیرنو بری در انگلیس

- جواهری که نیکو پاز در کومو آن را تحت الشعاع قرار میدهد

- سیارتو: معافیت مجارستان از تحریمهای آمریکا علیه واردات انرژی از روسیه دائمی است و محدود به یک دوره زمانی خاص نیست

- نقشههای الکسیس مک آلیستر فاش شد

- جوزپ گواردیولا پس از بازنشستگی از مربیگری، لیست آرزوهایش را فاش کرد

- «نه خیلی فوتبالی، اما پر از احساسات.» این جمله کازانسکی، مفسر بازی تاتنهام و منچستریونایتد است

- فرانک، سرمربی تاتنهام، در مورد بازی مقابل منچستریونایتد گفت: «دردناک است، اما ما نباختیم.»

- ناپولی به دنبال جذب یک مدافع راست است

- جایگزین غافلگیرکننده برای خط میانی اتلتیکو مادرید

- دوئل بلند پرواز برای ارلینگ هالند

- «مسابقهای به نام دروازهبانها!» گزارش الکساندر الاگین درباره بازی ساندرلند و آرسنال

- آرسنال برای اولین بار در نه بازی اخیر، مقابل ساندرلند گل خورد

- آموریم، سرمربی منچستریونایتد: لامنز خیلی خوب کار میکند، او مثل یک مرد واقعی بازی میکند

- لالیگا | آنتوان گریزمان در اتلتیکو مادرید جاودانه است

- آدمولا لوکمن، یک بازیکن تقویتی برای زمستان؟

- تصمیمی سنگین برای خاوی گوئرای محبوب

- ساندرلند به روند ۱۰ برد متوالی آرسنال در تمام رقابتهای لیگ برتر پایان داد

- دی لیخت، مدافع منچستریونایتد، میگوید در بازی مقابل تاتنهام لیاقت بیشتری داشتیم

- فرانکولینو جو، گلزن شگفتانگیزی که اروپا را شگفتزده میکند

- وضعیت اضطراری کامل برای ناپولی در خط میانی

- آنها ۱۵ میلیون برای روبن وارگاس روی میز گذاشتهاند

- مذاکرات بین رئال مادرید و وینیسیوس به بنبست رسیده است| اسپانیاییها آمادهاند تا او را با مبلغ ۱۵۰ میلیون یورو بفروشند

- رئیس باشگاه بارسلونا درباره نگرشش نسبت به سرمربی فلیک و عملکردش صحبت کرد

- «یک رویارویی مصری»| عمر مرموش درباره مسابقه پیش بینی شده مقابل صلاح اظهار نظر میکند

- اسلات، سرمربی لیورپول، پس از یک تابستان رکوردشکن، درباره سیاست نقل و انتقالات باشگاه اظهار نظر کرد

- هانسی فلیک: «ما باید اینجا و در تیم ملی مراقب لامین باشیم»

- تغییر در آینده مارک برنال

- آنتونی در بتیس از جدول خارج شده است

- لیونل مسی میتواند به گالاتاسرای بپیوندد

- مارسکا به رونی که از سرمربی به خاطر چرخش بیش از حد سیستم بازی در بازی مقابل قره باغ انتقاد کرده بود، پاسخ داد

- گواردیولا: در فوتبال، همه چیز با سر الکس فرگوسن شروع میشود و بعد ما میرویم

- اسپانیایی جدیدی که پس از دین هایسن، بورنموث را متحول میکند

- روبن آموریم دو نوسازی را در اولویت قرار میدهد

- ولورهمپتون دیگر گزینهای روی نیمکت ندارد

- منچستریونایتد در پنج بازی اخیر لیگ برتر شکستناپذیر بوده است، روندی که از فوریه ۲۰۲۴ تاکنون سابقه نداشته است

- فلیک، سرمربی بارسلونا، در مورد بازی مقابل سلتا گفت: «همه چیز به نگرش ما بستگی دارد.»

- مارسی با شکست برست به صدر جدول لیگ ۱ فرانسه صعود کرد

- قرارداد جان استونز امضا شد

- مائوریتزیو ساری، تعیین کننده در لاتزیو

- سری آ | یوونتوس تورین در دربی دلا موله گیر افتاد

- آموریم، سرمربی منچستریونایتد، درباره بازی مقابل تاتنهام گفت: «ما باید امروز برنده میشدیم.»

- محرز گل پیروزی را به ثمر رساند| الاتحاد در هفته هشتم لیگ برتر عربستان، شکست دردناکی را مقابل الاهلی متحمل شد

- «روح گلادیاتور»| بارسلونا اریک گارسیا را که دچار شکستگی بینی شده بود، در حالی که ماسک محافظ به صورت داشت، نشان داد

- اتلتیکو | دیگو سیمئونه: "ما یک بازی بسیار کامل انجام دادیم"

- ویارئال به دنبال یک مهاجم ۲۰ میلیون یورویی است