- ارتباط با ما

- |

- درباره ما

- |

- نظرسنجی

- |

- اشتراک خبری

- |

- نگارنامه

وقتی هوش مصنوعی قاضی میشود!

به گزارش مجله خبری نگار، به طور معمول افراد تصمیم گیرنده براساس پیش بینیهایی که نتایجی نامشخص دارند، به طور متوالی گزینههایی را انتخاب میکنند. این روند به خصوص درباره قضات دادگاهها صحت دارد که درباره آنکه برای متهم قرار وثیقه صادر کنند یا خیر یا آنکه چگونه مجازات متهمان را تعیین کنند، تصمیم میگیرند.

اکنون شرکتها به طور روزافزونی از مدلهای یادگیری ماشینی در تصمیم گیریهایی با ریسک بالا استفاده میکنند. این سیستمها فرضیات مختلفی درباره رفتارهای انسانی مبنای خود قرار میدهند. همین روند در توصیههای محصول در آمازون، فیلتر کردن هرزنامههای ایمیل شده و متنهای پیش بینی کننده روی موبایل نیز نقش دارد.

در همین راستا محققان یک تست از چنین فرضیه رفتاری را توسعه دادند تا مشخص شود آیا تصمیم گیرندگان به طور سیستماتیک پیش بینیهای اشتباه انجام میدهند یا خیر. همچنین آنها روشهایی برای تخمین تبعیض آمیز بودن پیش بینی هایشان نیز توسعه دادند.

تحقیق مذکور با تحلیل سیستم پیش از محاکمه شهر نیویورک نشان داد تعداد زیادی از قضات با توجه به ویژگیهای متهم مانند نژاد، سن و رفتارهای پیشین، پیش بینیهای سیستماتیک اشتباهی درباره خطر سوء رفتار قبل محاکمه افراد انجام میدهد. پژوهشگران این موضوع را بررسی کردند که آیا تصمیم قضات برای آزاد کردن افراد نشان دهنده اعتقاد صحیح آنها درباره خطر عدم حضور متهم در دادگاه است یا خیر. پژوهش براساس اطلاعات بیش از یک میلیون پرونده در شهر نیویورک انجام شد که ۷۵۸۰۲۷ مورد آن مشمول آزادی پیش از محاکمه بودند.

تحلیلها حاکی از آن است که حداقل ۲۰ درصد قضات شهر نیویورک درباره پیش بینی خطر سورفتار متهم با توجه به ویژگیهای او اشتباه میکنند. محققان با تکیه بر این تحلیل تاثیر جایگزینی قضات با الگوریتمهای تصمیم گیری را تخمین زدند.

هرچند این تحقیق اشاره میکند جایگزین کردن الگوریتمهای هوش مصنوعی با قضات تاثیرات مبهمی دارد، اما به نظر میرسد به بهبود ۲۰ درصدی نتایج دادگاه منجر میشود.

- لطفا از نوشتن با حروف لاتین (فینگلیش) خودداری نمایید.

- از ارسال دیدگاه های نا مرتبط با متن خبر، تکرار نظر دیگران، توهین به سایر کاربران و ارسال متن های طولانی خودداری نمایید.

- لطفا نظرات بدون بی احترامی، افترا و توهین به مسئولان، اقلیت ها، قومیت ها و ... باشد و به طور کلی مغایرتی با اصول اخلاقی و قوانین کشور نداشته باشد.

- در غیر این صورت، «نگارمگ » مطلب مورد نظر را رد یا بنا به تشخیص خود با ممیزی منتشر خواهد کرد.

- آخرین اخبار

- محبوب

- برچسب های داغ

- پیشبینی یک متخصص تغذیه: گیاهخواری تا ۲۰ سال دیگر بر روی زمین غالب خواهد شد

- چرا گاهی اوقات صبحها احساس خستگی میکنیم؟

- یک محصول لاغری محبوب افراد مشهور باعث اسهال مادام العمر میشود

- چگونه ساعات کوتاه روز به سلامت شما آسیب میرساند: راههای طبیعی برای حفظ انرژی و خلق و خوی شما

- کارشناسان یک خاصیت مفید و منحصربهفرد از سس کچاپ را شناسایی کردهاند

- یک شبکه عصبی، طرحهای مخفی برای فروش افراد به عنوان برده جنسی را کشف کرده است

- کاپیتان سابق تیم ملی اروگوئه توضیح داد که چرا لوئیس سوارز فوتبالیستها را در زمین گاز میگیرد

- ترانسفرمارکت: یامال گرانترین بازیکن لالیگا است، بلینگهام و امباپه به طور مشترک در جایگاه دوم قرار دارند

- کشف یک اثر غیرمنتظره کشیدن دندان عقل

- دروازهبان لیل در مورد مهار سه پنالتی متوالی در لیگ اروپا: اگر پنالتی چهارم را میگرفتند، پنالتی چهارم را هم مهار میکردم

- ماسک، نخست وزیر بریتانیا را «بازیگری تهی مغز» خواند

- هوش کلاغها و زاغیها دانشمندان را شوکه کرد

- چرا زمان با افزایش سن سریعتر میگذرد: دانشمندان پاسخ غیرمنتظرهای یافتهاند

- دانشمندان دو عادت را شناسایی کردهاند که به شما کمک میکند لاغر بمانید

- ارلینگ هالند گفت که از مرگ میترسد

- هشدار مهم: دارویی که برای درمان طاسی استفاده میشود، ممکن است منجر به افسردگی و خودکشی شود

- فایزر با یک طوفان حقوقی بیسابقه روبروست!

- جزئیات تکاندهندهای از زندگی دستیار شخصی یک سرمایهدار مشهور آمریکایی که متهم به «شکنجه» زنان در یک «زیرزمین جنسی» است

- دانشمندان راز پیدایش دندان و دندان درد را کشف کردند

- ۵ قانون غیرمعمول برای محافظت از قلب در برابر حملات

- نانوحبابها به بخش نفت، گاز و پتروشیمی ورود پیدا میکنند!

- کشف سیارهای سرگردان با اشتهایی سیریناپذیر!

- بررسی ویژگیهای پاککن آنتیباکتریال!

- کهیر ناشی از چه عواملی است؟

- چگونه پاستیل مناسب کودکان را پیدا کنیم؟

- رضایت شغلی چه فاکتورهایی شامل میشود؟

- اضافه کردن لیمو به چای سبز چه خواصی به همراه دارد؟

- برای تقویت مفاصل حتما این گروههای غذایی را مصرف کنید!

- تغییر شغل عوارض جسمی دارد؟

- چگونه از آسیبهای چشمی ناشی از بیماری دیابت پیشگیری کنیم؟

- ارتقای مراقبت از سالمندان با رعایت این نکات!

- این بیماریها ربطی به روند سالمندی ندارد!

- استراحت کنید تا مغزتان سالم بماند!

- شایعترین عامل بیماریهای مزمن ریوی را بشناسید!

- پیشگیری از زخم بستر مستلزم چه مراقبتهایی است؟

- مصرف عسل در دوران بارداری جنین چه تاثیری بر جنین دارد؟

- روشهای مراقبت از گوش کودکان را بیاموزید!

- این عوامل برای بیماران قلبی مثل سم عمل میکند!

- مهمترین علائم هشداردهنده سرطان سینه را بشناسید!

- شیرینی باعث وزن گیری جنین میشود؟

- چگونه از ابتلا به سرطان پستان پیشگیری کنیم؟

- با آزمون ضربان قلب از سلامت قلب خود باخبر شوید!

- با سبک زندگی مناسب آلزایمر به تاخیر میافتد!

- کنترل قند خون با تمر هندی ممکن است!

- برای محافظت از نوزادان در برابر سیاه سرفه بهترین راه چیست؟

- زمان نوشیدن قهوه مهم است؟

- یک ربات جدید که قابلیت خانه سازی در عرض یک روز را دارد!

- بیشترین تعداد کروموزوم در بین تمام حیوانات برای این پروانه است!

- اگر گوشی شما دیر شارژ میشود، بخوانید!

- فشار روحی چه تاثیری بر کنترل وزن دارد؟

- پلیاستیشن ۴ بازنشسته میشود!

- عرق سرد با این نشانهها همراه است!

- معرفی علائم و نشانههای کمخونی!

- بهبود سلامت دهان و دندان با این رژیم ساده!

- دستگاههای رباتیک میتوانند تا مقیاس میکروسکوپی کوچک شوند!

- جزئیاتی جالب در مورد ماهیت خاک!

- یک واکسن به درمانی جدید برای آلرژی تبدیل میشود!

- برای این سرطانها حتما غربالگری داشته باشید!

- هوازی ناشتا برای تناسب اندام تاثیر دارد؟

- باکتریهای بیماریزا چگونه توانایی هضم اتانولآمین را پیدا میکنند؟

- بلایی که هکرها بر سر گوگل آوردند!

- مبارزه با سرطان به کمک این گیاهان!

- توسعه فناوری امروزه با الهام از این ویژگیهای خاص حیوانات!

- DNA حامل ژن ویژگی طول عمر نیست!

- بازیهای ویدیویی سپر جدید در برابر آلزایمر!

- ساعت هوشمند هواوی با قابلیتهای بی نظیر ارائه داده میشود!

- هوش مصنوعی میتواند باعث روانپریشی شود؟

- سلولهای بنیادی ناتوانی در حرکت را درمان کردند!

- ذهنخوانی ممکن شد!

- چرا نباید زیاد از بطریهای پلاستیکی استفاده کرد؟

- ضد آفتاب طبیعی در دوران باستان!

- اسپیسکوین رقیبی جدی برای اینترنت ماهوارهای استارلینک!

- در فصل پاییز تغذیه باید چگونه باشد؟

- این اصول برای شروع پاییز برای شما ضروری است!

- آموزش رجیستر کردن گوشی تلفن همراه!

- رقابت مستقیم اپل و متا با توسعه عینکهای هوشمند!

- بهترین رژیم غذایی برای سلامتی کدام است؟

- قهوهخورها به دو گروه اصلی تقسیم میشوند!

- خوردن گوشت قرمز یک مشکل بالقوه کشنده ایجاد میکند!

- درد مفاصل در نتیجه کمبود چه ویتامینهایی رخ میدهد؟

- رایت: اگر کین از بایرن به تاتنهام برگردد، رکورد گلزنی شیرر در لیگ برتر را خواهد شکست

- رپر معروف، دیدی، به ۵۰ ماه زندان محکوم شد

- تام هالند برای اولین بار نامزدی خود با زندایا را تایید کرد

- نیکول کیدمن و کیث اربن جدایی خود را اعلام کردند

- حبیب پدرش را با سر الکس فرگوسن افسانهای مقایسه کرد

- مادر حدید، مدل معروف، مزرعه خانوادگیشان در پنسیلوانیا را برای فروش گذاشته است

- پسر بکهام در مورد شایعات اختلاف با والدینش: «مردم حرفهای منفی میزنند»

- ترور از GTA عشق خود را به ادبیات و داستایوفسکی اعتراف کرد

- بیول، قهرمان بوکس جهان، بدون اشاره به رونالدو، فوتبالیست ایدهآل را ترسیم کر

- هالند نروژی وقتی از او در مورد تکامل لهجهاش سوال شد، خود را بریتانیایی نامید

- جاستین بیبر اولین قدمهای پسرش را در حال پیادهروی نشان داد

- سوفیا ورگارا به دلیل بستری شدن در بیمارستان، مراسم امی را از دست داد

- شیلین وودلی پس از شش ماه رابطه عاشقانه از نامزدش جدا شد

- نیکی نیکول پس از متهم شدن به خیانت به لامین یامال، جزئیات رابطهاش با این بازیکن را فاش کرد

- بعد از مُهر رونالدو، این شماره ارزش واقعی پیدا کرد... اولین نظر از صاحب شماره «فراموش شده»!

- مشکلات زناشویی شاهزاده هری و مگان مارکل فاش شد: «به او در مورد ناتوانی جنسی هشدار داده شده بود»

- تیلور سویفت دوست داماد را به عروسی دعوت نکرد

- گواردیولا درباره برخورد ناخوشایندش با این بازیگر افسانهای در مترو صحبت کرد و گفت: «خیلی خجالت کشیدم.»

- اولین اظهار نظر دختر هالک هوگان پس از کنار گذاشته شدن از وصیتنامه پدرش

- رونی اوسالیوان، اسطوره اسنوکر، بهترین فوتبالیست، تنیسور و بوکسور تاریخ را معرفی کرد

- تیری آنری در مورد رقیب سابقش گفت: «از کاری که میتوانست بکند میترسیدم، میتوانست تو را دفن کند.»

- هافبک سمپدوریا دختری را که بیش از ۱۰ ضربه چاقو خورده بود، نجات داد

- بازیکن النصر فاش کرد که کریستیانو رونالدو چه کلماتی را به زبان عربی میداند

- «ملکه کتامین» به جرم تهیه دارویی که منجر به مرگ یکی از مشهورترین کمدینهای جهان شد، اعتراف کرد

- عکس| جورجینا پس از اعلام نامزدیاش، با حضور ویژه در کنار کریستیانو رونالدو، فالوورهایش را شگفتزده کرد

- ستاره جیمز باند برای اولین بار درباره طلاقش صحبت کرد

- وودی آلن میگوید سینماهای آنلاین را دوست ندارد

- وودی آلن، جادوگر سینمای آمریکا، داستان اشتیاق خود به هنر هفتم و باله در روسیه را روایت میکند

- جان سینا عکس مسی را منتشر کرد| این کشتیگیر ۱۰ حضور در مسابقات WWE در کارنامهاش دارد

- وین رونی: ماموران امنیتی وقتی به لبران نزدیک شدم، من را با یک هوادار اشتباه گرفتند

- خواننده ژاپنی به خاطر درخواست از مترجم برای بردنش به دستشویی محکوم شد

- بازیگر زن مشهور به دلیل افسردگی مجبور به جن گیری شد

- روما زور راز خوشبختی خانواده را فاش میکند

- سیابیتووا گفت چه نوع زنانی را نباید به همسری گرفت: "سقراط هشدار داد"

- کیتی پری در کنسرت دچار برق گرفتگی شد

- لیل پامپ، رپر آمریکایی، تصادف کرد و به خدا ایمان آورد

- زویی کراویتز به خاطر مار، حمام تیلور سویفت را بهم ریخت

- پسر بکهام در دومین عروسیاش به والدینش توهین کرد

- عکس: زلاتان ابراهیموویچ به حمزات چیمایف به خاطر کسب عنوان قهرمانی در UFC ۳۱۹ تبریک گفت

- «باید دربارهاش از او بپرسی»| نظرات خندهداری که پس از اعلام نامزدی کریستیانو رونالدو و جورجینا رودریگز به آنها داده شد

- اما استون توضیح میدهد که کدام دوره از زندگیاش را خاص میداند

- الکس فرگوسن افسانهای پاسخ داد که اگر مسی در دهه ۱۹۵۰ بازی میکرد، چه اتفاقی برایش میافتاد

- پس از کریستیانو رونالدو، لواندوفسکی حمله به توپ طلا را آغاز کرد

- «او ما را خنداند»| خداحافظی محمد صلاح با ستاره جدید الهلال + عکس

- بازیکن منچسترسیتی: تشویق لیورپول نوعی ریاکاری است

- میکو رانتانن ستاره دالاس با آرسن ونگر عکس میگیرد

- قهرمان فوتبال هلند به جرم قاچاق مواد مخدر به هفت سال زندان محکوم شد

- ممکن است دختر آنا وینتور، بازیگر مشهور، جای او را در مجله ووگ بگیرد

- هنرمند مصری به اتهام قتل شوهرش و فروش اعضای بدن او محاکمه میشود؟

- همسر هافبک اسپارتاک از تلاش برای سرقت در پاریس در نزدیکی برج ایفل خبر داد

- همسر سابق بازیکن اسپارتاک در شبکههای اجتماعی از او انتقاد کرد: «او ما را در خیابان رها کرد»

- عکس| دخیا پیش از بازی فیورنتینا و منچستریونایتد با الکس فرگوسن دیدار کرد

- رونالدوی ۴۰ ساله آمادگی جسمانی فعلی خود را نشان میدهد

- کایلی جنر نشان داد که در کودکی چه شکلی بوده است

- تیم رپر دیدی در مورد عفو این نوازنده با دولت ریاست جمهوری ایالات متحده گفتوگو کرد

- سون هیونگ مین ۵ فوتبالیست مورد علاقهاش را معرفی کرد| ۴ برنده توپ طلا معرفی شدند

- شاهزاده هری درباره دعوایی که در آن «بینی شاهزاده اندرو را شکست» صحبت میکند

- جونگمن، ستاره سریال «من و پادشاه»، به جرم تجاوز و خفگی به زندان افتاد

- "من میتوانم با هزینه او زندگی کنم": عروس جوان لپس بعد از عروسی نقشه میکشد

- بلا حدید و هیلی بیبر قسم میخورند که: حقیقت در مورد مکمل "جادویی" که زیبایی و سلامت را افزایش میدهد چیست؟

- حمایت بانکها از بازار سرمایه از فردا اجرا میشود

- بورس سقوط کرده در دولت روحانی چگونه در دولت شهید رئیسی احیا شد؟

- درمان بورسی پزشکیان از زبان عبده

- جذب سرمایه ۷ همتی از بازار بورس دانشبنیانها

- وعده عناب بورسی واقعیتر شد

- چهارمین روز نزولی بازار در غیاب نیروهای صعودی

- انتخابات و دامنه نوسان مهمترین دلیل رکود فعلی بورس

- بورس با ۴ مصوبه دولت برای حمایت از بازار سهام سبزپوش میشود؟

- ۳ دلیل پایین بودن ارزش معاملات خرد در بورس

- معافیتهای مالیاتی بازار سرمایه باید استمرار پیدا کند

- بورس این روزها تحت تأثیر تداوم نرخ اخزای بالای ۳۵ درصد

- رشد شاخصهای بورس با کف سازی تکنیکال

- کاهش دامنه نوسان هم علاج بورس نزولی نبود

- سایه تامین مالی دولت بر سر بورس سنگینی میکند

- کاهش بی سابقه حجم معاملات سهام در بورسهای جهانی

- رشد شاخصهای بورس با کمک بانکیها و اعلام نرخ تسعیر ارز

- حمله به سفیر روسیه در لهستان

- معرفی سری گوشیهای Redmi K ۵۰ قبل از رونمایی رسمی

- غفوری: فکر کردن به قهرمانی از الان، سادهلوحانه است

- کاهش ۱۰ درصدی تولید هوندا در دو کارخانه

- سومین نشست دستمزد، باز هم بدون نتیجه

- لغو بلیت فروشی عمومی المپیک زمستانی چین

- گرامیداشت قربانیان هواپیمای اوکراینی در دانشگاه تورنتو

- ادامه چانهزنی چهارگانه در وین

- صرفهجویی ۱.۶ میلیارد دلاری کمیته برگزاری المپیک و پارالمپیک توکیو

- محبوبترین رشته المپیک توکیو مشخص شد

- اعلام هزینه میزبانی توکیو از المپیک و پارالمپیک ۲۰۲۰،

- آذرتاج: هیات اقتصادی جمهوری آذربایجان به ایران میرود

- بررسی عملکرد ایران در المپیک؛ جایگاه چهارمی در آسیا

- پایان وضعیت اضطراری در کشور میزبان المپیک ۲۰۲۰

- اسرارآمیز و فانتزی و در باورهای کهن

- یک قلب آرژانتینی برای برای کشف خویشتن

- همه چیز درباره آلزایمر، از جمله غیرقابل تصورها!

- وحید یا محرم؟ کدام در جاده موفقیت

- مبارزه طاقتفرسای عقاب و اژدها بر سر تیکتاک

- تمام زندگی ما زیر سایه اقساط

- چرا اضطراب اجتماعی دامنگیر نوجوانان و جوانان شده است؟

- ماجرای مشتی لایک و واچ تایم در رسانه ملی

- سیاه و سفید رُکگویی آقای بازیگر و آقای استاد سیاسی

- متخصص آسیبشناسی: سیگارهای الکترونیکی یا ویپ از سیگار کشیدن خطرناکترند

- «دانههای گوش» که به عنوان راه حلی برای استرس و خستگی تبلیغ میشوند، چیستند؟

- سختیهای اولیه منجر به رشد سریع مغز با خطرات بلندمدت میشود

- صبح خود را با آب گرم شروع کنید... فواید فراوان برای سلامتی و زیبایی

- یک متخصص مغز و اعصاب توضیح داد که چگونه میتوان فراموشی معمولی را از زوال عقل تشخیص داد

- کشف راز «مه مغزی» در بیماران کووید-۱۹ طولانیمدت

- خستگی مزمن ممکن است ناشی از کمبود ویتامین D باشد

- شاخصهای سلامتی در طول خواب که نیاز به احتیاط دارند

- متخصص غدد درون ریز: مصرف بیش از حد چربیهای گیاهی برای سلامتی مضر است

- دیلی میل: بوی بد دهان نشان دهنده چه بیماریهای جدی است؟

- یک پزشک خطرات خوردن شام دیرهنگام را توضیح میدهد

- یک انتخاب غذایی ایمن و مؤثر برای سلامت قلب و روده بزرگ

- علائم بیماری شدید قلبی که خطرناکتر از تنگی نفس هستند، شناسایی شدهاند

- الگوهای خواب، پیری مغز را تسریع میکنند!

- دانشمندان: نوجوانانی که نوشیدنیهای انرژیزا مصرف میکنند، بیشتر در معرض ابتلا به افسردگی هستند

- دانشمندان روسی نشانگرهای زیستی جدیدی را برای اسکیزوفرنی و افسردگی کشف کردند

- ترکیبات خطرناکی که باعث سرطان میشوند در نمک طعام یافت شدهاند

- روزنامه سان: اعتیاد به ماراتن و قرصهای مخدر، راههای خطرناکی برای بهبود سلامت شما هستند

- علائم ساده در پاها ممکن است یک بیماری جدی و تهدیدکننده زندگی را نشان دهد

- رژیمهای غذایی سرشار از پروتئین گیاهی ممکن است به زنان کمک کند تا با افزایش سن، سالم بمانند

- تاثیر نوشابه بر سلامت روان

- مجله پزشکی کودکان JAMA: آبمیوهها از کوکاکولا رژیمی مضرترند

- مطالعهای تأثیر بیماریها و سبک زندگی را بر پیری مغز نشان میدهد

- تاثیر مخرب سیگارهای الکترونیکی بر سلامت دهان و دندان

- دانشمندان روسی روشی منحصربهفرد برای درمان چاقی ابداع کردهاند

- میکروپلاستیکها سلامت استخوانها را تهدید میکنند و بازسازی استخوان را مختل میکنند!

- دانشمندان نقش انواع ژنتیکی ارثی را در ایجاد یک سرطان خون نادر شناسایی کردهاند

- مطالعهای فواید مسواک زدن دندانها را در پیشگیری از سرطان آشکار کرد

- یک متخصص پرتودرمانی توضیح داد که چه کسانی برای سیتیاسکن منع مصرف دارند

- انقلابی در درمان آسم در کودکان: یک دستگاه استنشاقی دوکاره نتایج شگفتانگیزی ارائه میدهد

- روشهایی برای حفظ جوانی مغز در سنین پیری شناسایی شد

- اخبار داغ

- ورزشی

- پربیننده

- پربحث

- زلنسکی ممکن است تأمینکننده تسلیحات استراتژیک خود را از دست بدهد

- یک داروی جدید میتواند در صورت عدم موفقیت داروهای مرسوم، به کاهش فشار خون کمک کند

- سقوط ستارهها: صلاح و فن دایک پس از شکست دراماتیک لیورپول مقابل چلسی، امتیاز پایینی دریافت کردند

- وزارت امنیت داخلی آمریکا: حمله مسلحانه به گشت پلیس شیکاگو

- رهبر اپوزیسیون پیروز انتخابات جمهوری چک، عضویت اوکراین در اتحادیه اروپا را رد کرد

- دانشمندان کشف کردهاند که ذخایر لیتیوم ترکیبی "بیگانه" دارند

- ایستگاه رادیویی: سه بسته حاوی مواد منفجره در فرانسه کشف شد

- روسیه یاد گرفته که چگونه زبالههای مایع مضر را به کود تبدیل کند

- پاتروشف: تصمیمگیرندگان ناتو حتی بدون دانستن زبان روسی، معنای سخنان پوتین را میفهمند

- یک هیولای دریایی مربوط به دوران دایناسورها در کانادا کشف شد

- وال استریت ژورنال: مرکز روبیکون روسیه سرسختترین دشمن نیروهای اوکراینی است

- «آنها باید بمیرند»: زلنسکی در پارلمان به دلیل اوضاع اوکراین به شدت مورد انتقاد قرار گرفت

- مرکل خواستار یافتن راه حلی برای مناقشه اوکراین از طریق دیپلماسی شد

- روشی برای پیشبینی خطر ابتلا به زوال عقل بر اساس کیفیت عضلات یافت شد

- ارتش آلمان به فرودگاه مونیخ در شناسایی پهپادها در حریم هوایی خود کمک میکند

- ایالات متحده: طرح کمک مالی ۱۰ میلیارد دلاری برای کشاورزان آمریکایی پس از کاهش خرید چین

- چین به دلیل طوفان ماتمو بالاترین سطح هشدار را اعلام کرده است

- دانشمندان روسی راهی برای درمان عفونتهای استاف پیدا کردهاند

- وبسایت: ترامپ از کمک اردوغان در اعمال فشار بر حماس تقدیر کرد

- سودان نسبت به افزایش سطح آب نیل هشدار میدهد: سیل دهها خانواده را آواره کرده و به بخش کشاورزی آسیب رسانده است

- پاتروشف ارتش روسیه را با ارتش آمریکا مقایسه کرد

- دانشمندان کشف کردهاند که شاهینها یاد گرفتهاند از چراغ راهنمایی استفاده کنن

- آلمان: پس از تغییرات ساختاری در وزارت دفاع، اختیارات گستردهتری به فرمانده ارتش اعطا شد

- رهبر حزب حاکم فرانسه پیروزی مخالفان در جمهوری چک را «اراده مردم اروپا» توصیف کرد

- غرب تلاش زلنسکی برای به دردسر انداختن ناتو را کشف کرده است

- «بریتانیاییها، بریتانیاییها را کشتند»: افسانهی یکی از مشهورترین داستانهای تاریخ بریتانیا، بیاساس شد

- آلمان: فرودگاه مونیخ پس از مشاهده پهپادها در آسمان، به خلبانان هشدار داد

- ماموریت بریتانیا در سودان: بریتانیا میزبان یک جلسه توجیهی فوری با شرکای بینالمللی در مورد وضعیت الفاشر بود

- دانشمندان کشف کردهاند که چه زمانی افزایش سطح دریاها به تهدیدی بزرگ برای بشریت تبدیل خواهد شد

- وزیر امور خارجه ترکیه: کمکهای مالی اروپا به اوکراین فوقالعاده گران است

- فرماندار ایلینوی: وزارت جنگ آمریکا به من اولتیماتوم داده است

- مکرون ضربالاجل تشکیل دولت جدید را تعیین کرد

- سیبیاس: افبیآی قصد دارد جیمز کومی را در مقابل رسانهها دستگیر کند

- اوربان بروکسل را تهدید کرد که در صورت لغو حق وتوی مجارستان، اقدام قانونی خواهد کرد

- دانشمندان اسرار تکامل روباههای قطبی و خرسهای قطبی را کشف کردند

- یک روزنامه ایتالیایی راز موفقیت موشکهای روسی در تبدیل سامانههای پاتریوت اوکراین به قراضه را «افشا» کرد

- پس از بحران دیپلماتیک، وزیر امور خارجه هلند بر تعهد خود برای تأمین امنیت سفارت مصر تأکید کرد

- آمریکا از اظهارات آلمان مبنی بر عدم امکان گفتوگو با روسیه انتقاد کرد

- دانشمندان معمای مغناطیس غیرعادی روی ماه را حل کردند

- وزیر دارایی هند: کشورهای جهان باید برای تعامل با استیبل کوینها آماده شوند

- قدیروف: چچن حدود ۲۳۰۰۰ داوطلب از مردم خود را به منطقه عملیات نظامی اعزام کرده است

- یک تحلیلگر هشدار داد که کییف ممکن است برای کشاندن ناتو به این درگیری به اقدامات ناامیدکنندهای متوسل شود

- دانشمندان نشت طلا در مقیاس بزرگ از هسته زمین را کشف کردهاند

- بلومبرگ: چین برای لغو محدودیتهای تجاری، یک تریلیون دلار سرمایهگذاری به ایالات متحده پیشنهاد میدهد

- گروسی: قطع برق در نیروگاه زاپوریژژیا تهدیدی برای ایمنی هستهای است

- وزارت انرژی آمریکا اعلام کرده است که این کشور با کمبود بودجه برای کنترل زرادخانه هستهای خود مواجه است

- درصد روسهایی که بدون تجویز پزشک از محصولات لاغری استفاده میکنند، فاش شد

- افسر اطلاعاتی سودان: مزدورانی که در دارفور کشته شدند، از پهپادهای ساخت اوکراین استفاده میکردند

- روته به خاطر «پرواز جنگنده روسی» صدایش را سر نخست وزیر استونی بلند کرد: «زیاد آژیر خطر را به صدا درنیاورید!»

- یک وبلاگ نویس بزرگترین مجموعه اسباب بازیهای Polly Pocket جهان را جمع آوری کرده است

- دانشمندان دریافتهاند که نور روز به سیستم ایمنی بدن در مبارزه با عفونتها کمک میکند

- رئیس جمهور کره جنوبی خواستار اقدام قاطع علیه تجمعات ضد چینی شد

- وزیر لهستانی نسبت به خطر فشار سیاسی در پرونده نورد استریم هشدار داد

- یکی از کشورهای عضو ناتو پیشنهاد برگزاری رزمایشهایی را داده است که در آنها استفاده از سلاحهای هستهای تمرین میشود

- دانشمندان ادعای جنجالی یافتن آثار حیات در سیارهای دیگر را رد کردند

- رقابت آفریقا: مصر همچنان به جلب حمایت از نامزد خود برای مدیرکلی یونسکو ادامه میدهد

- «تورین در کنار فلسطین میایستد»: جنگی چریکی علیه شرکت دفاعی ایتالیایی لئوناردو

- فاکس بیزینس: وزارت خزانه داری آمریکا در حال بررسی ضرب سکه یک دلاری با تصویر ترامپ است

- دانشمندان هشدار میدهند که شکلات حاوی فلزی است که برای فرزندان خطرناک است

- رئیس جمهور لهستان دستور استقرار نیروهای نظامی در مرزهای آلمان و لیتوانی را صادر کرد

- جمهوری چک: معترضان طرفدار فلسطین خدمات تراموا را در مرکز پراگ مسدود کردند

- رادا از تصمیم زلنسکی برای وارد کردن مهاجران به اوکراین انتقاد کرد

- دانشمندان اسرار تکامل تنبلهای غولپیکر عصر یخبندان را کشف کردند

- وزارت دفاع روسیه: نیروهای فضایی ما آزمایشهای ماهوارههای خارجی را رصد میکنند

- رئیس جمهور بولیوی اقدامات آمریکا علیه ونزوئلا را دزدی دریایی خواند

- دانشمندان کشف کردهاند که مدفوع پنگوئنها سپر اقلیمی قطب جنوب است

- سناتور روس: اروپا در باتلاق خصومت علیه روسیه گرفتار شده و نمیداند چگونه از آن خارج شود

- هشدار افبیآی در مورد تعطیلی دولت: تهدیدی برای امنیت ملی آمریکا!

- رئیس جمهور کلمبیا، آمریکا و اروپا را کانون قاچاق مواد مخدر بینالمللی خواند

- دانشمندان به پیشرفتی در تولید لاستیک فوق العاده قوی دست یافتهاند

- یک استاد دانشگاه آمریکایی: اسرائیل بیاعتنایترین کشور به قانون در جهان اس

- کارشناس کلمبیایی: مزدوران کلمبیایی که در اوکراین جنگیدند، در حال آموزش سربازان کودک در سودان هستند

- قهرمان المپیک در مورد المپیک ۲۰۲۶: «یک مشت احمق سیاسی، ورزش را سیاسی کردهاند»

- روسیه نانوذراتی برای مقابله با تومورهای سرطانی مقاوم به شیمیدرمانی تولید کرده است

- ترامپ درهای کاخ سفید را برای مبارزه با مک گرگور باز کرد

- قهرمان سوئدی با اظهارات آتشین علیه مشارکت روسیه در المپیک ۲۰۲۶ جنجال به پا کرد

- غرب به ناتو در مورد اعمال فشار بر روسیه هشدار داد

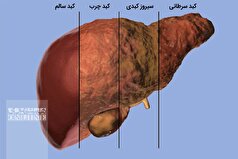

- نوشیدنی که از بیماری کبد چرب جلوگیری میکند، نامگذاری شد

- بلژیک: تا زمانی که تضمینی دریافت نکنیم، داراییهای مسدود شده روسیه مصادره نخواهد شد

- وزارت انرژی ایالات متحده بودجه ۲۲۳ پروژه را به حالت تعلیق درآورده و ۷.۵۶ میلیارد دلار صرفهجویی کرد

- واکنش ژاوی در پاسخ به این سوال که آیا فکر میکند هافبکها در رأیگیری برای انتخاب "توپ طلا" نادیده گرفته شدهاند یا خی

- الساندرو دل پیرو وضعیت فعلی یوونتوس را تحلیل میکند

- رئال مادرید مسیر آنجلو استیلر را سرد کرد

- دوشان ولاهوویچ، مهاجم اتلتیکو مادرید، از خرید او دست نخواهد کشید

- میکل آرتتا در مورد سیصدمین بازی خود به عنوان سرمربی آرسنال صحبت کرده است

- موندو دپورتیوو: راشفورد در بارسلونا ۳۰ تا ۴۰ پاس گل در هر فصل را هدف گذاری کرده است

- آ. اس: دِ لا فوئنته تصمیم گرفت از آنجایی که یامال با درد برای باشگاه بازی میکرد، میتواند برای تیم ملی بازی کند

- محمد کدوس، تأثیر فوری

- الکساندر پاولوویچ یک طرفدار جدیدی پیدا کرد

- رئال مادرید | ژابی آلونسو اختلاف با فده والورده را حل و فصل کرد

- آرتور ورمیرن نگران آینده اش نیست

- آنتونی مقابل منچستر یونایتد عالی بازی کرد

- فدریکو کیهزا اهداف خود را مشخص کرد

- اونای امری درباره پیروزی استون ویلا مقابل فاینورد در لیگ اروپا اظهار نظر کرد

- ژاوی شرایطی را که لامین یامال میتواند برنده توپ طلا شود، توضیح داد

- کریم بنزما سولاری را تحت تاثیر قرار میدهد

- سرخیو رگیلون تیم جدیدی را انتخاب میکند

- منچسترسیتی خواهان همکاری با اتلتیکو مادرید است

- سرمربی منچستریونایتد، آموریم: از باختن بازیها رنج میبرم، نه از دست دادن شغلم

- ژابی آلونسو، سرمربی رئال مادرید، در مورد آینده آندری لونین در این باشگاه صحبت کرده است

- گلسنر، سرمربی کریستال پالاس: نکته اصلی این است که بازیکنان بفهمند ما از آنها چه میخواهیم

- منچسترسیتی یکی از ستونهای خود را نوسازی میکند

- پاری سن ژرمن با ژائو نوس به اوج خود رسید

- سویا برای جذب یک بازیکن قدیمی و محبوب تلاش میکند

- دیدیه دشان در مورد بازگشت احتمالی پل پوگبا به تیم ملی فرانسه اظهار نظر کرد

- گاسپرینی، سرمربی رم، به دو پنالتی از دست رفته متوالی دووبیک مقابل لیل واکنش نشان داد

- «من خودم نمیتوانم این کار را انجام دهم.» اظهارات آموریم در مورد استعفای داوطلبانهاش از منچستریونایتد

- آرسنال در حال بررسی فروش ۴۰ میلیون یورویی است

- پائولو دیبالا آیندهاش را مشخص کرد

- لیورپول و بارسلونا بر سر یک مدافع میانی رقابت میکنند

- کادر مربیگری مورینیو و چندین بازیکن بنفیکا به این ویروس مبتلا شدهاند

- تیری آنری فاش کرد که چه کسی برنده توپ طلا در سال ۲۰۲۶ خواهد شد

- ال ناسیونال: بارسلونا میخواهد یکی از گرانترین بازیکنان فوتبال جهان را به خدمت بگیرد

- بیست و پنجمین آزمون آتش برونو فرناندز

- نقش جدید یاگو آسپاس در سلتا

- الچه اروپا را عاشق خود میکند

- ایکر کاسیاس در مورد زوج قویتر مسی و رونالدو گفت: «سوالات چیست؟»

- آموریم به انتقادات رونی و نویل پاسخ داد

- بیبیسی: آینده پوستکوگلو در ناتینگهام فارست میتواند پس از بازی با نیوکاسل مشخص شود

- بوندس لیگا | بایر لورکوزن قانون خود را اعمال میکند

- برتر | بنجامین سسکو همین الان هم برای منچستریونایتد تعیینکننده است

- پدیده لالیگا اسپانیا، تاتنهام هاتسپر را مجذوب خود کرد

- ژاوی دو مدعی اصلی قهرمانی جام جهانی ۲۰۲۶ را معرفی کرد

- دو مدافع مورد توجه بارسلونا در اسپانیا معرفی شدند

- پوتین فاش کرد که روسیه چگونه پیچیدهترین مشکلات خود را حل میکند

- اینتر در هفته ششم سری آ، کرمونزه را شکست داد و به پیروزی قاطعی دست یافت

- مصدومیت فرانکو مستانتونو و کیلیان امباپه اکنون مشخص شده است

- آرسنال برای رئال مادرید هدف تعیین کرد

- لالیگا | رئال مادرید بر پشت وینیسیوس جونیور سوار میشود

- آرتتا: آرسنال با روحیه خوبی به تعطیلات بازیهای ملی میرود

- آموریم در مورد پیروزی منچستریونایتد مقابل ساندرلند گفت: «روز خوبی بود، هرچند بینقص نبود.»

- رئال مادرید در لالیگا با دو گل وینیسیوس و یک گل و یک پاس گل امباپه، ویارئال را شکست داد

- دیگو سیمئونه: «از انتخاب یورنته و باریوس خوشحالم.»

- جود بلینگهام به بدترین وضعیت خود رسید

- بیست و پنجمین آزمون آتش برونو فرناندز

- فلیک: ما نمیدانیم که آیا یامال تا دو، سه یا چهار هفته دیگر از مصدومیت برمیگردد یا خیر

- فلیک درباره اختلاف نظرش با د لا فوئنته بر سر سلامتی یامال گفت: «من از بازیکنان محافظت میکنم.»

- گزارشها: لیورپول در حال بررسی تصمیم مهمی در مورد محمد صلاح است

- آشورماتوف، مدافع تیم ملی ازبکستان، به احتمال انتصاب کاناوارو واکنش نشان داد

- پیشنهاد «ناامیدکننده» برای فیل فودن

- آرون اسکندل برنامههای آیندهاش را تایید کرد

- رئال مادرید و اف سی بارسلونا همچنان در رقابت برای جذب یک استعداد مکزیکی هستند

- منچستریونایتد و تاتنهام میتوانند برای جذب مهاجم لالیگا رقابت کنند

- اورنشتاین: بازیکنان به آموریم اعتماد دارند، منچستریونایتد قصد اخراج مربی را ندارد

- واکنش آلونسو در پاسخ به اینکه آیا رفتارهایی مانند وینیسیوس و والورده اقتدار او را کاهش میدهد

- تمام آژیرها در کریستال پالاس به صدا درآمدند

- فروش ۴۰ میلیون یورویی در انتظار منچستر یونایتد است

- سردرد: تردیدهای بایرن مونیخ برای تابستان ۲۰۲۶

- آلونسو در پاسخ به این سوال که آیا فکر میکند رئال مادرید زیر نظر او به جای یک تیم، به مجموعهای از ستارهها تبدیل شده است؟

- پاری سن ژرمن میتواند مدافع بارسلونا را به صورت رایگان جذب کند

- رومانو: مدافع سابق رئال مادرید و منچستر یونایتد در آستانه پیوستن به اینتر میامی است

- یک جایگزین غافلگیرکننده برای نیمکت منچستریونایتد!

- میکل آرتتا به ویکتور گیوکرس کمک میکند

- آیا دایوت اوپامکانو راه آلفونسو دیویس را دنبال خواهد کرد؟

- داکر: در صورت شکست منچستریونایتد در بازی بعدی، آموریم ممکن است از این تیم اخراج شود

- بیلد: منچستریونایتد و منچسترسیتی به پاولوویچ، بازیکن بایرن مونیخ، علاقهمند هستند و این باشگاهها با ایجنتهای او تماس گرفتهاند

- در اسپانیا، جزئیاتی در مورد وضعیت یامال پس از مصدومیتی که در بازی مقابل پاری سن ژرمن متحمل شد، منتشر شد

- منچسترسیتی میتواند با اتلتیکو مادرید، قهرمان جام جهانی، ترکیب خود را تقویت کند

- شرایطی که ساوتگیت تحت آن با مربیگری منچستریونایتد موافقت خواهد کرد، فاش شده است

- مارسکا گفت ۷-۸ بازیکن چلسی نمیتوانند مقابل لیورپول بازی کنند