- ارتباط با ما

- |

- درباره ما

- |

- نظرسنجی

- |

- اشتراک خبری

- |

- نگارنامه

فیس بوک برنامه هوش مصنوعی خود را ممنوع کرد

به گزارش مجله خبری نگار، هدف از پروژه Galactica یا برنامه هوش مصنوعی فیس بوک افزایش اطلاعات در علوم مختلف با استفاده از هوش مصنوعی برای غربال کردن ۴۸ میلیون مقاله و کتاب درسی بود. به گفته کارشناسانی که این برنامه را آزمایش کرده اند، این برنامه انواع مزخرفات را مطرح میکند، و برخی از چیزهایی که میگوید «توهینآمیز و خطرناک» بوده اند.

این آزمایش همچنین دستورالعملهای نادرستی در مورد نحوه ساخت ناپالم مادهای که برای ساختن بمب استفاده میشود، در وان حمام ارائه کرده است. چند روز پس از انتشار این نرم افزار، روسای متا مجبور شدند آن را از اینترنت خارج کنند.

این شبکه اجتماعی اعلام کرده است: "هیچ تضمینی برای خروجی واقعی یا قابل اعتماد مدلهای زبان، حتی مدلهای بزرگی که بر روی دادههای با کیفیت بالا مانند Galactica آموزش دیدهاند، وجود ندارد. هرگز توصیههای یک مدل زبان را بدون بررسی آن دنبال نکنید. "

این شرکت همچنین توضیح داده است که این برنامه به خوبی کار نمیکند، زیرا اطلاعات کمتری در مورد یک موضوع خاص در دسترس است.

فیس بوک تأکید کرده است: "مدلهای زبانی بعضا قابل اعتماد هستند، اما اغلب حاوی اشتباه هستند. برخی از متون تولید شده در Galactica ممکن است بسیار معتبر و بسیار قابل اعتماد به نظر برسند، اما میتوانند از جنبههای مهم اشتباه باشند. "

این گروه با اعلام پایان آزمایش برنامه مذکور تصریح کرده است: "از همه شما برای آزمایش مدل Galactica متشکرم. ما به خاطر بازخوردی که تاکنون از جامعه دریافت کرده ایم قدردانی میکنیم و آزمایش را فعلاً متوقف کرده ایم. مدلهای ما در دسترس محققانی است که میخواهند درباره این کار و نتایج بیشتر بدانند. "

- لطفا از نوشتن با حروف لاتین (فینگلیش) خودداری نمایید.

- از ارسال دیدگاه های نا مرتبط با متن خبر، تکرار نظر دیگران، توهین به سایر کاربران و ارسال متن های طولانی خودداری نمایید.

- لطفا نظرات بدون بی احترامی، افترا و توهین به مسئولان، اقلیت ها، قومیت ها و ... باشد و به طور کلی مغایرتی با اصول اخلاقی و قوانین کشور نداشته باشد.

- در غیر این صورت، «نگارمگ » مطلب مورد نظر را رد یا بنا به تشخیص خود با ممیزی منتشر خواهد کرد.

- آخرین اخبار

- محبوب

- برچسب های داغ

- ویدئو| موشکهای کروز ارتقا یافته عراقی به دو هدف اسرائیلی در حیفا و جنوب اصابت کرد

- ویدئو| حزب الله منطقه اشغالی کریوت را در مجاورت ساحل حیفا هدف قرار داد

- فیلم| بمب افکن روسی Su-۳۴ با بمبهای Fab-۵۰۰ یک پایگاه نیروهای کییف در کورسک را منهدم کرد

- ویدئو| دست کم ۷۸ نفر در واژگونی یک کشتی در جمهوری دموکراتیک کنگو کشته شدند

- لکنت ضدانقلاب در پسِ سردرگمی صهیونیستها

- فیلم| ما برای فقدان سیدحسن نصرالله عزاداریم

- فیلم| گفت و گوی جالب رئیس جمهور با خلبانان جنگندههایی که هواپیمای رئیس جمهور را اسکورت کردند

- فیلم| یگانهای قسام از یک کمین مرکب علیه نیروهای اسرائیلی در خان یونس خبر دادند

- فیلم| وضعیت سربازان رژیم صهیونیستی در برابر حملات ایران

- فیلم| شخمزنی موشکهای ایرانی در قلب سرزمینهای اشغالی؛ افتضاح تاریخی گنبد آهنین دهها میلیارد دلاری اسرائیل

- فیلمی از لحظه انهدام یک فرودگاه نظامی اسرائیل در نقب توسط موشکهای ایرانی (ویدئو)

- ویدئویی که از لحظه پرتاب موشک ایران از پایگاههای خود به سمت اسرائیل

- صحنههای سقوط موشکهای ایرانی به تل آویو (ویدئو)

- رسانههای عبری: موشکها به سکوی گازی در سواحل اشکلون اصابت کردند (ویدئو)

- موشکهای ایرانی و ویرانی گسترده بر اثر انفجارهای عظیم در اسرائیل + فیلم ها

- سران متروپولیتانو، اجرای خواننده زن مشهور را به دلیل حمایت از رئالیها لغو کردند

- جان سینا سومین پروژه کارتونی خود را کلید زد + عکس

- سوء قصد مسلحانه به ستاره سابق فنرباغچه و منتقد اصلی علی کوچ + عکس

- فیلم| خباثت به سبک بیبیسی؛ قهرمانسازی از کودکان و تشویق به شورش و براندازی تا تخریب رزمندگان دفاع مقدس!

- نصب استیکر «بچه محل حضرت معصومه س» بر ۱۰۰۰ تاکسی شهری قم

- تایلند هم فیلمش را به اسکار رساند!

- فیلم «زنگار» برای نخستین بار در جشنواره کمرایمیج به نمایش میآید!

- فیلم کوتاه «گوسفند» در جشنواره کوکی آلمان

- تمرینهای مقاومتی برای چه کسانی مناسب است؟

- موفقیت در رسیدن به افزایش سرعت سوئیچینگ در نیمههادیهای دوبعدی

- بلعیدن چندین قرص در یک زمان خطری ندارد!

- بوتولیسم چه نوع مسمومیتی است؟

- تمام نکاتی که باید درباره زندگی سالمندان بدانید!

- ویتامین B ۱ و بهبود عملکرد مغز!

- انفجار هستهای سلاح برای محافظت از زمین در برابر خطرات کیهانی!

- مصرف مکملهای ویتامین «دی» و رسیدگی به سلامت قلب

- تصویر شگفت انگیزی از سیارک ۲۰۲۴ ON از کنار زمین!

- نخستین واکسن سرطان تخمدان که این بیماری را از بین میبرد!

- خوردن سنگهای برجا مانده از سیارکها پیشنهاد غذایی برای فضانوردان!

- نوبل به هوش مصنوعی خواهد رسید؟

- چقدر طول میکشد که هر تمدنی به نابودی برسد؟

- نظریه مونتاژ دیگر نمیتواند پیچیدگی واقعی حیات را توضیح دهد!

- بخشی از مغز که رفتارهای اجباری ناشی از داروی پارکینسون را مهار میکند!

- رعایت نکات بهداشتی راهی ایمن برای دور ماندن از اکثر بیماری ها!

- نور درمانی با لامپهای نور روشن افسردگی را درمان میکند!

- با استفاده از اطلاعات موجود در سلولهای گونه یا لپ سن شما حدس زده میشود!

- چگونه سریع لاغر شویم؟

- با آپدیت جدید واتساپ محیط پسزمینهتان را پنهان کنید!

- سیاهچالهها آن چیزی که فکر میکردید، نیستند!

- هر چه پیرتر میشویم، گذر زمان را سریعتر حس میکنیم؟

- جامعه ماقبل تاریخ ساختاری زنمحور داشته است!

- همه نکات لازم درباره نحوه صحیح تغذیه و پیشگیری از بیماری!

- ایمپلنتهای هوشمند چه بیماریهایی را درمان میکنند؟

- زمان منفی حقیقت دارد؟ چگونه است؟

- رعایت بهداشت خواب یکی از موارد بهبود دهنده کیفیت خواب!

- درک ما از مفاهیم عددی وابسته به تجربیات فیزیکیما!

- عفونت با ویروس سنسشیال تنفسی چیست و چه علائمی دارد؟

- روشهای آسان برای پیشگیری از بارداری مردان

- هوش مصنوعی برای چه دستاوردهایی پیشرفت میکند؟

- چگونه میتوان به اهمال کاری غلبه کرد؟

- رقابت کشورهای مختلف برای ساخت بزرگترین نیروگاههای خورشیدی!

- مولکولهای آب در سراسر سطح ماه وجود دارند!

- بیشترین جمعیت سالمندی برای ایران در آیندهای نه چندان دور!

- ابر ماژلانی کوچک SMC در بالاترین نقطه خود در آسمان رسید!

- چرا کودک خبرچینی میکند؟ راههای درست کنترل آن چیست؟

- نقش مهم تغذیه در سلامت دانش آموزان!

- وقوع فاجعه در اثر برخورد یک سیارک کوچک با زمین

- یک الکترولیت جدید نقطه امیدی برای باتریهای حالت جامد

- معرفی علایم ماربورگ + راههای درمانی!

- اگر واکسن کرونا زده اید کمتر در معرض بیماریهایقلبی عروقی هستید!

- اگر شما هم زیاد پروفایل خود را چک میکنید، بخوانید!

- هوش مصنوعی بیشتری به بخش سرچ گوگل اضافه میشود!

- تمرینهای کوتاهمدت ورزشی خواب شما را بهبود میبخشند!

- اگر دیابت دارید، در معرض ابتلا به آسم هم هستید!

- یک طوفان ژئومغناطیسی شدید نزدیک رسیدن به زمین!

- اهمیت پسانداز باروری قبل از پیری تخمدان

- اگر دچار بیخوابی هستید، درمان شما اینجاست!

- انواع مختلفی از آنتی اکسیدانها در این مواد غذایی!

- نوشیدن آب در افزایش ظرفیت حافظه موثر است!

- ترکیب زردچوبه و زنجبیل برای این بیماریها معجزه میکند!

- تضمین سلامت استخوانها با مصرف کافی ویتامین D

- بیخوابی چه علتی دارد؟

- موشکهای هایپرسونیک غیر قابل سرنگونی!

- پیری مغز را میتوان کنترل کرد؟

- تاثیر سونا بر کاهش فشار خون و باز شدن رگهای قلبی

- این بازیگر زن بیشترین دستمزد در بین زنان ایرانی را دارد؟

- تیپ دهه ۶۰ محسن تنابنده زودتر از «زودپز» بیرون آمد

- استوری ادایی نیما شاهرخ شاهی /آقای بازیگر هم رفتنی شد!

- لاغری شوکه کننده غلامحسین لطفی /چه بلایی سر آقای بازیگر اومده؟

- استایل با حجاب «نگار استخر» بعد سالها خارج نشینی/خانم بازیگر اصالت خودش رو خفظ کرد

- حجم بالای هدایا و گلهای تولد «بانو سویا» شگفت زدتون میکنه

- پژمان جمشیدی «محکوم» میشود

- با گذشت ۱۶ سال بازیگر نقش «بشیر» در سریال عشق ممنوع دیگه نمیشناسید+عکس

- مجری برنامه کمدی گولدور گولدور یک قرارداد تبلیغاتی امضا کرد

- جیهات تامر ۸۱ ساله داغدار پسرش شد

- کیت بلانشت با قاشق برای خودش زره جنگی درست کرد! +عکس

- جمله زیبایی که شیلا خداداد متن کارت عروسی اش را با آن آغاز کرد!

- تصویری غم انگیز از آخرین روزهای خوبی که حامد سلطانی توی زندگی اش دید

- جشن تولد لیلی مجنونی ساعد سهیلی برای همسرش در یک رستوران سوژه شد

- گریم بازیگران سریال "پایتخت ۷" در پشت صحنه! +عکس

- بهزاد فراهانی در آستانه ۸۰ سالگی با ظاهری بشاش و آراسته+عکس

- نامزد خوشبخت لیدی گاگا کیست؟

- واکنش جذاب رپر معروف به یک ساله شدن پسرش

- ستاره ۷۰ ساله هالیوود و دختر جذابش چشمها را خیره خود کردند

- یاعمور یوکسل پلههای ترقی را به سرعت طی میکند

- سلنا گومز از اظهار نظرات درمورد ظاهرش به تنگ آمد

- خطر بزرگی که از بیخ گوش پاتریک ماهومز و تراویس کلس رد شد

- لوک گرایمز و همسرش بیانکا برای در آغوش کشیدن فرزندشان لحظه شماری میکنند

- حضور ستاره «لا لا لند» و شریک زندگی اش در بازیهای المپیک ۲۰۲۴ پاریس

- جزئیات اوضاع و احوال پسر آنجلینا جولی بعد از یک تصادف دلخراش

- دسته گل بزرگ زندایا به مناسبت آخرین شب اجرای تام هالند در یک تئاتر

- عزاداری غریبانه سارا خوئینیها برای مردهای خانواده اش/اشکتون درمیاد+عکس

- سارا و نیکا برای تولد دوقلوهای پسر پایتخت سنگ تمام گذاشتند

- جوانیهای احسان علیخانی در جوار سرمربی پر آوازه منچستر یونایتد +عکس

- روحیه هنری بهرام رادان در همسرش هم تاثیر گذاشت/استوری حال خوب کن مینا مختاری را ببینید

- تابحال دخترخوانده بهاره رهنما را دید اید؟/ یک شب رویایی خانم بازیگر با حاجی

- تصویری از پارتی کردن مینا مختاری که فضای مجازی رو ترکوند

- چهره داغون نرگس محمدی در مراسم عزای برادر زاده ۲ ساله اش/نفس برای خانم بازیگر نموند+عکس

- شروع یک روز دل انگیز به سبک شهرزاد کمال زاده+عکس

- استایل تابستانه ترلان پروانه در تراس فوق لاکچری اش/چه خونه زندگی داره!

- استایل شلخته مادر پوریا پورسرخ در یک لوکیشن اعیانی

- دختر ناز همایون شجریان با نامادریش در گردش+عکس

- مهدی یغمایی در غم از دست دادن برادرش پیر شد+عکس

- بچه سوسولترین بازیگر سینمای ایران گنده لات محل میشود+عکس

- سورپرایز رفقای جینگ فریبا کوثری به مناسبت روز تولدش

- شال و کلاه کردن فریبا نادری در یک رستوران دنج همراه با حضرت یار! +عکس

- عکسهای خصوصی از مراسم عقد و عروسی ژیلا صادقی/مرزهای خلاقیت را جا به جا کردند

- پوست برنزه شده سحر دولتشاهی با یک میکاپ اصیل جنوبی تکمیل شد

- شوآف سوسکی همسر بهرام رادان با گوشی گران قیمتش+عکس

- عکس وایرال شده از چهره غمگین و گرفته فرزاد حسنی در مراسم خاکسپاری عسل بدیعی/روحش شاد

- ذوق و شوق کودکانه سام درخشانی از خرید موتور جدیدش/چه اسم قشنگی هم انتخاب کرد براش!

- تیکه سنگین بهرنگ علوی مربوط به رعایت بهداشت در تابستان/تو امیرکبیر نیستی..

- عکس وایرال شده از امضای هنرمندانه بازیگر آسمانی/شیک و هنری

- سورپرایز ویژه دوست پسر زهرا گونش برای تولد خانم والیبالیست با تدارکات ویژه/عکس

- سفر زیارتی فریبا نادری به کربلا با استایل جدید و شیکش با چادر مشکی/چقدر حجاب بهش میومده!

- رونمایی رضا گلزار از جدیدترین ماشین اسپرت و دو درش/چندتا ماشین داره؟

- رونمایی زوج عاشق پیشه سینما از دکوراسیون شیک و مجلل خانه شان/سلیقه این زوج چطور است؟

- سورپرایز ویژه خانمهای بازیگر برای تولد نرگس محمدی با کلاههای مخصوص! /استایل ماندگار به این میگن

- عکس زیرخاکی وایرال شده از دوران کودکی المیرا دهقانی با موهای فرفری و چهره عروسکی/چقدر تو دل برو!

- جشن تولد متفاوت و ناراحت کننده حامد سلطانی برای همسر آسمانی اش/روحش شاد

- تصاویر ناراحت کننده منتشر شده از بازیگران معروف در مراسم تشییع پسر بزرگ نسرین مقانلو/خدا صبرش بده

- خاطره بازی بهاره رهنما به یاد روزهای خوش قدیم با همسر سابقش/متن عاشقانه هم براش نوشت!

- عکس منتشر شده از مادرزن جوان و خوشتیپ شهاب حسینی در مجاری پر بازدید شد!

- ستاره سادات قطبی جذابترین قاب خانوادگی اش را به اشتراک گذاشت/ماشاالله به این خانواده پر جمعیت!

- رونمایی سیاوش خیرابی از دو ساید نیک و شرش! /جاش تو سریال لوسیفر خالی بوده

- حمایت بانکها از بازار سرمایه از فردا اجرا میشود

- بورس سقوط کرده در دولت روحانی چگونه در دولت شهید رئیسی احیا شد؟

- درمان بورسی پزشکیان از زبان عبده

- جذب سرمایه ۷ همتی از بازار بورس دانشبنیانها

- وعده عناب بورسی واقعیتر شد

- چهارمین روز نزولی بازار در غیاب نیروهای صعودی

- انتخابات و دامنه نوسان مهمترین دلیل رکود فعلی بورس

- بورس با ۴ مصوبه دولت برای حمایت از بازار سهام سبزپوش میشود؟

- ۳ دلیل پایین بودن ارزش معاملات خرد در بورس

- معافیتهای مالیاتی بازار سرمایه باید استمرار پیدا کند

- بورس این روزها تحت تأثیر تداوم نرخ اخزای بالای ۳۵ درصد

- رشد شاخصهای بورس با کف سازی تکنیکال

- کاهش دامنه نوسان هم علاج بورس نزولی نبود

- سایه تامین مالی دولت بر سر بورس سنگینی میکند

- کاهش بی سابقه حجم معاملات سهام در بورسهای جهانی

- رشد شاخصهای بورس با کمک بانکیها و اعلام نرخ تسعیر ارز

- حمله به سفیر روسیه در لهستان

- معرفی سری گوشیهای Redmi K ۵۰ قبل از رونمایی رسمی

- غفوری: فکر کردن به قهرمانی از الان، سادهلوحانه است

- کاهش ۱۰ درصدی تولید هوندا در دو کارخانه

- سومین نشست دستمزد، باز هم بدون نتیجه

- لغو بلیت فروشی عمومی المپیک زمستانی چین

- گرامیداشت قربانیان هواپیمای اوکراینی در دانشگاه تورنتو

- ادامه چانهزنی چهارگانه در وین

- صرفهجویی ۱.۶ میلیارد دلاری کمیته برگزاری المپیک و پارالمپیک توکیو

- محبوبترین رشته المپیک توکیو مشخص شد

- اعلام هزینه میزبانی توکیو از المپیک و پارالمپیک ۲۰۲۰،

- آذرتاج: هیات اقتصادی جمهوری آذربایجان به ایران میرود

- بررسی عملکرد ایران در المپیک؛ جایگاه چهارمی در آسیا

- پایان وضعیت اضطراری در کشور میزبان المپیک ۲۰۲۰

- چگونه فتاح گنبد صهیونیستی را سوراخ سوراخ کرد؟

- وعده صادق ۲، فراتر از یک واکنش نظامی

- چرا ایران قلب تلآویو را هدف قرار داد؟ استدلال حقوقی

- چالش عجیب کاشت حلزون در ناشنوایان! شکلگیری باورهای غلط

- ۱۳ مهر فین با قالیشویان

- کاری که همتی با مالیاتها قصد انجام آن را دارد؟

- «ببعی قهرمان» جا پای «کلاه قرمزی»؟

- کام دنا تلختر هم میشود؟!

- به وقت مُذِلّ کُلِّ صهیونیست

- وینیسیوس و یک سورپرایز ویژه در حوالی کسب توپ طلا

- بالاک به منتقدان رابطه عاشقانه خود با "معشوقه پسر مرحومش" پاسخ میدهد

- محققان میگویند مهاجرت در دوران نوجوانی با افزایش خطر روان پریشی مرتبط است

- هشدار پزشکان نسبت به یک "اپیدمی سه گانه" ناشی از ویروسهای مرگبار زمستانی

- آیا خوردن سیر در فصل سرما کمک میکند؟

- میخکوب شدن مجدد در ضیافت وحشت و معما

- اوج بدغذایی در ۷ سالگی! علت اصلی بدغذایی کودکان پیدا شد

- پول در جیب پسر ۱۴ سالهام نمیماند!

- اثبات عشق به همسر با چند فرمول خیلی ساده

- سگِ هار آمریکایی پیام وعده صادق را به خوبی دریافت کرد

- متا پس از میلیونها دلار ضرر قربانیان، ۹۰۰۰ تبلیغ تقلبی را از برنامههای خود حذف کرد

- بوریس جانسون راز خطرناکی را در مورد بنیامین نتانیاهو فاش کرد

- پنج غذا و نوشیدنی که "شما را جوانتر نشان میدهد"

- اسکن مغز بینندگان راز شهرت نقاشی «دختری با گوشواره مروارید» را آشکار میکند

- کودکی سرگردان در کوچه پس کوچههای مشهد

- دست و پا زدن سانسورچیهای صهیونیستی

- قطع انگشت با شمشیر پس از کلکل مجازی

- پمپبنزین پیکنیکی یا دلمشغولی!

- دلار با تنشها، متشنج نشد

- سیستم جامع امنیتی «شاباک» هک شد

- جزئیات تلههای انفجاری حزبالله ضد کماندوهای اسرائیلی

- روسیه تاریخ پرتاب اولین ماهواره Express-RV را اعلام کرد

- کلارا آمو، مجری بریتانیایی «بازمانده» سختترین مراحل دوران کودکی خود را فاش میکند

- وعدهای که زندگی در خاورمیانه کاشت

- مارالدوستان منطقه سبز ایران را قرق کردند

- درباره لجنپراکنی نسخه لبنانی منافقین و «رجوی»

- گشتی در پاتوق خوشمزه مزه عربی در پایتخت ایران!

- روزنامه نگار وینی ویلیامز "بازگشت از آینده": "آنچه انتظار داشتم اتفاق افتاد. وقت آن است که دیدی را تنبیه کنیم.»

- جانسون: الیزابت دوم قبل از مرگش به سرطان استخوان مبتلا بوده است! در مورد این بیماری چه میدانید؟

- تغییر در مرزهای سوئیس و ایتالیا به دلیل تغییرات آب و هوایی!

- اخبار داغ

- ورزشی

- پربیننده

- پربحث

- حمله پهپادی اوکراینی به اتوبوس مسافربری در گورلوفکا ۹ نفر را مجروح کرد

- ژنرال ارشد ایالات متحده برای هماهنگی پاسخ به ایران به اسرائیل میرود

- شهید و زخمی شدن دو خانواده در حمله هواپیماهای جنگی اسرائیل به دو خانه در نوار غزه

- وقف فلسطین تعداد مساجد ویران شده در نوار غزه را فاش کرد

- رویترز: امارات متحده عربی اولین مجوز فعالیتهای قمار در خلیج فارس را صادر میکند

- صحبتهای اسلات درباره آلیسون پس از پیروزی مقابل کریستال پالاس هواداران لیورپول را ترساند

- بهداشت لبنان از شهید شدن ۲۵ نفر و زخمی شدن ۱۲۷ نفر در حملات دیروز اسرائیل خبر داد

- سخنگوی پارلمان ترکیه از واشنگتن خواست تا در موضع خود در قبال اوکراین تجدید نظر کند

- تاکید امارات متحده عربی بر لزوم آتش بس در لبنان و حفاظت از غیرنظامیان

- سفیر سوریه در مسکو واشنگتن را به مشارکت مستقیم در تجاوز اسرائیل متهم کرد

- تیم کره جنوبی در آستانه بازی با اردن و عراق ضربه خورد

- اقتصاد اروپا در معرض خطر «مرگ» قرار دارد

- معلم امارات متحده عربی به دلیل دستکاری در نتایج امتحانات زندانی شد

- نبنزیا: آلمان از تحقیقات در مورد بمباران نورد استریم جلوگیری میکند

- چگونه از سوزش سر دل خلاص شویم؟

- دانشگاه فیزیک و فناوری مسکو یک موسسه هوش مصنوعی را افتتاح میکند

- چه زمانی میتوان به سیارات دیگر سفر کرد؟

- بلینکن و سبیگا در مورد بخش انرژی اوکراین در آستانه زمستان گفتگو میکنند

- دانشمندان اولین واکسن جهان را برای از بین بردن سرطان تخمدان تولید کردند

- اطلاعات فضایی ایالات متحده: پنتاگون شبکه جدیدی متشکل از ۱۰۰ ماهواره نظامی را تشکیل میدهد

- بهداشت جهانی: تعداد سیگاریها تا اواسط قرن ۲۶ درصد کاهش مییابد

- شکنجه تا حد مرگ مرد جوان مصری پس از خواستگاری

- "فوربس" احتمالا زلنسکی ۳ چهره تأثیرگذار در تیمش را اخراج خواهد کرد

- «ودکای کودکان» منجر به استعفای مقامات در لهستان شد

- لاوروف: ایالات متحده کوچکترین محکومیتی را علیه حمله زمینی اسرائیل به لبنان ابراز نکرد

- سازمان جهانی بهداشت استفاده اضطراری از اولین آزمایش تشخیصی آبله میمون را تایید کرد

- چین| تشخیص مکانیسمهای تشکیل "صداها در مغز" در افراد مبتلا به اسکیزوفرنی

- رسانهها: فنلاند در رزمایشهای هستهای ناتو شرکت خواهد کرد

- کالبد شکافی علت مردن "نهنگ جاسوسی روسی" را فاش کرد

- اظهارات مقام امنیتی روسیه در مورد بمب گذاریهای پیجرها در لبنان

- ۳ مقام حماس افشا کردند که سنوار یک سال پس از «طوفانالاقصی» چه فکر میکند

- صنعت خودروسازی اتحادیه اروپا با "سقوط وحشتناک" روبرو است

- اولین علائم لخته شدن خون

- شرکت فرانسوی-آلمانی ۱۲ هویتزر در اختیار اوکراین قرار میدهد

- تحرک در بازار برنج با اعلام نرخ خرید تضمینی

- خبر خوب| افزایش تولید برنج در گیلان و عدم نیاز به واردات

- واشنگتن: ۲۰ موشک ایرانی در پایگاه هوایی نواتیم اسرائیل فرود آمد

- هشدار بورل: اگر اسرائیل تاسیسات هستهای ایران را هدف قرار دهد، روسیه و سایر کشورها وارد درگیری خاورمیانه میشوند

- حزب الله اعلام کرد سربازان اسرائیلی را در جریان پیشروی آنها در جنوب لبنان هدف قرار داد

- اردوغان نسبت به «طرح بدخواهانه اسرائیل» بزرگتر از غزه، کرانه باختری و لبنان هشدار داد

- دی بروین و لوکاکو از ترکیب بلژیک برای رویارویی ایتالیا و فرانسه خارج شدند

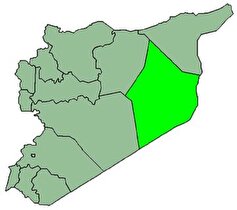

- بیانیه سوریه در مورد بمباران «وحشیانه اسرائیل» به جاده بین المللی که لبنان و سوریه را به هم متصل میکند

- مدیریت النصر درخواست استفانو پیولی را تایید کرد

- رونالدو در ترکیب تیم پرتغال برای تقابل لهستان و اسکاتلند قرار دارد

- کشورهای اتحادیه اروپا از تعرفههای خودروهای الکتریکی چینی حمایت میکنند

- پوتین در روز تولدش با رهبران کشورهای مستقل مشترک المنافع دیدار خواهد کرد

- بنزما در الاتحاد به رکورد خود با رئال مادرید برگشت

- کابلوف تصمیم حذف طالبان از فهرست تروریستی را در بالاترین سطوح تایید کرد

- مونتاژ یک ماهواره ارتباطی جدید با قطعات کاملا بومی در روسیه

- ۳ برابر سبکتر| کارشناسان روسی هواپیمای بدون سرنشین با مشخصات متمایز را توسعه میدهند

- سرمربی لیورپول سوال در مورد صلاح را مسخره کرد

- لوکاشنکو به لهستان در مورد عواقب تلاش خود برای تصرف غرب اوکراین هشدار داد

- پیشنهاد پوتین در شورای امنیت روسیه در مورد راه اندازی یک سیستم پرداخت بین المللی

- افسر امنیتی نیروگاه هستهای زاپوروژیه در انفجار خودروی بمب گذاری شده کشته شد

- فیفا اسپانیا را به پس گرفتن میزبانی جام جهانی ۲۰۳۰ تهدید کرد

- مراکز بهداشتی و درمانی به دلیل هدف قرار دادن اسرائیل از کار افتاده اند

- سی ان ان: آمریکاییها شروع به خرید دستمال توالت به صورت عمده کردند

- قویترین درخشش خورشید را از سال ۲۰۱۷ مشاهده کنید

- لاوروف: ما از تلاشهای مقامات افغان برای دفع تهدید تروریستی در منطقه حمایت میکنیم

- بیانیه وزارت امور خارجه مصر پس از کشته شدن تعدادی از مصریها بر اثر گلوله ارتش مکزیک

- بیانیه مصر و عربستان سعودی در مورد وضعیت لبنان و غزه

- به درخواست فلسطینی ها| فیفا برای حذف اسرائیل از تمامی مسابقات، اقدام و تحقیقات را آغاز کرد

- بورتنیکوف: واشنگتن به همراه متحدان خود به دنبال گسترش منطقه جنگی به بلاروس و مولداوی است

- قیمت نفت به بالاترین سطح از پایان ماه آگوست رسید

- ارتش مصر برای انهدام جتهای جنگنده F-۳۵ و تانکهای مرکاوا آموزش میبیند

- فایننشال تایمز: پاسخ اسرائیل به حملات موشکی ایران «متعادل» خواهد بود

- کره جنوبی قطر ایرویز و عربستان سعودی را به دلیل «نقض» قانون هوانوردی جریمه کرد

- نقدینگی در عربستان سعودی در بالاترین حد تاریخی خود قرار دارد

- نخست وزیر جدید ژاپن: ما به فشار بر روسیه و حمایت از اوکراین ادامه خواهیم داد

- نویسنده هندی بر اهمیت جایزه بین المللی صلح لو تولستوی تاکید کرد

- وزیر دارایی عربستان سعودی: کشورهای خلیج فارس با چالش کاهش وابستگی به نفت روبرو هستند

- فیفا بازار نقل و انتقالات موقت را به مدت ۱۰ روز باز کرد

- آژیر خطر در شمال اسرائیل به صدا درآمد، شلیک ۲۰ راکت از لبنان به سمت سرزمینهای اشغالی

- ارتش روسیه شب گذشته ۱۸ پهپاد را بر فراز خاک این کشور سرنگون کرد

- پیشروی عمده ارتش روسیه در نزدیکی کوبیانسک در استان خارکف

- تثبیت قیمت نفت پس از افزایش سرسام آور به دلیل اظهارات بایدن

- محمد صلاح در رادار باشگاههای اروپایی در سال ۲۰۲۵ برای "حفظ شهرت"

- متخصصان روسی مهمات منفجر نشده را در نزدیکی نیروگاه هستهای زاپوروژیه پیدا کردند

- اتحادیه رادیو و تلویزیون اسلامی هدف قرار دادن دفتر روابط رسانهای حزب الله در بیروت را محکوم کرد

- امیر قطر دستور داد تا منابع لازم را برای حمایت از آوارگان و آسیب دیدگان تجاوز اسرائیل به لبنان فراهم شود

- ۳ مقصد احتمالی برای پوگبا پس از تعلیقهای متعدد

- آرسنال در یک بازی هیجان انگیز با ۳ گل ساوتهمپتون را شکست داد

- تراکتور- فولاد؛ نبرد قرمزپوشان مدعی بدون اسکوچیچ

- راموس سر از تورین درمیآورد؟

- بحران احتمالی بین ستارههای النصر به خاطر مسی! داستان چیست؟

- پیروزی تیم فوتبال نفت گچساران بر همنام خوزستانی نفت مسجدسلیمان

- لیائو: قبل از اینکه به ستاره بودن در میلان فکر کنم به برنده شدن در مسابقات اهمیت میدهم

- سرمربی زنبورها: سلتیک باشگاهی با ابهت و مربی خارقالعاده است

- توپچیها در کار با توپ دارای هویت واقعی و در قله فوتبال اروپا هستند

- فخرفروشی وینی در اوج عصبانیت با کاپیتان روخیبلانکوس

- فونسکا: در مقابل تیم آلونسو بیشتر به دفاع کردن میپردازیم

- نیستلروی، تن هاخ را تنها گذاشته است! تعهدی در کادر فنی نیست

- جیب بارسا سبز میشود؟ عملیات نجات از بحران مالی با نایکی

- فودن لبخند بر لب دارد و همچنان عاشق فوتبال است

- آنژ، منچستریونایتد را در نیمه زمین خودش زندانی کرده بود

- آنچلوتی: من مثبتاندیشم نه منفیباف! درباره اندریک درام نسازید

- کدام بازیها در حکم هدایت تن هاخ به سوی درهای خروج اولدراتورد است؟

- رفتار محترمانه و جالب وینیسیوس مقابل هواداران اتلتیها

- پیشنهاد حقوق نجومی عربستانیها برای ترغیب فرعون آنفیلد

- زیرکزی و گارناچو میتوانستند برای ما بازگشت به ارمغان بیاورند

- ال چولو: شما میتوانید شادی گل کنید، اما تحقیر و مسخره کردن هواداران رقیب نه!

- نویل: همه چیز در اولدترافورد دست تیم آنژ بود

- سانچو روزهای خوش خود در غرب لندن را به رخ تیم بحران زده تن هاخ کشید + عکس

- تیم کمپانی از باواریاییهای پپ هم شایستهتر است!

- کنایه تند اسکولز به تن هاخ: خوب تو هم مثل سبک تیم آنژ بازی کن!

- انجل گومز دوباره جزیرهنشین میشود؟

- هواداران اسپرز عاشق تیم تن هاخ شدند!

- رستاخیز وینگر ولزی زنبقهای سفید با خروج از اینستاگرام

- نوجوان ۱۶ ساله ستاره جدید قرمزهای مرسیساید؟

- رسیدن کهکشانیها به رکورد بازیها بدون باخت بارسا در بازی با بارسا

- آلیسون: لیورپول مجموعهای خاص است، من با خدا هر کاری میکنم

- فقط یک گل برای بازگشت ولاهوویچ به دوران اوج نیاز است

- ایمان داشتم که بازی با منچسترسیتی را پیروز خواهیم شد

- خالد الشنیف: به هر مربی طاس اعتماد دارم

- دوئل بزرگ اندیشههای پپ در آلیانتس آرنا!

- وینگر ساحل عاجی فصل قبل ترک تلکام از شرایط زندگی در فرانسه راضی نیست

- توپچیها با توپ پر سراغ ستاره آلونسو میروند

- اسطوره بایرن مونیخ: آلیانتس آرنا باید موسیالا را مادامالعمر نگه دارد

- ستاره دروازهبانی سابق توپچیها در حال مستی بازداشت شد!

- گلر سابق بانوی پیر، به خاطر بارسا دستکش به دست کرد

- هوادار الهلال خطاب به رمیها: ما بزرگتریم! الهلال در جام جهانی باشگاههاست اما شما در لیگ اروپا

- توپچیها، تروسار را تا سال ۲۰۲۷ در امارات حفظ میدارند

- سرمربی پیاسجی: بارسا تیم درجه یک نیست؛ گلر آنها رکورد زیر توپ زدن را داشت

- ژاکا: مونیخ کمپانی را تحلیل کردیم و میخواهیم اذیتشان کنیم

- پالمر: دوست داشتم کنار هازار به میدان بروم

- کهکشانیهای آنچلوتی، بارسای والورده را به زیر میکشد؟

- رئیس مارسی: ما به استعداد و توانایی گرینوود اعتقاد زیادی داشتیم

- تیم تن هاخ در گل کردن موقعیتها نام است

- رافینیا، نظر مثبت نیوکمپ را جلب کرد

- یک شعار نازی، کاتالانها را در UCL به دردسر انداخت