- ارتباط با ما

- |

- درباره ما

- |

- نظرسنجی

- |

- اشتراک خبری

- |

- نگارنامه

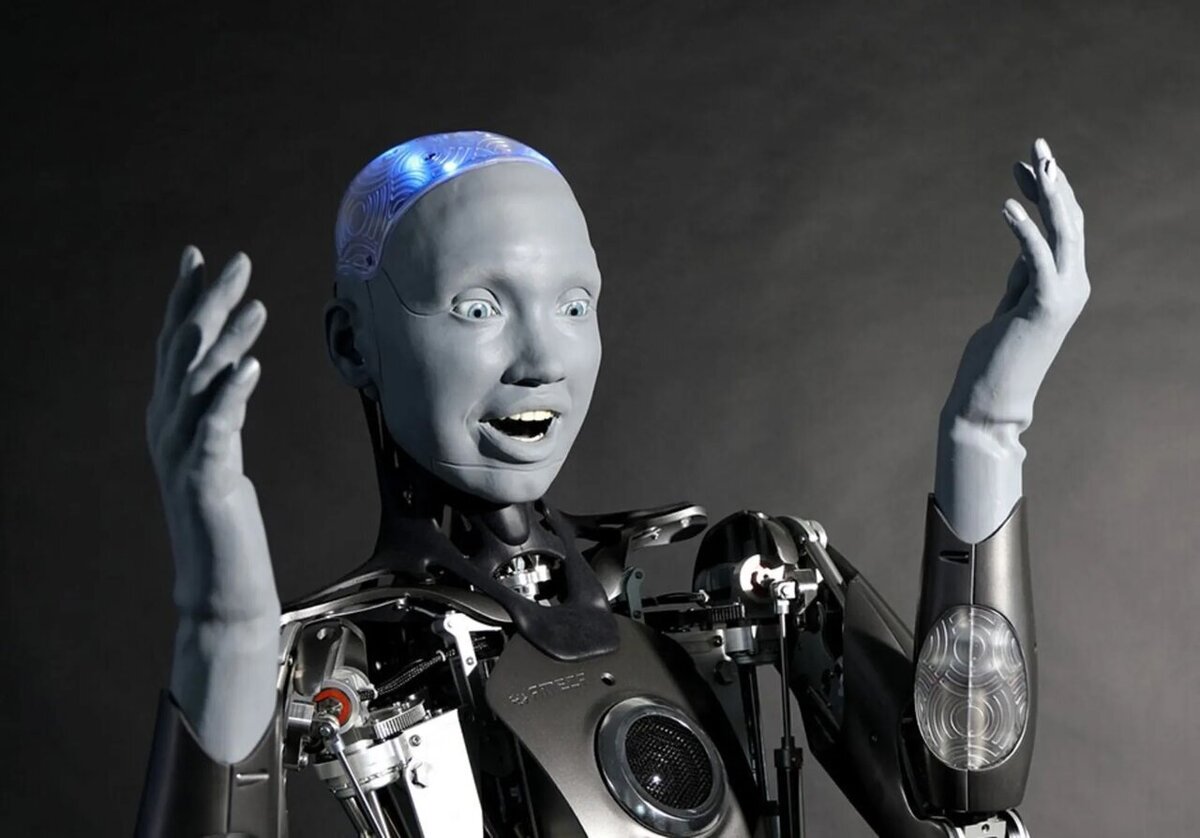

با پیشرفت فناوری جایگاه انسان چه تغییری میکند؟

به گزارش مجله خبری نگار/ایمنا، در میانه قرنی که همه چیز با شتابی غیرقابل تصور تغییر میکند، مرز میان علم و جنگ، میان فناوری و امنیت، بهطرز خطرناکی محو شده است، میدانهای نبرد دیگر شبیه آن چیزی نیستند که از تصاویر تاریخ به یاد میآوریم، امروز نبرد در لایههای نامرئی دادهها و سیگنالها جریان دارد، جایی که سرعت پردازش اطلاعات تعیین میکند کدام فرمانده زودتر تصمیم بگیرد و کدام کشور برتری راهبردی را از آن خود سازد.

بیشتر مطالعه کنید

پشت درهای بستهی اتاقهای فرماندهی، نمایشگرهایی روشن است که حجم عظیمی از دادههای لحظهای را نمایش میدهد. هزاران سیگنال، تماس، موقعیت مکانی و تصویر، همگی بهصورت پیوسته در جریاناند و سرنوشت انسانها را رقم میزنند. در چنین فضایی دیگر تصمیمگیری به دست ژنرالهای باتجربه نیست؛ الگوریتمهایی خاموش، اما قدرتمند، آرام و بیوقفه در حال سنجش، مقایسه و پیشبینیاند.

وقتی صحبت از فناوریهای نوین به میان میآید، ذهن بسیاری به ابزارهای تجاری، گوشیهای هوشمند یا دستیارهای مجازی میرود، اما واقعیت آن است که همان کُدهایی که برای سادهتر کردن زندگی روزمره نوشته میشوند، در کسری از ثانیه میتوانند در خدمت ارتشها قرار گیرند و معنای تازهای به جنگ بدهند. نبردهای آینده بیش از آنکه به حجم آتش یا تعداد نیروها وابسته باشند، به توانایی در «دیدن زودتر»، «تحلیل سریعتر» و «اقدام هوشمندانهتر» متکی خواهند بود.

با این حال، پشت این ظواهر فناورانه پرسشهایی سنگین و هراسآور پنهان است: چه کسی مسئول تصمیمی خواهد بود که جان هزاران نفر را در یک لحظه تغییر میدهد؟ آیا میتوان اعتماد کرد که ماشینها بدون خطا و بدون سوگیری عمل کنند؟ و اگر این روند ادامه پیدا کند، آیا جهان در آستانه رقابتی تازه قرار نمیگیرد؛ رقابتی که شباهتی عجیب به سایههای جنگ سرد دارد، اما این بار با سلاحهایی نامرئی و هوشمند؟

امروز دیگر روشن است که فناوری نهتنها ابزار توسعه، بلکه ابزار بازدارندگی و بقا در عرصه جهانی شده است. آنچه زمانی رؤیای رمانهای علمیتخیلی بود، اکنون در هیئت برنامههای رسمی دفاعی و قراردادهای میلیاردی ظاهر شده است، و درست همینجا در مرز میان واقعیت و آینده، پرسشی اساسی سر برمیآورد: آیا انسان میتواند همچنان بر تصمیمات حیاتی کنترل داشته باشد، یا بهزودی باید فرمان را به دست سامانههایی بسپارد که نه احساس دارند و نه پشیمانی میشناسند؟

ورود هوش مصنوعی به ارتش آمریکا

زینب اصغریان، استاد دانشگاه و کارشناس مسائل بینالملل در گفتوگو با خبرنگار ایمنا اظهار کرد: پنتاگون در سال ۲۰۲۳ بیش از ۹۵ درصد بودجه دولتی هوش مصنوعی را دریافت کرده است، این تمرکز مالی نشان میدهد که آمریکا در حال رقابت راهبردی جدی با چین در حوزه تسلیحات هوشمند است. گزارش کمیسیون ملی امنیت و هوش مصنوعی آمریکا نیز در سال ۲۰۲۱ تأکید میکند که تسلط بر فناوریهای نوین، عنصر کلیدی پیروزی در این رقابت محسوب میشود.

نقش شرکتهای خصوصی در پروژههای نظامی

وی افزود: همکاری پنتاگون با شرکتهای خصوصی ابعاد تازهای پیدا کرده است، بهعنوان نمونه شرکت OpenAI با قرارداد ۲۰۰ میلیون دلاری در قالب برنامه «OpenAI برای حکومت» نسخههای سفارشیشده مدلهای خود را برای تحلیل دادههای طبقهبندیشده و پشتیبانی تصمیمگیری فرماندهان توسعه میدهد. در سوی دیگر شرکت xAI به رهبری ایلان ماسک با مدل «Grok برای حکومت» قرارداد مشابهی را منعقد کرده و ابزارهای تحلیلی آن در حوزه حسگرها و جنگ الکترونیک بهکار گرفته میشوند.

این استاد دانشگاه گفت: ورود بازیگران تجاری به عرصه امنیت ملی، مفهوم «خصوصیسازی جنگ» را تقویت کرده و خطر تضاد منافع میان سود اقتصادی و اصول انسانی را افزایش داده است. بنیاد New America در این زمینه هشدار میدهد که چنین روندی میتواند دموکراسی و نظارت مدنی را تضعیف کند.

چارچوبهای نظارتی و محدودیتهای اخلاقی

اصغریان توضیح داد: وزارت دفاع آمریکا در سال ۲۰۱۸ اصول اخلاقی استفاده از AI نظامی را تصویب کرد، این اصول شامل مسئولیتپذیری، قابلیت درک عملکرد، انصاف و جلوگیری از آسیب غیرضروری است.

وی افزود: با وجود این چارچوبها، در عمل ابزارهای جدید با چالشهای اخلاقی جدی روبهرو هستند. دیدهبان حقوق بشر تأکید میکند که حذف یا کاهش نقش انسانی در تصمیمگیریهای مرگبار، مغایر با حقوق بشردوستانه است.

شباهت پروژههای آمریکا و رژیم صهیونیستی

این استاد دانشگاه به شباهت میان پروژههای پنتاگون و سامانههای رژیمصهیونیستی اشاره کرد و بیان کرد: ارتش این رژیمصهیونیستی در حملات اخیر به غزه از سیستمهایی به نام Lavender و Gospel برای شناسایی و انهدام اهداف استفاده کرده است. روزنامه لوموند گزارش داده که Lavender با تحلیل تماسها و شبکههای اجتماعی، فهرستی از ۳۷ هزار مرد فلسطینی را بدون راستیآزمایی انسانی بهعنوان مظنون تولید کرده است. Gospel نیز با رهگیری تصویری، فرماندهان مقاومت را در منازل هدف قرار میداد.

وی افزود: مقایسه تطبیقی نشان میدهد که این سامانهها و مدلهای آمریکایی در چند محور مشترک هستند؛ تحلیل دادههای انبوه غیرساختاریافته، تصمیمسازی خودکار بدون مداخله انسانی عمیق، و تولید انبوه اهداف ضربتی در مقیاس بزرگ. مؤسسه RAND در آمریکا نیز هشدار داده است که کاهش نقش انسان در تصمیمگیری میتواند پیامدهای غیرقابل جبرانی به همراه داشته باشد.

پیامدهای راهبردی برای ایران

این استاد دانشگاه اضافه کرد: با توجه به تحولات پرشتاب جهانی، ایران باید دکترین دفاعی خود را بازنگری کند، محور نخست این بازنگری توسعه سامانههای بومی پردازش اطلاعات پهپادی است، محور دوم طراحی مدلهای زبانی فارسی ویژه امنیت ملی برای تحلیل اسناد طبقهبندیشده خواهد بود و محور سوم ایجاد ساختار ترکیبی انسانماشین برای تسریع در تصمیمگیریهای بحرانی است.

اصغریان گفت: سرعت بیسابقه توسعه سلاحهای بر پایه AI توسط آمریکا، چین و روسیه نشاندهنده آغاز یک رقابت فناورانه شبیه جنگ سرد است. نبود چارچوبهای الزامآور بینالمللی، خطر تشدید بحرانهای امنیتی را افزایش میدهد. در این شرایط، ایران باید علاوهبر ارتقای ظرفیتهای فناورانه، رویکرد اخلاقی و انسانی خود را در عرصه دفاعی حفظ کند.

ورود هوش مصنوعی به ساختار نظامی قدرتهای بزرگ، نهتنها قواعد جنگ را دگرگون کرده بلکه نظم جهانی را نیز با چالشهای اخلاقی و حقوقی روبهرو ساخته است. بیتوجهی به این تحولات میتواند عقبماندگی راهبردی به همراه داشته باشد، در حالی که سازگاری هوشمندانه با نظم فناورانه جدید، شرط بقا و بازدارندگی در قرن بیستویکم خواهد بود.

- لطفا از نوشتن با حروف لاتین (فینگلیش) خودداری نمایید.

- از ارسال دیدگاه های نا مرتبط با متن خبر، تکرار نظر دیگران، توهین به سایر کاربران و ارسال متن های طولانی خودداری نمایید.

- لطفا نظرات بدون بی احترامی، افترا و توهین به مسئولان، اقلیت ها، قومیت ها و ... باشد و به طور کلی مغایرتی با اصول اخلاقی و قوانین کشور نداشته باشد.

- در غیر این صورت، «نگارمگ » مطلب مورد نظر را رد یا بنا به تشخیص خود با ممیزی منتشر خواهد کرد.

- آخرین اخبار

- محبوب

- برچسب های داغ

- پنج دلیل برای اینکه گردو برای یک سبک زندگی سالم ضروری است

- عکس| «طلا و مرمر خاص»: ترامپ عکسهایی از حمام لینکلن پس از بازسازی منتشر کرد

- ژاپن نیروهای نظامی را برای مقابله با حمله خرسها اعزام میکند

- آیا میخواهید بدون دارو با استرس مبارزه کنید؟ در اینجا یک روش ساده ارائه شده است

- مردی به خاطر عادتی که ما از آن متنفریم، ۵۰۰۰۰۰ دلار برنده میشود

- ورزش چگونه تأثیر فست فود بر خلق و خو را منعکس میکند؟

- «رازهای فاششده» ... رونالدو برای جسورانهترین مصاحبه دوران حرفهایاش با پیرس مورگان آماده میشود

- عکس| لوچانو اسپالتی، که سرمربی یوونتوس شد، خالکوبیای به نام ناپولی روی بازویش دارد

- استارمر بهای نگه داشتن گردنبندی که ترامپ به او هدیه داده بود را میپردازد

- گوگل: اندروید خیلی امنتر از آیفونه!

- وقتی از خواب محروم میشوید، چه اتفاقی در مغز میافتد؟

- تری در مورد ورود هازارد به تالار مشاهیر لیگ برتر گفت: «تو بزرگترین بازیکن چلسی هستی.»

- ویدئو| «ترامپ چاپلوس»: بنیانگذار بناند جری پس از ممنوعیت «طعم غزه» صاحبان شرکتها را به چالش میکشد

- روانپزشکان یک مورد نادر از روانپریشی مرتبط با چرخه قاعدگی را ثبت کردهاند

- لحظهای که هواداران فوتبال منتظرش بودند! کریستیانو جونیور چه زمانی به پدرش در تیم اصلی النصر ملحق خواهد شد؟

- یک متخصص تغذیه این افسانه را که نباید بعد از ساعت ۶ بعد از ظهر غذا خورد، رد کرد

- مشهورترین رمز جهان حل شد

- دانشمندان راز عذرخواهی بینقص را فاش کردند

- سازمان بهداشت جهانی: خودکشی عامل یک درصد مرگ و میرها در جهان است

- JoHS: دانشمندان ویژگیهای شخصیتی مشترکی را در بین افراد صد ساله شناسایی کردهاند

- رئیس جمهور کلمبیا به دلیل تحریمهای آمریکا در دریافت حقوق خود با مشکل مواجه است

- حل معمای پیدایش آب روی زمین به کمک ماه!

- چطور میتوان ظرفها را تمیز شست؟

- فشار خون به فصل ارتباط دارد؟

- رشد دوباره مو در سلولهای چربی نهفته است!

- درختان کهنسال گلدان دار میشوند!

- تنفس مصنوعی از راه روده!

- درمان سرطان تخمدان با کمک یک گیرنده سطح سلولی!

- علائم بروز سکته مغزی! + نقش مهم زمان!

- یک فنجان آب انار ضامن سلامت قلب!

- چگونه سالم لاغر شویم؟

- ثروتمندترین افراد جهان با هوش مصنوعی پولدارتر شدند!

- مولکولی که میتواند گرسنگی را از بین ببرد!

- اپل روند ساخت آیفون را تغییر میدهد!

- حسگری که افزایش اشعه خطرناک UV را هشدار میدهد!

- رفتار عجیب زنبورهای عسل در مقابل ملکه!

- رکورد طولانیترین مدت بقا با کلیه خوک شکسته شد!

- کارایی پردازش مدلهای زایا با این شتابندهها افزایش مییابد!

- پیشگیری از ابتلا به سرماخوردگی با سادهترین نکات!

- دوچرخه برقی برای پاها! عنوان پروژه جدید شرکت نایکی!

- افزایش عمر گوشی با ۷ ترفند ساده!

- زنان دو برابر مردان مستعد افسردگی هستند!

- عینک هوشمندی که بینایی نابینایان را بازمیگرداند!

- استویا میتواند راهی برای درمان کچلی باشد!

- دلیلی که باید به نوزاد بادام زمینی بدهید!

- افزایش دمای زمین باعث مرگ میشود؟

- داغی و سوزش کف پا نشانه چه بیماریهایی است؟

- بیماریهای قلبی و عروقی چه مقدار کشته میدهند؟

- فضای حافظه گوشی را میتوانید از طریق واتساپ مدیریت کنید!

- ایلان ماسک همچنان هوش مصنوعی و رباتها را چیره بر انسانها دید!

- چتباتهای هوش مصنوعی میتوانند توهم ایجاد کنند!

- معرفی بهترین زمان مصرف امپرازول و پنتوپرازول

- الگوریتم هوش مصنوعی میتواند خطر ابتلا به بیماریهای قلبی را عددی بیان کند!

- کمخونی ناشی از فقر آهن با این مکمل ترکیبی درمان میشود!

- روشهای فوری و معجزهآسای لاغری قابلیت عملی شدن دارند؟

- در زمان اسهال چی بخوریم؟

- پیرگوشی تحت تاثیر چه عواملی ایجاد میشود؟

- خاصیت لبو برای نوزادان و کودکان!

- بلعیدن آدامس خطرات ترسناکی دارد؟

- فیناستراید دارویی که باعث ایجاد افکار خودکشی میشود!

- داروهای مسکن و تببر استامینوفن برای دوران بارداری خطرناک است؟

- نوشیدنیهای انرژیزا میتوانند عامل خودکشی باشند!

- شش ترکیب پرمصرف که برای سلامتی مضرند!

- مصرف طولانی مدت امپرازول عوارض دارد؟

- نگهداری سیر تازه در روغن خطرناکترین روش است!

- یک نشانگر زیستی درمانی جدید برای سرطان تخمدان!

- درمان مشکل ضربان قلب با کمک پرتودرمانی!

- مهمترین عامل در بروز سکتههای مغزی چیست؟

- بسیار از سرطانها در مراحل اولیه قابل درمان هستند!

- اگر بیماری پرفشاری خون دارید، برای مصرف داروها به این نکات نیاز دارید!

- استنشاق گاز قرص برنج هم خطری است؟

- بیماری پسوریازیس باید سریعا تشخیص داده شود!

- بررسی اثرات فشار خون در فصل پاییز!

- آلرژی کودک به این آجیل را اینگونه از بین ببرید!

- مصرف مواد غذایی کپکزده خطر سرطان دارد!

- آمار عجیب ابتلای افراد به سکته مغزی!

- دید دقیق قویترین رصدخانه فضایی جهان واضحتر میشود!

- چگونه دمای دقیق بدن را اندازهگیری کنیم؟

- کرمی که بعد از ۴۶ هزار سال یخزدگی زنده شد!

- ساخت نمونه اولیه یک دستکش هوشمند تایید شد!

- ناسا به تردیدهای کیم کارداشیان در مورد فرود بر ماه پاسخ داد

- عکس| مل گیبسون جنجالی بر سر مریم مقدس به پا کرد

- ابتلا به «ویروس اهداکننده»| یک بازیگر مشهور آمریکایی قصد دارد کلیه خود را به یک غریبه اهدا کند

- همسر سابق آرشاوین: او بنتلی من را فروخت، یک مرسدس خرید و مابهالتفاوت را برای خودش نگه داشت

- مسی بهترین ورزشکاران در بین تمام رشتههای ورزشی را انتخاب کرد

- دلیل پاملا اندرسون، ۵۶ ساله، برای کنار گذاشتن آرایش

- جانیک سینر و کیلیان امباپه در رستورانی در پاریس با هم آشنا شدند

- خاطرات قربانی اپستین، افشاگری تکاندهندهای را در مورد شریک زندگی او و یک بازیگر بینالمللی آشکار میکند

- ستاره سریال «بازی تاج و تخت» با نامزد سابق داکوتا جانسون قرار ملاقات میگذارد

- همسر بیبر درباره درمانهای صورتش صحبت میکند

- تیماتی یکی از گرانترین ماشینها را به نامزدش داد

- حمله همسر وزیر بهداشت آمریکا به دلیل «رسوایی پیامکهای جنسی» به یک روزنامهنگار مشهور

- هایدی کلوم به مناسبت تولد ۱۶ سالگی دخترش، عکسی کمیاب از او در کنار دخترش منتشر کرد

- رشفورد نتوانست بین مسی و رونالدو یکی را انتخاب کند

- مودریچ برای همه بازیکنان میلان آیفون خرید تا مجبور نباشد جلوی تیم آهنگ اجرا کند

- عکس| واکنش همسر یاسر الزبیری پس از قهرمانی مراکش در جام جهانی زیر ۲۰ سال فیفا

- نیکول کیدمن ۵۸ ساله راز زیبایی خود را فاش کرد

- شاهزاده اندرو به ارتباط با اپستین در بریتانیا متهم شده است

- جیجی حدید علناً خطاب به بردلی کوپر گفت: «عشق من»

- برد پیت رابطهاش با اینس د رامون را به سطح بالاتری برد

- مگان مارکل عکسی از خودش و دخترش را به اشتراک گذاشت

- پاسخ شاهزاده هری به اتهامات همسرش مبنی بر بیاحترامی به مادرش فاش شد

- دختر ۱۴ ساله بکهام برند لوازم آرایشی خودش را تأسیس خواهد کرد

- جزئیات رابطه جنیفر لوپز و بن افلک پس از تجدید دیدار فاش شد

- عکس| دمبله برای جشن گرفتن بردن توپ طلا، یک جفت کفش اختصاصی دریافت کرد

- شایعات عاشقانه جرد لتو قوت گرفت

- پدری، هافبک بارسلونا، با قرار دادن یک بازیکن سابق رئال مادرید در فهرست خود، فوتبالیست ایدهآل را انتخاب کرد

- کیتی پری سکوت خود را در مورد رابطهاش با نخستوزیر سابق کانادا شکست

- بردلی کوپر مشکوک به جراحی پلاستیک است: "قبلاً بهتر بود"

- «لئو از صحبتهای شخصی خوشش نمیآید.» دییونگ توضیح داد که چطور از مسی تعریف و تمجید شده است

- مشخص شد که چرا خانواده بکهام در عروسی سلنا گومز شرکت نکردند

- پاریس هیلتون هفتهای ۹ ساعت را صرف مراقبتهای صورت میکند

- همسر جاستین بیبر توضیح داد که چرا او و این خواننده پسرشان را به نمایش نمیگذارند

- شوهر ستاره جیمز باند دستگیر شد

- همسر بیبر فاش کرد که با یک میلیارد دلار حاصل از فروش برندش چه خواهد کرد

- کیم کارداشیان دلیل طلاقش از کانیه وست را فاش کرد: "حمله دیگری اتفاق افتاده است"

- کیم کارداشیان با اعتراف به اینکه از قیمت مواد غذایی خبر ندارد، طرفدارانش را شوکه کرد

- بریتنی اسپیرز همسر سابقش را به قلدری متهم کرد: «دیگر بس است»

- شارلیز ترون به خاطر بیاحترامی به جانی دپ مورد انتقاد قرار گرفت: "او بیادب است. "

- کیث اربن پس از جدایی از نیکول کیدمن، رابطه عاشقانه جدیدی را آغاز کرده است: «او در شوک است.»

- مادر سلنا گومز به شایعات مربوط به رسوایی در عروسی دخترش پاسخ داد

- همسر بروس ویلیس گفت فرزندانش از همین حالا برای پدرشان سوگواری میکنند

- هواداران نیکول کیدمن پس از انتشار خبر طلاق، به کیت اربن حمله کردند

- فائزه العماری از مبارزه امباپه با شهرت میگوید

- بوفون در مورد انتخاب پسرش برای بازی در تیم ملی جمهوری چک: در ایتالیا، بار نام خانوادگیاش او را خرد میکرد

- پیشخدمت پرنسس دایانا راز جدیدی را در مورد کاخ باکینگهام فاش کرد

- پسر ۲۱ ساله راسل کرو به خاطر تصویرش مورد انتقاد قرار گرفت: «او مثل پدرش نیست.»

- نیکول کیدمن پس از جدایی از کیث اربن بیانیهای صادر کرد

- مگان مارکل به خاطر تمسخر یک مدل محکوم شد: «این حرفها خیلی گویای شخصیت واقعی اوست»

- ویکتوریا بکهام میگوید به خاطر شوهرش لبخند نمیزند

- جنیفر آنیستون اعتراف کرد که ۲۰ سال برای بچهدار شدن تلاش کرده است

- آنجلینا جولی، ستاره بینالمللی، درباره طلاقش از برد پیت، بازیگر مشهور، صحبت کرد و شکایت جدیدی علیه او مطرح کرد

- این دوچرخه سوار اسپانیایی تادژ پوگاچار را با بارسلونا یوهان کرایف مقایسه کرد

- کیت میدلتون با کت و شلوار سبز با "شکلات دبی" مقایسه شد

- جورج کلونی برای اولین بار درباره مصرف مواد مخدر صحبت کرد: «مشکلی نبود»

- شایعات نامزدی هرمیون گرنجر، ستاره هری پاتر، قوت گرفت

- «مدت زیادی تحریک و تحقیر شدم.» لروی سانه در اکتبرفست دعوا راه انداخت

- رایت: اگر کین از بایرن به تاتنهام برگردد، رکورد گلزنی شیرر در لیگ برتر را خواهد شکست

- رپر معروف، دیدی، به ۵۰ ماه زندان محکوم شد

- تام هالند برای اولین بار نامزدی خود با زندایا را تایید کرد

- حمایت بانکها از بازار سرمایه از فردا اجرا میشود

- بورس سقوط کرده در دولت روحانی چگونه در دولت شهید رئیسی احیا شد؟

- درمان بورسی پزشکیان از زبان عبده

- جذب سرمایه ۷ همتی از بازار بورس دانشبنیانها

- وعده عناب بورسی واقعیتر شد

- چهارمین روز نزولی بازار در غیاب نیروهای صعودی

- انتخابات و دامنه نوسان مهمترین دلیل رکود فعلی بورس

- بورس با ۴ مصوبه دولت برای حمایت از بازار سهام سبزپوش میشود؟

- ۳ دلیل پایین بودن ارزش معاملات خرد در بورس

- معافیتهای مالیاتی بازار سرمایه باید استمرار پیدا کند

- بورس این روزها تحت تأثیر تداوم نرخ اخزای بالای ۳۵ درصد

- رشد شاخصهای بورس با کف سازی تکنیکال

- کاهش دامنه نوسان هم علاج بورس نزولی نبود

- سایه تامین مالی دولت بر سر بورس سنگینی میکند

- کاهش بی سابقه حجم معاملات سهام در بورسهای جهانی

- رشد شاخصهای بورس با کمک بانکیها و اعلام نرخ تسعیر ارز

- حمله به سفیر روسیه در لهستان

- معرفی سری گوشیهای Redmi K ۵۰ قبل از رونمایی رسمی

- غفوری: فکر کردن به قهرمانی از الان، سادهلوحانه است

- کاهش ۱۰ درصدی تولید هوندا در دو کارخانه

- سومین نشست دستمزد، باز هم بدون نتیجه

- لغو بلیت فروشی عمومی المپیک زمستانی چین

- گرامیداشت قربانیان هواپیمای اوکراینی در دانشگاه تورنتو

- ادامه چانهزنی چهارگانه در وین

- صرفهجویی ۱.۶ میلیارد دلاری کمیته برگزاری المپیک و پارالمپیک توکیو

- محبوبترین رشته المپیک توکیو مشخص شد

- اعلام هزینه میزبانی توکیو از المپیک و پارالمپیک ۲۰۲۰،

- آذرتاج: هیات اقتصادی جمهوری آذربایجان به ایران میرود

- بررسی عملکرد ایران در المپیک؛ جایگاه چهارمی در آسیا

- پایان وضعیت اضطراری در کشور میزبان المپیک ۲۰۲۰

- هر آنچه که باید در مورد درماتیت سبورئیک و بهترین راههای پیشگیری از آن بدانید

- با سرمای زمستان... خطرات پنهانی بدون اینکه متوجه شوید، به رختخوابتان رخنه میکنند!

- خیارشورهایی که به مرور قاتلتان میشود

- گیاهان آپارتمانی که با کپک مبارزه میکنند و رطوبت را در زمستان کاهش میدهند

- یک آزمایش سریع سکته مغزی را تشخیص میدهد!

- عکس| ایالات متحده: پنج نفر در ارتباط با مرگ نوه رابرت دنیرو بر اثر مصرف بیش از حد مواد مخدر دستگیر شدند

- مضرات قهوه و نحوه مصرف ایمن آن

- ۱۲ ماده غذایی که باروری مردان را افزایش میدهد

- ۵ نوع چای که به شما در سوزاندن چربی شکم کمک میکنند، معرفی شد

- روسیه: یک حسگر نوری جدید امکان تجزیه و تحلیل آسان محتوای سرب را بدون نیاز به آزمایشگاه فراهم میکند

- متخصص طب سالمندان، موسکالوف: اعتیاد به شیرینی باعث مرگ زودرس میشود

- دانشمندان چینی ارتباطی بین مصرف قهوه و کاهش خطر ابتلا به میگرن پیدا کردهاند

- نیویورک پست: نان چاودار، جو و جو دوسر اشتها را کاهش داده و به کاهش وزن کمک میکنند

- عادت رایجی که مانع هضم طبیعی غذا میشود

- متخصصان دانشگاه مونترال راز حیاتی شکر را فاش کردند

- سطح بالای انسولین ارتباط مستقیمی با سرطان پانکراس دارد

- هافپست: انزوای اجتماعی به سرعت به مغز آسیب میرساند

- یک مکمل غذایی محبوب میتواند پلاک را از رگهای خونی پاک کند

- دانشمندان ارتباط بین باکتریهای روده و سلامت روان کودکان را کشف کردند

- نوروپپتید Y بشریت را به اعتیاد محکوم میکند

- علت جدیدی برای زوال شناختی و آسیب مغزی کشف شد

- تشخیص اشتباه سرطان سینه، خطر ابتلا به این بیماری را تا ۶۰ درصد افزایش میدهد

- فضاهای بدون مرد به زنان چینی اجازه میدهد تا از فشارهای اجتماعی فرار کنند

- ورزش برای سلولهای ایمنی مفید است

- مطالعه: ننوشیدن آب کافی باعث افزایش واکنش استرس میشود

- متخصصان قلب و عروق زنگ خطر را به صدا درآوردهاند: فشار خون بالا به طور قابل توجهی در افراد جوانتر شایعتر شده است

- مصرف بیش از حد گوشت قرمز احتمال ضخیم شدن دیوارههای یک شریان اصلی در قلب را افزایش میدهد

- یک متخصص تغذیه توضیح داد که آیا ماست واقعاً به کاهش وزن کمک میکند یا خیر

- دانشمندان راهی برای درمان حملات پانیک در چهار روز پیدا کردهاند

- بزرگترین مطالعه در مورد استفاده از سیگار الکترونیکی در جوانان نشان میدهد که این وسیله دروازهای به سوی سیگار کشیدن است

- دانشمندان سوئدی نشانگرهای خونی را کشف کردهاند که مشخصه افراد با طول عمر بالا است

- یک برند شکلات محبوب در بریتانیا به دلیل خطر آلرژی، فوراً از بازار جمعآوری شد

- دانشمندان رژیم غذایی را شناسایی کردهاند که سلامت روان را بهبود میبخشد

- کمبود خواب سلامت دانشآموزان را به خطر میاندازد: مطالعهای در روسیه خطرات بیدار ماندن تا دیروقت را آشکار میکند

- داشتن سن بیولوژیکی بالاتر، خطر سکته مغزی را افزایش میدهد

- دانشمندان شرط اصلی که رابطه جنسی در آن باعث افزایش طول عمر میشود را شناسایی کردهاند

- نفخ و سنگینی بعد از ناهار؟ در اینجا توضیحی از علم مدرن آورده شده است

- قهوه فوری از چه چیزی ساخته شده است و آیا برای سلامتی مضر است؟

- غذاهای فوری که بیشترین آسیب را به مغز وارد میکنند

- سیگار کشیدن و پیشدیابت، جوانان سالم را در معرض سکته مغزی قرار میدهد

- ارز

- طلا

- بورس

- تورم

- اخبار داغ

- ورزشی

- پربیننده

- پربحث

- دانشمندان علوم اعصاب مکانیسمی را کشف کردهاند که مغز طی یادگیری از طریق آن بازسازی میشود

- فرودگاه برمن در آلمان به دلیل پهپاد ناشناس تعطیل شد

- ترامپ استفاده از نیروهای آمریکایی در خاک نیجریه را رد نکرد

- «یک فرآیند پیچیده»: کرملین به سوالی درباره خط مستقیم با پوتین پاسخ میدهد

- دانشمندان روسی امکان ساخت ساختمانهای بلندمرتبه قابل اعتماد از چوب را فراهم کردهاند

- ترامپ انتقال موشکهای تاماهاک به اوکراین را رد کرد

- ترامپ: اگر هفته آینده در پرونده تعرفهها شکست بخوریم، ایالات متحده به سطح یک کشور جهان سومی تنزل خواهد کرد

- یک استاد نروژی شکست غرب در اوکراین را اعلام کرد

- روسیه به منظور حمایت از تولید کود و تضمین امنیت غذایی، صادرات گوگرد صنعتی را موقتاً ممنوع کرد

- بلاروس نهادهای لیتوانیایی و اروپایی را به سود بردن از قاچاق از طریق بالنهای هواشناسی متهم میکند

- مسکو در صدر تصادفات مربوط به اسکوترهای برقی در جهان قرار دارد

- دانشمندان ریشههای تهاجمیترین تومورهای مغزی دوران کودکی را کشف کردهاند

- بیلد: یک سوم شرکتهای آلمانی قصد دارند سال آینده مشاغل خود را کاهش دهند

- رویترز: آمریکا در حال توسعه یک پایگاه نظامی در پورتوریکو برای آمادگی جهت عملیات احتمالی در ونزوئلا است

- آمریکا نسبت به لغو گسترده پروازها به دلیل تعطیلی دولت هشدار داده است

- دانشمندان هشدار میدهند که کودکان امروزی شاهد تعداد بیسابقهای از فجایع اقلیمی خواهند بود

- گزارش سازمان ملل: ۱۳۰۰ نفر بر اثر تیراندازی نیروهای پشتیبانی سریع زخمی شدند، ۱۰۰ نفر قربانی خشونت جنسی، آوارگی و بازداشت غیرنظامیان شدند

- ربایندگان استاد دانشگاه سودانی در الفاشر، دو میلیارد پوند باج درخواست کردند

- هواداران و مخالفان ووچیچ در پایتخت صربستان مقابل پارلمان تجمع کردند

- دانشمندان کشف کردهاند که چرا برخی از کودکان زودتر از دیگران شروع به راه رفتن میکنند

- ووچیچ: کشورهایی که از ما مهمات میخرند، آن را هر طور که دلشان بخواهد دور میریزند

- روزنامه: طرح کلاهبرداری داراییهای روسیه برای اتحادیه اروپا ویرانگر خواهد بود

- از هر سه شرکت آلمانی، یک شرکت قصد دارد سال آینده تعداد کارمندان خود را کاهش دهد

- امباپه در مورد مقایسه با رونالدو: همه میدانند که کریستیانو معیار و شماره یک رئال مادرید است

- محمد صلاح پس از پیروزی مقابل استون ویلا، تاریخ لیورپول را رقم زد و به یک رکورد جدید دست یافت

- دانشمندان در پرندگان کیفیتی را کشف کردهاند که پیش از این تصور میشد منحصر به انسان است

- حزب حاکم اوکراین: بدهی عمومی اوکراین از سال ۲۰۲۲ سه برابر شده است

- ایتالیا نتیجه جلسه مخفی "ائتلاف داوطلبان" را پیش بینی کرد

- دانشمندان روشی ساده برای تشخیص بیماری کلیوی با استفاده از ماسک پزشکی معمولی ابداع کردهاند

- اسطوره لیورپول از آرنه اسلات دفاع کرد و به درخواستها برای اخراجش پاسخ داد

- مصر: انتظارات برای بازگشت رکوردشکن گردشگری پس از افتتاح موزه بزرگ مصر

- یک کارخانه فرآوری طلا در فرانسه مورد سرقت قرار گرفت

- بیانیهای تکان دهنده در مورد تفاوت سیستمهای تسلیحاتی در ایالات متحده و روسیه... کدام بهتر است؟

- از شی جین پینگ خواسته شد تا در مذاکرات به کره جنوبی و کره شمالی کمک کند

- دانشمندان یک «اثر حافظه» جوی را کشف کردهاند که باعث بارشهای فصلی میشود

- دیرینهشناسان میگویند تیرانوسوروس رکس یک "مهاجر" از آسیا بوده است

- سناتور روس: تحریمهای ترامپ علیه مسکو برای متحدان آمریکا مشکلساز است

- فناوری جدید نظامی روسیه، غرب را نگران کرده است

- زاخارووا مقصر اپیدمی مواد مخدر در ایالات متحده را شناسایی کرد

- یک ورزشکار بریتانیایی به دلیل انتشار فیلم مستهجن از داخل هواپیما از فعالیت محروم شد

- متخصصان ژنتیک جهشی را کشف کردهاند که به صاحبانش یک "قدرت فوقالعاده" نادر میدهد

- آمریکا: در پی تیراندازی در یک مهمانی هالووین در غرب اوکلاهما، پنج نفر زخمی شدند

- کاخ سفید: ایالات متحده مقاماتی را به کنفرانس COP۳۰ در برزیل اعزام نخواهد کرد

- اروپا از تلاشهای اتحادیه اروپا برای پنهان کردن رفاه روسیه خبر داده است

- بلومبرگ میزان درآمد میلیاردرهای روسی از ابتدای سال را فاش کرد

- زاخارووا واشنگتن را به خاطر مشکلات مواد مخدر در آمریکا سرزنش کرد

- دانشمندان کشف کردهاند که مردمان باستان، کوههای پیرنه را به یک مرکز تجاری در عصر یخبندان تبدیل کرده بودند

- فلیک خبر خوبی در مورد مصدومیت لامین یامال به هواداران بارسلونا میدهد

- تایلند: مرد آمریکایی با وزن ۲۰۰ کیلوگرم در طول برنامه کاهش وزن درگذشت

- ترامپ: دیدار عالی من با رهبر چین به صلح ابدی منجر خواهد شد

- زاخارووا اتحادیه اروپا را به حمایت دولتی از تروریسم بینالمللی متهم کرد

- دانشمندان گونه جدیدی از کوسه باستانی را کشف کردهاند که در سواحل بریتانیا شنا میکرده است

- پرتقالها در سطح جهانی بهای این موضوع را میپردازند... بنابراین کدام کالا در ماه اکتبر بیشترین سهم را داشت؟

- به خاطر عمر مرموش... منچسترسیتی تیم ملی مصر را شوکه کرد

- روسیه توضیح داد که چرا ایالات متحده بار دیگر درباره انتقال موشکهای تاماهاک به اوکراین صحبت میکند

- دانشمندان هشدار میدهند که آنفولانزای مرغی از طریق گربهها به انسان منتقل میشود

- در بحبوحه نوسانات بازار، مسیر طلا در اکتبر ۲۰۲۵ چگونه بود؟

- جنجال در درون دولت آلمان بر سر اخراج سوری ها!

- شورای امنیت روسیه خواستار محافظت از جوانان در برابر «انگشتان ایدئولوژیک» غرب شد

- نرمافزاری برای تشخیص زودهنگام سرطان در روسیه توسعه داده شده است

- شبکه پزشکان سودان: ۶۴۲ آواره از الفاشر به منطقه ادبا در ایالت شمالی رسیدند

- متخصصان اطفال سوئد هشدار میدهند که کارتونها برای کودکان زیر ۲ سال مضر هستند

- رشد عرضه پول در مراکش

- غرب از ضررهای مالی فنلاند ناشی از بسته شدن مرزش با روسیه خبر داد

- یک بومشناس درباره باکتریهایی صحبت میکند که لکههای نفتی دریاچه بایکال را میخورند

- الهلال عربستان ضربه سنگینی به لیورپول وارد کرد

- واشنگتن پست از میزان حضور نظامی آمریکا در سواحل ونزوئلا و احتمال انجام اولین حملات خبر داد

- اپل به طور کامل آیفون پرو مشکی را کنار خواهد گذاشت.

- جنجال در آلمان پس از اعطای جایزه "بهترین" به ورزشکار متهم به دوپینگ

- نوشیدنیای ساخته شده است که به محافظت در برابر زوال عقل کمک میکند

- دانشمندان کشف کردهاند که برخی از اشیاء با چشم انسان قابل مشاهده نیستند

- گفتگوی مالی روسیه و امارات متحده عربی به منظور تقویت همکاریهای مالی و دیجیتال در دبی برگزار شد

- بریتانیا اقداماتی را برای تقویت مبارزه با «جنایات ناموسی» تصویب کرد

- سیلوانوف: حجم تجارت بین روسیه و امارات متحده عربی دو برابر شده است

- غرب از برنامههای ناتو برای «مهار» روسیه خبر داد

- فیزیکدانان برای اولین بار اشیاء کوانتومی را از حالتهای درهمتنیده چندبعدی استخراج کردند

- ال موندو: «ائتلاف داوطلبان» قصد دارد جلسهای محرمانه برگزار کند

- یک جامعهشناس درباره درگیری احتمالی بین لهستانیها و اوکراینیها صحبت کرد

- ترکیبی از دو باکتری رایج شناسایی شده است که سیستم ایمنی را سرکوب میکند

- تعطیلی دولت آمریکا، امنیت پروازها را تهدید میکند| کنترلکنندگان ترافیک هوایی حقوق دریافت نمیکنند

- کارلو آنچلوتی موازنه قدرت در فصل جاری سری آ را ارزیابی کرد

- پوکوگنولی، سرمربی موناکو، درباره شکست مقابل پاریس در لیگ ۱ فرانسه اظهار نظر کرد

- کارلو آنچلوتی اهداف خود را به عنوان سرمربی برزیل تشریح کرد

- رئال مادرید در پست دفاع راست مشکل دارد

- یوونتوس به دنبال نقل و انتقالات زمستانی بعدی است

- گزینه دیگر بوندسلیگایی برای اندریک

- امری، سرمربی استون ویلا: از نحوه مبارزهمان مقابل لیورپول خوشم آمد

- فرانک، سرمربی تاتنهام: در بازی مقابل چلسی انرژی، انگیزه و طراوت لازم را نداشتیم

- اریک تن هاگ، سرمربی سابق منچستریونایتد، ممکن است هدایت ولورهمپتون را بر عهده بگیرد

- بروسیا دورتموند برای حفظ ستارههایش، یک شگفتی آماده میکند

- میلان در ژانویه برای جذب مهاجم اقدام میکند

- نقشه الف و ب: اینترمیلان در جستجوی خرید با رئال مادرید رقابت میکند

- هالند، مهاجم منچسترسیتی، به دستاوردهای سوارز و فاولر در لیگ برتر رسید

- جیووانی گالئونه سرمربی ایتالیایی درگذشت. او مربی گاسپرینی و آلگری بود

- میلان میخواهد آرتم دوبیک را در زمستان با مهاجم خودش معاوضه کند

- توافق با اوپامکانو: «باید آن را به دست آوریم»

- روبن آموریم به بازار زمستانی بعدی منچستریونایتد اشاره میکند

- اسپانیول از سالی تاریخی هیجانزده است

- چلسی و تاتنهام هاتسپر به آگهخوا مهاجم پورتو نگاه میکنند

- میلان در سری آ رم را شکست داد، ماینیان پنالتی دیبالا را مهار کرد

- بتیس در هفته یازدهم لالیگا، مایورکا را در هم کوبید. آنتونی دو گل زد و یک پاس گل داد

- مهمان غافلگیرکننده از لیگ برتر برای مبارزه بر سر اندریک

- یک عامل، آینده مارکوس رشفورد در بارسلونا را پیچیده میکند

- نیکولاس جکسون ممکن است در ژانویه تیم خود را تغییر دهد

- باشگاه منچسترسیتی در مورد وضعیت رودری که به دلیل مصدومیت چهار بازی را از دست داده است، اظهار نظر کرده است

- رومانو جزئیات علاقه منچستریونایتد به کانر گالاگر را فاش کرد

- واکنش امباپه در پاسخ به این سوال که آیا برای این فصل هدف گلزنی دارد یا خیر

- مهاجم آیندهدار بارسلونا در مونپلیه است

- کریستین تیو تیم جدیدی دارد

- سویا و بتیس بر سر یک وینگر رقابت میکنند

- فریدل درباره آلیسون بکر: یکی از بزرگترین بازیکنان باشگاه

- امباپه تفاوتهای بین پاری سن ژرمن و رئال مادرید را توضیح داد

- اکیتیکه، مهاجم لیورپول، به عنوان بهترین مهاجم تاریخ را انتخاب کرد

- جزئیات جدیدی در مورد درگیری بین وینیسیوس و ژابی آلونسو منتشر شده است

- تیراندازی در یک مهمانی نوجوانان در آمریکا رخ داد

- سرمربی ناتینگهام فارست: مصدومیت زینچنکو جدیتر از حد انتظار است

- هری کین در اسپانیا فرصتی پیدا میکند!

- ارزش بازار امانوئل امگا به شدت کاهش یافت

- قیمت نهایی آردا گولر

- برالدو شایعات جداییاش از پاری سن ژرمن را تکذیب کرد

- «پنالتیها را نمیشود مثل نقل و نبات داد» ... آلونسو و امباپه به خاطر وینیسیوس با انتقادات گستردهای روبهرو هستند

- روبن آموریم در مورد نقل و انتقالات زمستانی منچستریونایتد گفت: «آنها درخواست جدایی خواهند داد.»

- روزنامه سان: بارسلونا نگران مزمن شدن مصدومیت یامال است

- آنها در را برای سدریک باکامبو باز میکنند

- سانتی خیمنز فرصتهای خود را در میلان افزایش میدهد

- باشگاه بروسیا دورتموند قصد دارد در نقل و انتقالات زمستانی سه بازیکن را از این تیم جدا کند

- موندو دپورتیوو: بارسلونا میتواند با جذب یک مهاجم از لیگ یک، ترکیب خود را تقویت کند

- آموریم در مورد رقابت با لیورپول: اصلاً برایم مهم نیست

- منچستریونایتد به بازیکن ۱۸ ساله بااستعداد لیل علاقهمند است

- آلگری: برای اسپالتی آرزوی موفقیت میکنم

- گاسپرینی درباره دیبالا: او تمام ویژگیهای یک مهاجم درجه یک را دارد

- گاسپرینی پیش از بازی با میلان: هدف ما محک زدن قدرتمان در سن سیرو است

- رئال مادرید برای تقویت تیم خود برنامه ریزی کرده است

- فرصت بازار برای مهاجم چلسی

- انگولو کانته ممکن است به اروپا بازگردد

- بالوتلی در واکنش به اخراج ویرا از سرمربیگری جنوا: «کارما بیرحم است.»

- آریگو ساکی: فابرگاس طعم واقعی بازی را چشیده است

- آرتتا، سرمربی آرسنال: ما در مقابل برنلی از نظر دفاعی عالی بازی کردیم

- فروش انزو فرناندز بنفیکا را نابود کرد

- خولن لوپتگی در حال بررسی بازگشت به اسپانیا یا انگلیس است

- بوندسلیگا به دنبال جذب ۴ بازیکن بااستعداد رئال مادرید است

- سم جانستون، دروازهبان ولورهمپتون، در مورد نتایج تیمش گفت: «ما باید شرمنده باشیم.»

- یک شرکت شیلیایی، یوفا را به کپیبرداری از قالب جام ملتهای اروپا متهم کرد

- کونته پس از تساوی ناپولی مقابل کومو: «امروز از بعد از پیروزیهایمان خوشحالترم.»

- فلیک درباره انتقاداتی که پس از ال کلاسیکو به یامال وارد شد صحبت کرد

- آلگری پیش از دیدار مقابل رم در مورد وضعیت بازیکنان مصدوم صحبت کرد

- هانس دیتر فلیک، سرمربی بارسلونا، در مورد مصدومیت پدری اظهار نظر کرد

- پیشنهاد اولیه برایتون برای جذب اندریک

- وقتی بارسلونا جوردی آلبا را رد کرد...

- بایرن مونیخ و لیورپول برای تصاحب پست دفاع کناری خود به رقابت میپردازند

- فابیو کاپلو توضیح داد که یوونتوس چگونه میتواند برای قهرمانی رقابت کند

- آرسنال حالا هفتمین کلین شیت متوالی خود در تمام رقابتها را ثبت کرده است

- آموریم، سرمربی منچستریونایتد: فکر میکنم همه میتوانند این را ببینند، ما در حال بهتر شدن هستی

- بیماریهای مزمن شایعی که سلامت روان را بدتر میکنند، شناسایی شدهاند

- هاروی الیوت خسته میشود و به فکر تغییر منظره میافتد

- الچه پیشنهاد ۲۰ میلیون یورویی را رد کرد!

- علایق دفاعی لیورپول با رئال مادرید همپوشانی دارد

- مارسی در دیداری که در هفته یازدهم لیگ ۱ فرانسه با دو کارت قرمز همراه بود، با اختلاف کمی اوسر را شکست داد

- تاتنهام مقابل چلسی شکست خورد و رکورد جدیدی را در زمینه xG در لیگ برتر برای این باشگاه ثبت کرد

- مشخص شد که چه چیزی میتواند مانع انتقال رشفورد از منچستریونایتد به بارسلونا شود